MLPerf[1] 벤치마크 테스트 6개 부문 전체에서 엔비디아가 세계적 수준의 성능을 기록했습니다.

엔비디아의 인공지능(AI) 플랫폼은 훈련 성능 부문에서 8개의 기록을 세웠는데, 여기에는 전반적 성능 기록 3개, 엑셀러레이터 하나를 기준으로 한 성능 기록 5개가 해당됩니다.

| 기록 유형 | 벤치마크 | 기록 |

| 최대 규모 (트레이닝 시간, 분 기준) |

객체 탐지 (중량) – 마스크 R-CNN | 18.47 분 |

| 번역 (반복) – GNMT | 1.8 분 | |

| 강화 학습 – MiniGo | 13.57 분 | |

| 액셀러레이터 당 (트레이닝 시간) |

객체 탐지 (중량) – 마스크R-CNN | 25.39 시간 |

| 객체 탐지 (경량) – SSD | 3.04 시간 | |

| 번역 (반복) – GNMT | 2.63 시간 | |

| 번역 (비 반복) – 트랜스포머 | 2.61 시간 | |

| 강화 학습 – MiniGo | 3.65 시간 |

표 1: 엔비디아 MLPerf AI 기록

액셀러레이터 당 성능 비교는 단일 엔비디아 DGX-2H(16 V100 GPUs) 상의 MLPerf 0.6 보고 기록과 MiniGo를 제외하고, 기타 동일한 규모의 제출 결과를 기반한 것입니다. MiniGo의 경우는 엔비디아 DGX-1 (8 V100 GPUs) 제출 결과가 사용됐습니다. | MLPerf ID 최대 규모: 마스크 R-CNN: 0.6-23, GNMT: 0.6-26, MiniGo: 0.6-11 | 액셀러레이터 당 MLPerf ID: 마스크 R-CNN, SSD, GNMT, 트랜스포머: 전부 0.6-20 사용, MiniGo: 0.6-10

이 같은 결과를 요약하자면, 엔비디아의 AI 플랫폼은 기존에는 하루가 걸리던 모델 훈련 시간을 2분도 채 안되는 시간으로 대폭 단축시킵니다.

AI는 슈퍼컴퓨터의 핵심 요소이죠. 기업들이 AI분야에서 경쟁력을 확보하기 위해서는 강력한 AI 컴퓨팅 인프라가 필요합니다. 엔비디아의 이번 MLPerf 테스트 결과는 엔비디아 V100 텐서(Tensor) 코어 GPU를 슈퍼컴퓨터급 인프라에 통합함으로써 얻을 수 있는 혜택을 증명하죠.

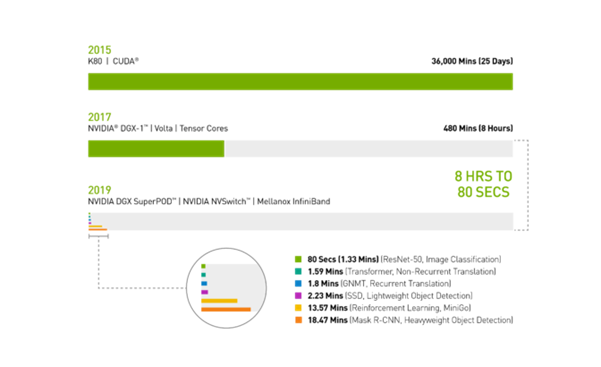

2017년에만 해도 V100 GPU가 탑재된 엔비디아 DGX-1 시스템이 이미지 인식 모델 ResNet-50을 트레이닝 하는데 하루 근무시간 전체, 즉 8시간이 걸렸습니다. 이제는 동일한 V100 GPU를 사용하는 엔비디아 DGX SuperPOD가 멜라녹스 인피니밴드(Mellanox InfiniBand)와 분산 AI 트레이닝에 최적화된 최신 엔비디아 AI 소프트웨어와 결합해 같은 작업을 단 80초만에 완료할 수 있죠.

엔비디아 DGX SuperPOD, MLPerf 테스트 6개 부문을 20분 안에 완료하는 유일한 AI 플랫폼

이번 결과를 통해 엔비디아 DGX SuperPOD가 MLPerf 테스트의 6개 각 부문을 20분도 안되는 시간 내에 완료할 수 있는 유일한 AI 플랫폼임이 입증됐답니다.

대규모MLPerf ID: RN50 v1.5: 0.6-30, 0.6-6 | 트랜스포머: 0.6-28, 0.6-6 | GNMT: 0.6-26, 0.6-5

| SSD: 0.6-27, 0.6-6 | MiniGo: 0.6-11, 0.6-7 | 마스크 R-CNN: 0.6-23, 0.6-3

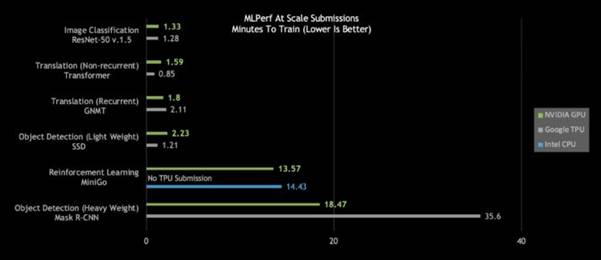

좀 더 자세히 살펴보면, 엔비디아 AI 플랫폼은 중량 객체 탐지, 강화 학습 등과 같은 총 트레이닝 시간을 기준으로 했을 때 가장 어려운 AI 문제에서 두각을 보입니다. 마스크 R-CNN 신경망을 사용하는 중량 객체 탐지는 사용자들에게 첨단 인스턴스 분류 기능을 제공하는데요. 예를 들어, 카메라, 센서, 라이다(lidar), 초음파 등과 같은 다양한 데이터 소스와 결합하면 특정 객체를 정확하게 파악하고, 위치를 찾아낼 수 있습니다.

이런 종류의 AI 워크로드는 자율주행차에 보행자나 그 밖의 객체의 정확한 위치를 알려주기 때문에 자율주행차 트레이닝에 도움이 되죠. 의사들이 의료용 스캔에서 종양을 찾고, 파악하는데 도움이 되는 부분 또한 주요한 활용사례 중 하나라 할 수 있습니다. 19분이 채 안되는 엔비디아의 중량 객체 탐지 제출 결과는 2위의 결과보다 거의 2배 더 우수한 성능을 보여줍니다.

강화 학습은 또 하나의 어려운 부문입니다. 이는 공장 현장에서 일하는 로봇을 훈련시켜생산을 효율화 하거나 도시에서 교통 혼잡을 줄이기 위해 신호등을 제어하는데도 사용됩니다. 엔비디아 DGX SuperPOD를 사용해서, 엔비디아는 MiniGo AI 강화 트레이닝 모델을 13.57분에 훈련시키는 기록을 세웠습니다.

즉각적인 AI 인프라로 세계 최고 수준의 성능 구현

엔비디아는 DGX 수퍼파드의 특징은 강력한 성능을 제공하는 동시에 설정 또한 쉽다는 것입니다. 엔비디아 NGC 컨테이너 레지스트리에서 무료로 제공되는 최적화된 CUDA-X AI 소프트웨어로 완벽하게 구성된 DGX SuperPOD는 세계 최고 수준의 AI 성능을 제공합니다.

또한, 모든 AI 프레임워크와 개발 환경을 지원하기 위해 엔비디아와 협력하는 130만명 이상의 쿠다(CUDA) 개발자들로 구성된 에코시스템과도 연결되죠. 엔비디아는 수 백개의 코드 라인의 최적화 작업을 통해 고객들이 AI 프로젝트를 실행할 수 있도록 지원해오고 있습니다.

갈수록 빨라지는 AI 인프라 속도 지원

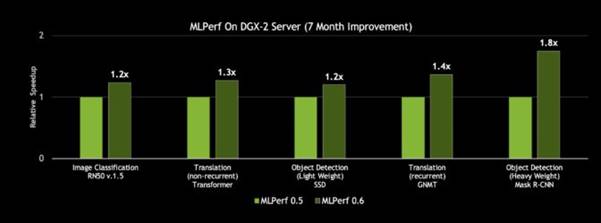

엔비디아는 엔비디아 NGC 컨테이너 레지스트리에서 무료로 다운로드 할 수 있는 통합 소프트웨어 스택과 함께 CUDA-X AI에 대한 새로운 최적화와 성능 개선을 매달 발표하고 있습니다. 여기에는 컨테이너화된 프레임워크, 사전 트레이닝된 모델과 스크립트도 포함됩니다. 이러한 CUDA-X AI 소프트웨어 스택의 혁신을 통해, MLPerf 0.6 제출 결과에서 엔비디아 DGX-2H 서버의 처리량이 7개월 전보다 80%까지 향상됐답니다.

[1] MLPerf는 업계 최초의 포괄적인 AI 벤치마크 스위트를 목표로, 컴퓨터 비전, 언어 번역, 맞춤형 추천, 강화 학습 과제 등을 다룹니다. https://mlperf.org/