자율주행 자동차를 개발하고 검증하는 과정에는 시뮬레이션을 통해 실제 세상에 대한 시나리오를 그대로 재현할 수 있는 기능이 필요하죠.

이번에 개최된 GTC 2022에서 NVIDIA 창업자 겸 CEO 젠슨 황(Jensen Huang)은 실제 상황에서의 운전 시나리오를 정확하게 재구성하고 수정하는 NVIDIA DRIVE Sim의 새로운 AI 기반 툴을 선보였습니다. 이러한 툴은 NVIDIA Omniverse 플랫폼과 NVIDIA Drive Map과 같은 기술을 활용하는 NVIDIA Research의 혁신 기술이 만든 것입니다.

또한 젠슨 황 CEO는 개발자들이 빠른 이터레이션(iteration)으로 여러 시나리오를 쉽게 테스트할 수 있는 방법도 함께 보여줬습니다.

시나리오가 일단 시뮬레이션으로 재구성되면, 마주 오는 자동차의 경로를 변경하거나 운전 경로에 장애물을 추가하는 일처럼 여러 다양한 변수를 구현할 수 있기 때문에 개발자들이 인공지능(AI) 운전 기술을 개선할 수 있는데요.

그러나 실제 운전 시나리오를 재구성하고 시뮬레이션을 통해 실제 데이터를 생성하는 일은 시간과 노동이 많이 소요되는 프로세스죠. 여기에는 숙련된 기술자와 아티스트가 필요하며, 이 모든 게 갖춰졌다고 하더라도 쉽게 할 수 있는 일이 아닙니다.

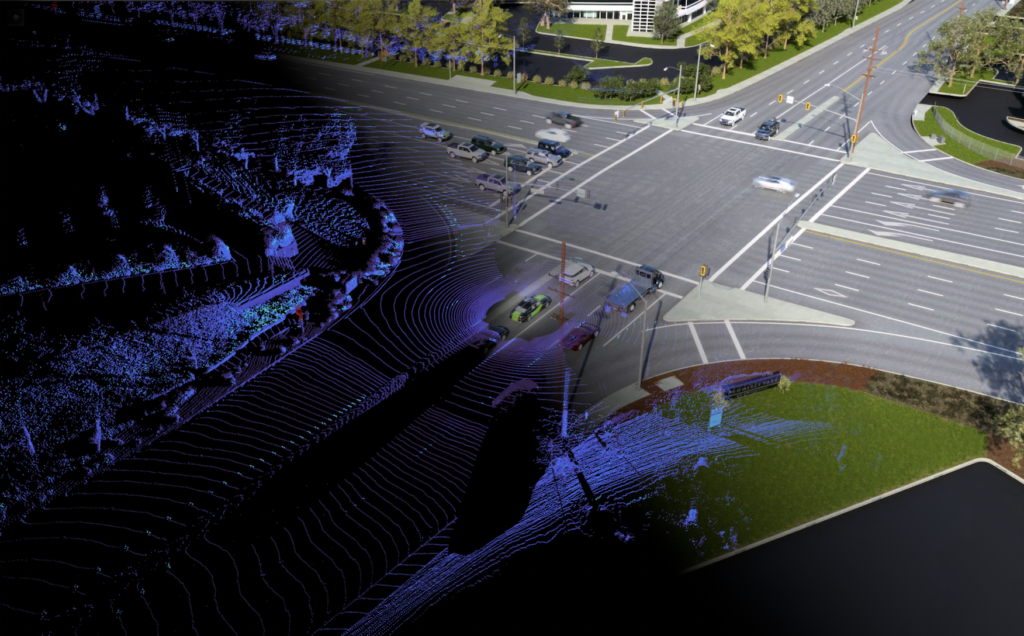

NVIDIA는 이 프로세스를 원활하게 수행하기 위해 가상 재구성, 신경 재구성이라는 두 가지 AI 기반 방법을 만들었습니다. 가상 재구성은 실제 시나리오를 완전히 합성된 3D 장면으로 복제하는 반면, 신경 재구성은 신경 시뮬레이션을 사용해 실제 센서 데이터를 확장하는 방법이죠.

두 방법 모두 단일 시나리오를 재생성하는 것은 물론 새롭고 도전적인 시나리오를 많이 생성할 수 있습니다. 이 기능은 지속적인 자율주행 자동차(AV) 훈련, 테르스, 검증 파이프라인을 가속화하죠.

가상 재구성

위의 키노트 동영상에는 NVIDIA Drive Map, Omniverse, Drive Sim을 사용해 3D로 재구성된 NVIDIA 본사 주변의 전체적인 운전 환경과 시나리오 세트가 소개됩니다.

Drive Map을 통해 개발자들은 Omniverse 도로망의 디지털 트윈에 액세스할 수 있죠. Omniverse에 구축된 툴을 사용해 세부적인 맵은 NVIDIA Drive Sim과 함께 사용할 수 있는 운전 시뮬레이션 환경으로 변환됩니다.

재구성된 시뮬레이션 환경을 통해 개발자는 실제 운전에서 얻은 카메라, 라이더, 자동차 데이터를 사용해 교차로에서의 위험한 상황이나 건설 지역 탐색 등과 같은 일들을 재현시킬 수 있습니다.

플랫폼의 AI가 시나리오 재구성을 도와줍니다. 먼저, 추적한 물체마다 AI는 카메라 이미지를 보고 DRIVE Sim 카탈로그에서 사용 가능한 가장 유사한 3D 애셋과 영상 속 객체의 색상과 가장 밀접하게 일치하는 색상을 찾습니다.

마지막으로, 추적된 물체의 실제 경로가 재생성 되긴 하지만 종종 폐색(occlusion) 현상 때문에 경로에 공백이 생기는데요. 이런 경우에는 AI 기반 트래픽 모델이 추적된 물체에 적용되어 움직임을 예측하고 경로의 공백을 채웁니다.

가상 재구성을 통해 개발자는 여러 새로운 시나리오를 만드는 물리적 기반 센서와 AI 동작 모델이 생성하는 고충실도 데이터를 통해 자율주행 자동차 시스템을 훈련하고 검증하면서 운전하기에 까다로운 상황을 찾을 수 있습니다. 또한 시나리오의 데이터를 통해 동작 모델을 훈련할 수도 있죠.

신경 재구성

신경 재구성 방식은 장면을 합성하여 생성하는 대신 신경 시뮬레이션에 의존하여 실제 센서 데이터를 가지고 시작해 이를 수정해 나갑니다.

자율주행 자동차(AV) 시스템의 성능을 테스트하기 위해 기록된 센서 데이터를 재생하는 프로세스인 센서 리플레이(Sensor replay)는 AV 개발에서 중요한 부분이죠. 이 프로세스는 오픈 루프(open loop)로 이루어져, 모든 데이터가 사전 기록되므로 AV 스택의 결정 사항들이 세상에 영향을 미치지 않습니다.

NVIDIA Research의 신경 재구성 방법의 프리뷰는 기록된 데이터를 완벽하게 반응하고 수정 가능한 세상으로 변환시킵니다. 이런 혁신적인 방법은 AV 스택과 운전 환경 간에 완벽한 상호작용과 클로즈드 루프(closed-loop) 테스트를 가능하게 하죠.

프로세스는 기록된 운전 데이터로 시작됩니다. AI는 장면에서 동적 물체를 파악하고 제거하여 새로운 뷰에서 렌더링할 수 있는 3D 환경으로 정확한 복제 세상을 생성합니다. 그 다음으로 동적 물체는 조명과 그림자를 고려해 현실적인 AI 기반 행동과 물리적 외관으로 3D 장면에 다시 삽입되죠.

그런 후에 AV 시스템은 만들어진 가상 세계에서 운전하고 이에 따라 장면(scene)이 변합니다. 장면은 실제 장면의 일부처럼 렌더링되고 환경과 물리적으로 상호작용할 수 있는 다른 가상 물체, 자동차, 보행자가 삽입되면서 증강현실로 더욱 복잡해지죠.

카메라와 라이더 등과 같이 자동차의 모든 센서는 AI를 이용해 현장에서 시뮬레이션이 가능합니다.

가능성이 넘치는 가상 세계

렌더링, 그래픽, AI에 대한 NVIDIA의 전문 기술이 이러한 새로운 접근법을 이끌어 나갑니다.

모듈식 플랫폼으로서 Drive Sim은 결정론적 시뮬레이션을 기반으로 이러한 기능을 지원합니다. 또한 자동차 역학, AI 기반 트래픽 모델, 시나리오 툴과 필요한 도구를 구축할 수 있는 포괄적인 소프트웨어 개발 키트(SDK)를 제공합니다.

이제 개발자들은 이 두 가지 강력한 새로운 AI 방식으로 현실 세계에서 가상 세계로 이동이 더욱 쉬워져 보다 빠른 자율주행 자동차(AV) 개발과 배치를 할 수 있게 됐습니다!