로스앤젤레스에서 열리는 최고의 컴퓨터 그래픽 콘퍼런스 시그래프 2023(SIGGRAPH 2023)에서 미국, 유럽, 이스라엘의 12개 이상의 대학과의 협업을 포함해 생성형 AI 및 뉴럴 그래픽을 발전시키는 약 20개의 엔비디아(NVIDIA) 연구 논문을 발표한다고 밝혔습니다.

개발자와 아티스트가 정지해 있거나 움직이는 이미지, 2D, 3D, 초현실적 및 환상적, 아이디어를 현실로 구현할 수 있도록 지원하는 최첨단 AI 연구들을 소개합니다.

해당 논문에는 텍스트를 개인화된 이미지로 변환하는 생성형 AI 모델, 정지 이미지를 3D 객체로 변환하는 인버스(inverse) 렌더링 도구, AI를 사용해 복잡한 3D 요소를 놀라운 사실감으로 시뮬레이션하는 뉴럴 물리학 모델, AI 기반 실시간 시각적 디테일 생성을 위한 새로운 기능을 제공하는 뉴럴 렌더링 모델 등이 포함됩니다.

엔비디아 연구원들의 최신 연구들은 깃허브(GitHub)에서 개발자들과 정기적으로 공유되며, 메타버스 애플리케이션 구축 및 운영을 위한 엔비디아 옴니버스(Omniverse) 플랫폼과 최근 발표된 시각 디자인용 맞춤형 생성형 AI 모델 파운드리 엔비디아 피카소(Picasso) 등의 제품에 적용되어 제공된다. 수년간의 엔비디아 그래픽 연구를 통해 최근 출시된 세계 최초의 패스 트레이싱(path-traced) AAA 타이틀 사이버펑크 2077 레이 트레이싱: 오버드라이브 모드(Cyberpunk 2077 Ray Tracing: Overdrive Mode)과 같은 게임에서 영화 스타일의 렌더링을 구현할 수 있었다.

올해 시그래프에서 발표된 연구 성과는 개발자와 기업이 로보틱스 및 자율주행차 훈련을 위한 가상 세계를 채울 합성 데이터를 빠르게 생성하는 데 도움이 될 것입니다. 또한 예술, 건축, 그래픽 디자인, 게임 개발 및 영화 분야의 크리에이터가 스토리보드, 사전 시각화 및 제작에 필요한 고품질 비주얼을 더욱 빠르게 제작할 수 있도록 지원합니다.

개인 맞춤형 AI: 맞춤형 텍스트-이미지 모델

텍스트를 이미지로 변환하는 생성형 AI 모델은 영화, 비디오 게임, 3D 가상 세계의 콘셉트 아트나 스토리보드를 제작하는 데 강력한 도구입니다. 텍스트-이미지 변환 AI 도구는 ‘어린이 장난감’과 같은 프롬프트를 크리에이터가 영감을 얻기 위해 사용할 수 있는 거의 무한한 시각적 이미지로 변환해 인형, 블록 또는 퍼즐 이미지를 생성할 수 있습니다.

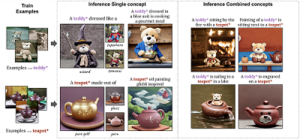

하지만 아티스트는 특정 주제를 염두에 두고 있을 수도 있습니다. 예를 들어 장난감 브랜드의 크리에이티브 디렉터는 새로운 테디 베어에 대한 광고 캠페인을 기획하면서 테디 베어 티파티와 같은 다양한 상황에서 장난감을 시각화하고자 할 수 있습니다. 텔아비브 대학교(Tel Aviv University)와 엔비디아의 연구원들은 구체적인 생성형 AI 모델 출력을 위해 사용자가 모델이 빠르게 학습할 수 있는 이미지 예시를 제공할 수 있는 두 개의 시그래프 논문을 발표했습니다.

한 논문에서는 하나의 예제 이미지만 있으면 출력을 맞춤 설정할 수 있는 기술을 설명하며, 단일 엔비디아 A100 텐서 코어(Tensor Core) GPU에서 개인화 프로세스를 몇 분에서 약 11초로 단축해 이전 개인화 접근 방식보다 60배 이상 빠른 처리 속도를 제공합니다.

두 번째 논문에서는 몇 개의 컨셉 이미지를 사용해 특정 테디 베어와 찻주전자 등 여러 개인화된 요소를 하나의 AI 생성 비주얼로 결합할 수 있는 퍼퓨전(Perfusion)이라는 매우 간결한 모델을 소개합니다:

3D로 서비스: 인버스 렌더링 및 캐릭터 생성의 발전

크리에이터가 가상 세계의 콘셉트 아트를 완성하면 다음 단계는 환경을 렌더링하고 3D 객체와 캐릭터로 채우는 것입니다. 엔비디아 리서치(Research)는 2D 이미지와 비디오를 3D 표현으로 자동 변환해 제작자가 그래픽 애플리케이션으로 가져와 추가 편집을 할 수 있도록 함으로써 시간이 오래 걸리는 이 프로세스를 가속화하는 AI 기술을 개발하고 있습니다.

캘리포니아대학교 샌디에이고(UCSD) 연구진과 함께 작성한 세 번째 논문에서는 하나의 2D 초상화를 기반으로 사실적인 3D 머리와 어깨 모델을 생성하고 렌더링할 수 있는 기술에 대해 설명합니다. 이는 AI로 3D 아바타 제작과 3D 화상 회의를 가능하게 하는 획기적인 기술입니다. 이 방법은 소비자 데스크톱에서 실시간으로 실행되며 기존의 웹캠이나 스마트폰 카메라만 사용해 사실적이거나 양식화된 3D 텔레프레전스(telepresence)를 생성할 수 있습니다.

네 번째 프로젝트는 스탠퍼드 대학교(Stanford University)와의 협업으로 3D 캐릭터에 실제와 같은 움직임을 구현합니다. 연구진은 실제 테니스 경기의 2D 비디오 녹화에서 다양한 테니스 기술을 학습하고 이 모션을 3D 캐릭터에 적용할 수 있는 AI 시스템을 개발했습니다. 시뮬레이션된 테니스 선수는 가상 코트에서 목표 위치에 정확하게 공을 칠 수 있으며, 다른 캐릭터와 긴 랠리를 펼칠 수도 있습니다.

이러한 시그래프 논문은 테니스 테스트 사례 외에도 고가의 모션 캡처 데이터를 사용하지 않고도 사실적인 움직임으로 다양한 기술을 수행할 수 있는 3D 캐릭터를 제작해야 하는 어려운 과제를 해결했습니다.

머리카락 한 올도 어긋남이 없다: 뉴럴 물리학으로 구현하는 사실적인 시뮬레이션

3D 캐릭터가 생성되면 아티스트는 머리카락과 같은 사실적인 디테일을 레이어링할 수 있는데, 이는 애니메이터에게 복잡하고 비용이 많이 드는 과제입니다.

사람의 머리에는 평균 10만 개의 머리카락이 있으며, 각 머리카락은 개인의 움직임과 주변 환경에 동적으로 반응합니다. 전통적으로 크리에이터는 물리 공식을 사용해 머리카락의 움직임을 계산하고, 사용 가능한 리소스에 따라 움직임을 단순화하거나 근사치를 구했다. 그렇기 때문에 대작 영화의 가상 캐릭터는 실시간 비디오 게임 아바타보다 훨씬 더 세밀한 머리카락을 자랑합니다.

다섯 번째 논문에서는 뉴럴 네트워크에 물체가 현실 세계에서 어떻게 움직일지 예측하도록 학습시키는 AI 기술인 뉴럴 물리학을 사용해 수만 개의 머리카락을 고해상도로 실시간으로 시뮬레이션할 수 있는 방법을 소개합니다.

실물 크기의 머리카락을 정확하게 시뮬레이션하기 위한 새로운 접근 방식은 특히 최신 GPU에 최적화되어 있습니다. 이 기술은 최첨단 CPU 기반 솔버에 비해 성능이 크게 향상돼 며칠이 걸리던 시뮬레이션 시간을 단 몇 시간으로 단축하는 동시에 실시간으로 가능한 헤어 시뮬레이션의 품질을 향상시킵니다. 이 기술을 통해 마침내 정확하고 인터랙티브한 물리 기반 헤어 그루밍을 구현할 수 있게 됐습니다.

뉴럴 렌더링, 실시간 그래픽에 영화 퀄리티의 디테일 제공

주변 환경을 동영상 3D 객체와 캐릭터로 채운 후, 실시간 렌더링은 가상의 장면을 통해 반사되는 빛의 물리학을 시뮬레이션합니다. 최근 엔비디아의 연구는 질감, 재질, 용량을 위한 AI 모델이 비디오 게임과 디지털 트윈에서 어떻게 영화 퀄리티의 사실적인 시각 자료를 실시간으로 제공할 수 있는지를 보여줍니다.

엔비디아는 20여 년 전 프로그래밍이 가능한 셰이딩(programmable shading)을 발명해 개발자가 그래픽 파이프라인을 맞춤 설정할 수 있도록 했습니다. 이번 최신 뉴럴 렌더링 발명에서, 연구진들은 프로그래밍 가능한 셰이딩 코드를 엔비디아의 실시간 그래픽 파이프라인 내부에서 실행되는 AI 모델로 확장합니다.

엔비디아는 여섯 번째 시그래프 논문에서 GPU 메모리를 추가로 사용하지 않고 최대 16배 더 많은 질감 세부 정보를 제공하는 뉴럴 질감 압축을 발표할 예정입니다. 뉴럴 질감 압축은 아래 이미지에서 보이는 것처럼 3D 장면의 사실성을 크게 높일 수 있으며, 이는 뉴럴 압축 질감(우측)이 글자가 흐릿하게 남아있는 이전의 형식(가운데 사진)보다 더 선명하게 세부 사항을 캡처하는 방법을 보여줍니다.

뉴럴 질감 압축(우측)은 GPU 메모리를 추가로 사용하지 않고 이전 질감 형식보다 최대 16배 더 많은 질감 세부 정보를 제공한다.

작년 발표된 관련 논문은 뉴럴VDB(NeuralVDB)로서의 얼리 액세스 버전으로 제공됩니다. 해당 기술은 연기, 불, 구름, 물과 같은 용량 데이터 표현에 필요한 메모리를 100배까지 줄일 수 있는 AI 기반의 데이터 압축 기술입니다.

또한 엔비디아는 최근 엔비디아 GTC 기조연설에서 보여준 뉴럴 머티리얼(neural material) 연구에 대한 자세한 내용을 발표했습니다. 이 논문은 빛이 사실적인 여러 겹의 재료에서 반사되는 방식을 학습해 에셋의 복잡성을 실시간으로 실행되는 작은 뉴럴 네트워크로 축소해 최대 10배 빠른 셰이딩을 구현하는 AI 시스템에 대해 설명합니다.

세라믹, 불완전한 투명 유약, 지문, 얼룩, 먼지까지 정확하게 표현하는 뉴럴 렌더링 찻주전자에서 사실감의 수준을 확인할 수 있습니다.

뉴럴 머티리얼 모델은 빛이 사실적인 여러 겹의 재료에서 반사되는 방식을 학습합니다.

더 많은 생성형 AI 및 그래픽 연구

시그래프에서 모든 엔비디아 논문에 대한 자세한 내용을 확인할 수 있습니다. 또한 엔비디아는 이번 콘퍼런스에서 패스 트레이싱, 텔레프레전스, 생성형 AI 확산 모델 등의 주제로 6개의 코스, 4개의 강연, 2개의 신흥 기술 데모를 선보입니다.

엔비디아 리서치에는 AI, 컴퓨터 그래픽, 컴퓨터 비전, 자율주행차, 로보틱스 등의 주제에 중점을 둔 팀과 함께 전 세계 수백 명의 과학자와 엔지니어가 있습니다.