3월 19일 목요일, 오후 2시 30분 PT 🔗

AI 합창으로 돌아보는 GTC 기조연설

올해 GTC 키노트는 로봇들과 TJ — NVIDIA 창립자 겸 CEO 젠슨 황의 AI 아바타인 토이 젠슨(Toy Jensen) — 가 모닥불 주위에 모여 마시멜로를 구우며 노래로 이번 행사의 주요 발표 내용을 되돌아보는 장면으로 마무리됐습니다.

획기적인 AI부터 가속 컴퓨팅까지, 핑거피킹 기타 연주와 하모니카 소리, 그리고 로봇들이 가득한 이 노래는 미래를 만들어가는 혁신들을 생생하게 담아냈습니다.

기조연설 시청자들에게 깜짝 피날레로 선보인 이 애니메이션 영상은 NVIDIA 크리에이티브 팀이 생성형 AI 도구를 활용해 제작했습니다. AI 음악 생성기로 곡을 작곡하는 실험을 거친 후, 팀의 한 영상 편집자가 로봇들이 소박한 모닥불 옆에서 음악을 연주하는 아이디어를 떠올렸습니다.

팀은 이미지 및 영상 생성·편집을 위한 다양한 AI 모델을 결합해 피드백과 수정 사항을 유연하게 반영할 수 있는 애니메이션 제작 파이프라인을 구축했습니다. 또 다른 모델은 일관된 캐릭터 및 모델 데이터베이스를 생성하고 유지하는 데 활용됐습니다.

로봇들은 드럼, 기타, 마라카스를 받았고, NVIDIA NemoClaw에 대한 경의로 랍스터가 추가되었으며, 다른 팀들은 로봇 개와 물론 TJ를 위한 참고 이미지를 제공했는데, TJ의 가죽 재킷은 체크무늬 셔츠로 교체되었습니다.

영상 위에는 노래가 덧입혀집니다. 기조연설 며칠 전, 팀은 주요 GTC 발표 내용을 요약하는 데 집중하기로 했습니다. 이를 생생하게 구현하기 위해 작가와 영화 제작자가 NVIDIA 마케팅 리더들과 협력하여 가사를 작성하고 음악을 다듬었으며, 소박한 캠프파이어 테마에 맞췄습니다.

월요일, 3월 16일, 오전 11:00 (태평양 표준시) 🔗

GTC 기조연설 실시간 업데이트

GTC 2026에 오신 것을 환영합니다

SAP 센터를 가득 채운 관중이 모두 같은 것을 기다리고 있었습니다.

키노트는 토큰을 현대 AI의 기본 단위—과학적 발견, 가상 세계, 물리적 세계에서 작동하는 기계에 사용되는 시스템의 구성 요소—로 정의하는 영상으로 시작되었습니다.

이어서 NVIDIA 젠슨 황 CEO가 관중의 우레와 같은 박수를 받으며 무대에 올랐습니다.

그는 프리쇼 진행자들에게 감사를 전하고, 쇼에 참여한 파트너들과 함께 450개 이상의 스폰서, 1,000개의 세션, 2,000명의 발표자를 소개했습니다.

“이번 컨퍼런스는 인공지능의 5단 케이크의 모든 단계를 다룰 것입니다”라고 황 CEO는 말했습니다.

그는 CUDA 20주년을 기념하며, CUDA를 가속 컴퓨팅을 이끄는 “플라이휠”이자 “AI 라이프사이클의 모든 단계”를 지원하는 플랫폼으로 설명했습니다.

젠슨 황 CEO는 GeForce로 화제를 돌리며 NVIDIA를 “GeForce가 만든 집”이라 표현하고, CUDA를 세상에 알린 플랫폼이라고 소개했습니다. 그는 GeForce의 역사를 살펴보며 AI와의 연결고리를 짚었고, DLSS 5를 발표하며 3D 기반 뉴럴 렌더링이 로컬 하드웨어에서 실시간 포토리얼 4K 성능을 구현하는 방법을 보여주는 영상을 공개했습니다. 자세한 내용은 보도자료에서 확인하세요.

다음으로, 황 CEO는 데이터 처리 분야와 AI 시대를 위한 가속화 현황을 설명했습니다. 그는 IBM, Dell, Google Cloud, AWS, Microsoft Azure, Oracle, CoreWeave와의 협력을 통해 고객을 지원하는 내용을 상세히 다뤘습니다.

젠슨 황 CEO는 이어서 가속 컴퓨팅 생태계—자동차, 금융 서비스, 헬스케어, 산업, 미디어, 양자 컴퓨팅, 리테일, 로보틱스, 통신—를 조망했습니다.

“이 모든 다양한 AI 벡터에는 NVIDIA가 제공하는 플랫폼이 있습니다”라고 젠슨 황 CEO는 말하며, NVIDIA의 광범위한 CUDA-X 라이브러리를 강조했고, 이를 회사의 “왕관의 보석”이라고 표현했습니다.

젠슨 황 CEO는 “AI 네이티브”의 부상을 강조했습니다 — OpenAI와 Anthropic처럼 잘 알려진 곳도 있고 아직 떠오르는 곳도 있는, 완전히 새로운 기업들입니다. “지난 한 해, 그야말로 폭발적으로 성장했습니다”라고 Huang은 말하며, 벤처 스타트업에 대한 1,500억 달러의 투자를 언급하고 최근의 기술 붐을 촉발한 기술들의 역사를 설명했습니다.

이 붐의 결과로, NVIDIA GPU에 대한 컴퓨팅 수요는 “차트를 벗어날 정도”라고 그는 말했습니다. “저는 지난 몇 년간 컴퓨팅 수요가 100만 배 증가했다고 생각합니다.”

그 결과, 젠슨 황 CEO는 2025년부터 2027년까지 최소 1조 달러의 매출을 전망한다고 밝혔습니다.

Vera Rubin과 그 너머 — 컴퓨팅의 세대적 도약

젠슨 황 CEO는 NVIDIA의 토큰 비용이 세계 최고 수준이라고 언급했는데, 이는 극단적인 공동 설계 덕분이라며 한 애널리스트가 NVIDIA를 “추론의 왕”이라고 표현한 것에 기뻐했습니다. “이것이 극단적인 공동 설계의 놀라운 힘입니다”라고 젠슨 황 CEO는 말하며, 소프트웨어와 실리콘이 함께 설계되는 프로세스를 언급했습니다.

다음 단계: NVIDIA Vera Rubin, 에이전틱 AI를 위한 7개의 칩, 5개의 랙 스케일 시스템, 1개의 슈퍼컴퓨터로 구성된 새로운 풀 스택 컴퓨팅 플랫폼입니다. 이 플랫폼에는 새로운 NVIDIA Vera CPU와 BlueField-4 STX 스토리지 아키텍처가 포함됩니다.

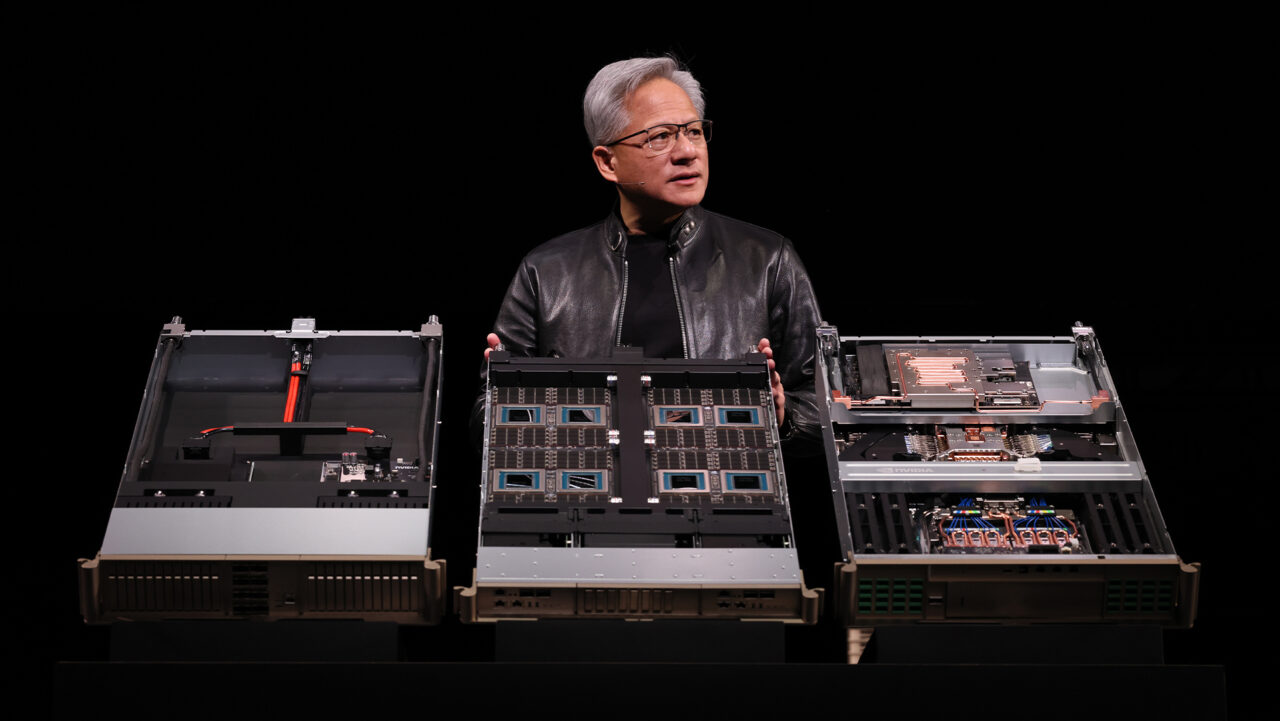

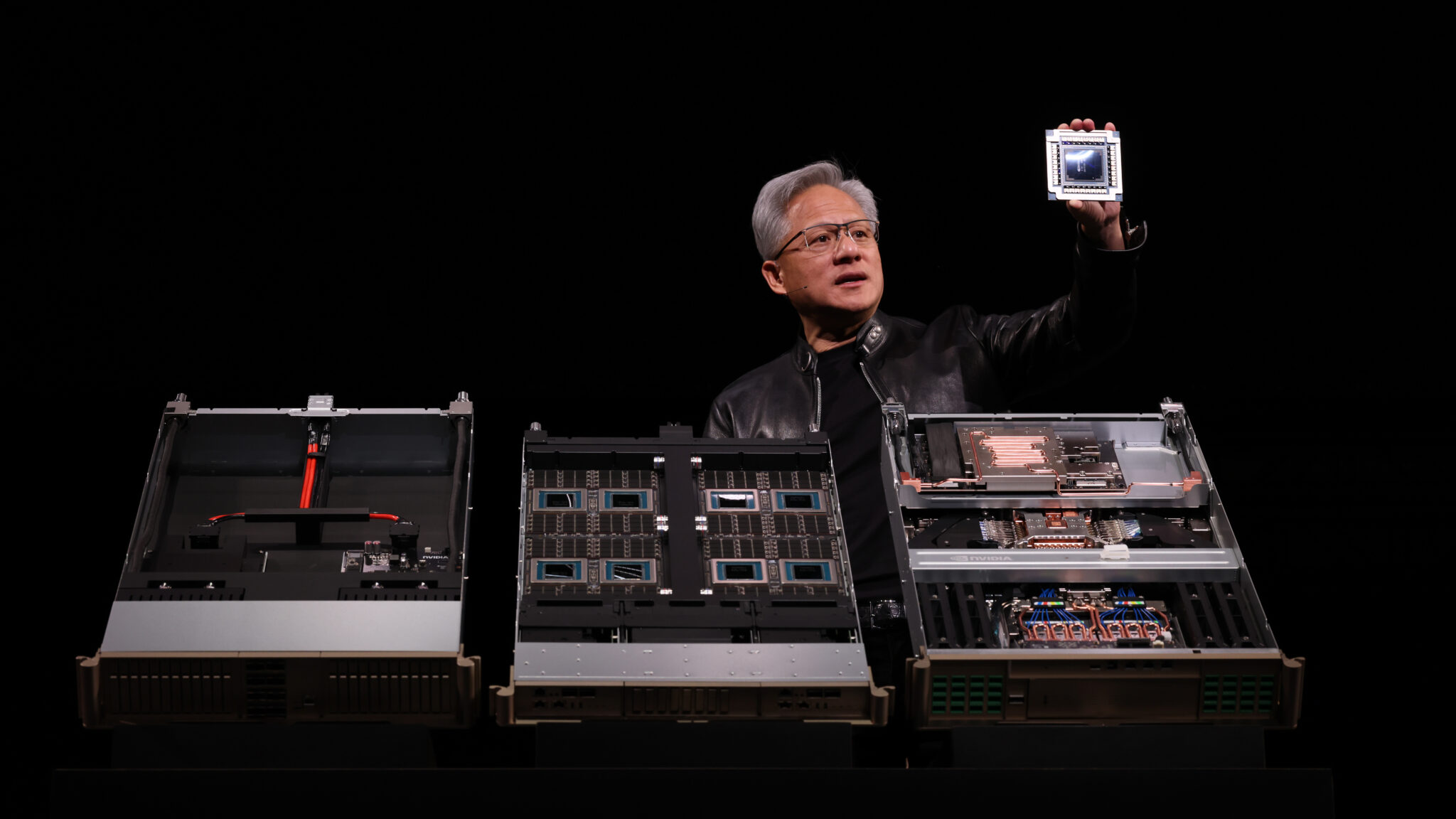

“Vera Rubin을 생각할 때, 우리는 소프트웨어를 포함해 수직 통합되고, 엔드 투 엔드로 확장되며, 하나의 거대한 시스템으로 최적화된 전체 시스템을 생각합니다”라고 젠슨 황 CEO는 말하며 청중에게 이러한 기술을 기반으로 구축된 새로운 시스템의 내부를 소개했습니다.

Vera Rubin을 넘어, NVIDIA의 차세대 주요 아키텍처는 Feynman입니다.

이 아키텍처에는 새로운 CPU인 NVIDIA Rosa가 포함될 예정이라고 황 CEO는 밝혔습니다. Rosa는 로잘린드 프랭클린의 이름을 딴 것으로, 그녀의 X선 결정학 연구는 DNA의 구조를 밝혀내어 현대 생물학을 재편했습니다. 프랭클린이 생명의 숨겨진 구조를 드러냈듯이, Rosa는 에이전트 AI 인프라 전체 스택에서 데이터, 도구, 토큰을 효율적으로 이동시키도록 설계되었습니다.

Rosa는 NVIDIA의 차세대 LPU인 LP40, NVIDIA BlueField‑5, CX10을 결합한 새로운 플랫폼의 핵심으로, 구리 및 공동 패키지 광학 스케일업을 위한 NVIDIA Kyber와 NVIDIA Spectrum급 광학 스케일아웃을 통해 연결된다고 황 CEO는 밝혔습니다. Feynman 세대는 AI 팩토리의 모든 핵심 요소인 컴퓨팅, 메모리, 스토리지, 네트워킹, 보안을 전반적으로 발전시킵니다.

또한 새로운 AI 용량의 스케일아웃 가속화를 위해, 황 CEO는 NVIDIA Vera Rubin DSX AI 팩토리 레퍼런스 디자인과 NVIDIA Omniverse DSX Blueprint를 발표했습니다. DSX Air는 광범위한 DSX 플랫폼의 일부로, 기업들이 물리적 세계에 구축하기 전에 소프트웨어로 AI 팩토리를 시뮬레이션할 수 있게 해줍니다.

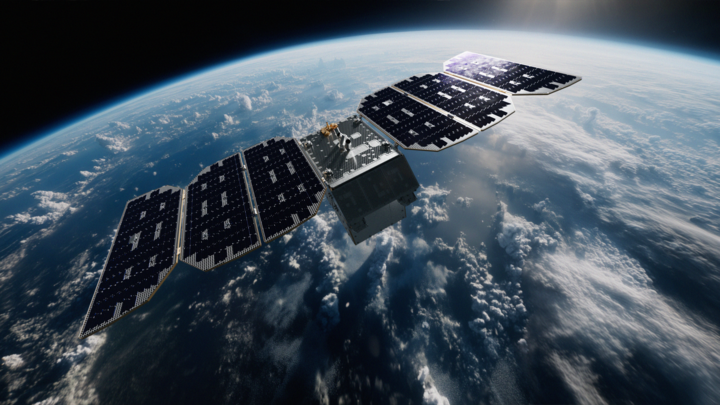

마지막으로, 젠슨 황 CEO는 NVIDIA가 우주로 진출한다고 발표했습니다. 새로운 Vera Rubin 아키텍처는 암흑 물질을 발견한 천문학자의 이름을 기리며, NVIDIA Space-1 Vera Rubin과 같은 미래 시스템은 AI 데이터 센터를 궤도로 가져와 지구에서 우주로 가속 컴퓨팅을 확장하도록 설계되고 있습니다.

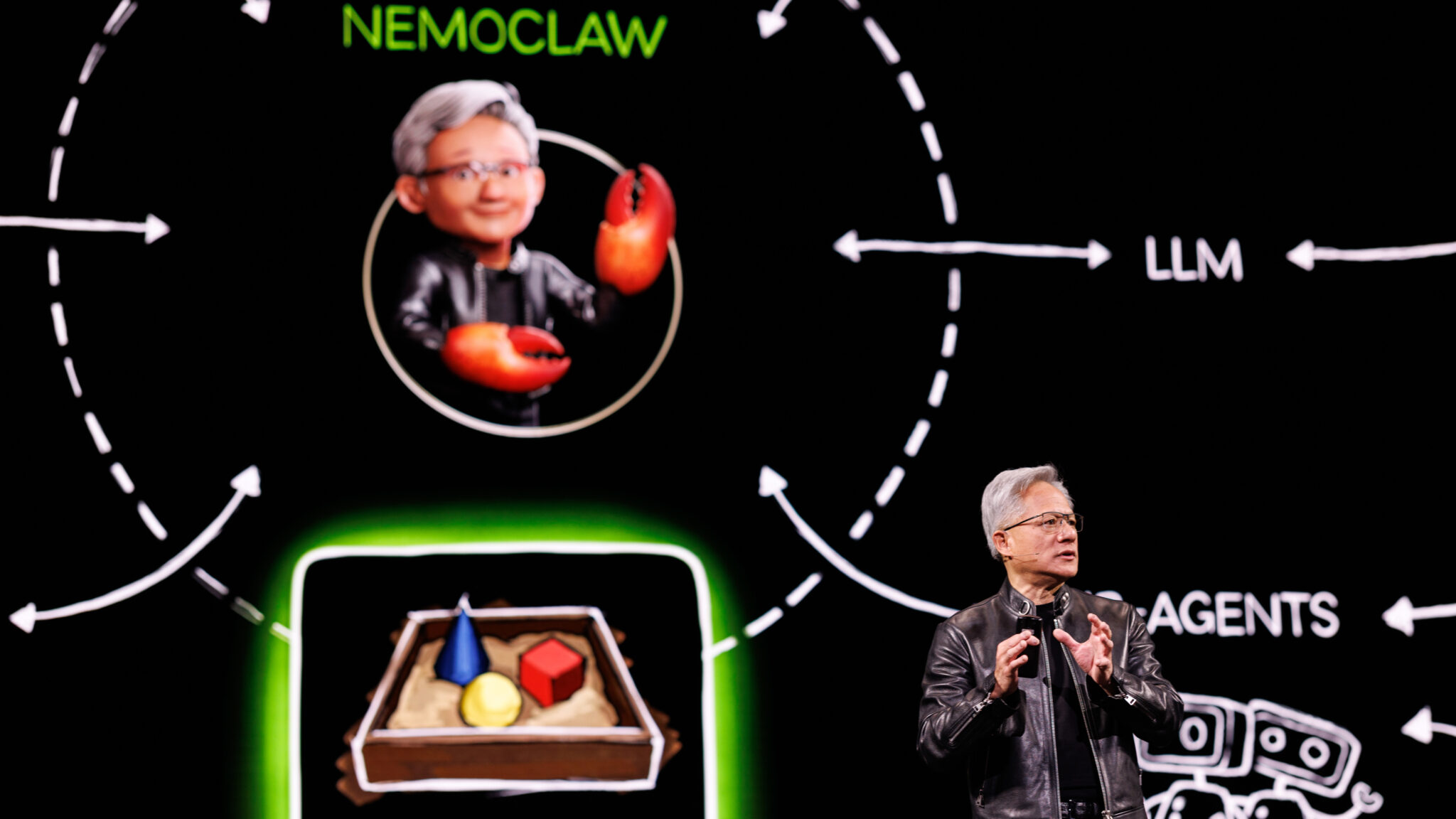

NVIDIA NemoClaw for OpenClaw, Nemotron Coalition

젠슨 황 CEO는 개발자 Peter Steinberger의 오픈 소스 프로젝트인 OpenClaw를 소개하며, “인류 역사상 가장 인기 있는 오픈 소스 프로젝트”라고 칭했습니다.

“OpenClaw는 에이전트 컴퓨터의 운영 체제를 오픈 소스화했습니다… 이제 OpenClaw 덕분에 우리는 개인 에이전트를 만들 수 있게 되었습니다”라고 황 CEO는 말했습니다.

단 하나의 명령어로 개발자들은 OpenClaw를 가져오고, AI 에이전트를 실행하며, 도구와 컨텍스트로 확장하기 시작할 수 있습니다. NVIDIA는 자사 플랫폼 전반에 걸쳐 OpenClaw 지원을 발표하며, 개발자들이 NVIDIA 기반 인프라에서 AI 에이전트를 안전하게 구축, 배포, 가속화하는 것을 더욱 쉽게 만들고 있습니다.

오늘날 전 세계 모든 기업이 OpenClaw 전략을 보유해야 한다고 젠슨 황 CEO는 말했습니다.

이 기술이 기업 내부에서 안전하게 배포될 수 있도록, 젠슨 황 CEO는 NVIDIA OpenShell 런타임과 NVIDIA NemoClaw 스택을 공개했습니다. 이는 정책 집행, 네트워크 가드레일, 프라이버시 라우팅을 결합한 것입니다. 황 CEO는 이 기술들이 “전 세계 모든 SaaS 기업의 정책 엔진” 역할을 할 수 있다고 말했습니다.

또한 NVIDIA는 오픈 모델 생태계를 새로운 Nemotron Coalition으로 확장하며, 6개의 프론티어 모델 패밀리를 중심으로 파트너들을 결집시키고 있습니다: NVIDIA Nemotron(언어 및 추론), NVIDIA Cosmos(세계 및 비전), NVIDIA Isaac GR00T(범용 로보틱스), NVIDIA Alpaymayo(자율 주행), NVIDIA BioNeMo(생물학 및 화학), NVIDIA Earth‑2(날씨 및 기후).

피지컬 AI

NVIDIA는 AI를 디지털 에이전트에서 실제 세계를 탐색할 수 있는 피지컬 AI로 확장하고 있습니다.

젠슨 황 CEO는 NVIDIA의 로보택시 지원 플랫폼이 BYD, 현대, 닛산, 지리 등 새로운 완성차 파트너들을 끌어들이고 있다고 밝혔습니다.

또한 이 차량들을 Uber의 차량 호출 네트워크에 배포하기 위한 Uber와의 파트너십도 강조했습니다.

완성차 업체 외에도 NVIDIA는 산업용 소프트웨어 기업들과 ABB, Universal Robots, KUKA 등 로보틱스 선도 기업들과 협력하여 피지컬 AI 모델과 시뮬레이션 툴을 통합함으로써 제조 라인에 더욱 스마트한 로봇 배포를 가능하게 하고 있으며, T‑Mobile과 같은 통신 사업자들과도 협력하여 기지국이 엣지 AI 플랫폼으로 진화하고 있습니다.

마치며

젠슨 황 CEO는 디즈니 애니메이션 겨울왕국의 눈사람 캐릭터 올라프의 깜짝 등장으로 기조연설을 마무리했습니다. 올라프는 디지털 스크린에서 곧장 무대 위로 걸어 나오는 듯한 모습을 연출했습니다.

“신사 숙녀 여러분, Olaf입니다.” Huang이 말하자, 캐릭터가 뒤뚱뒤뚱 걸어 나왔습니다. NVIDIA의 물리적 AI 스택인 Newton 물리 엔진과 NVIDIA Omniverse 기반 시뮬레이션으로 구동되었습니다.

“Olaf, 잘 지냈어? 내가 네 컴퓨터를 줬으니 알지 — Jetson이야.” 젠슨 황 CEO가 농담을 건넸습니다.

Olaf가 그게 뭐냐고 묻자 젠슨 황 CEO는 이렇게 답했습니다. “글쎄, 네 배 속에 있어 … 그리고 Omniverse 안에서 걷는 법을 배웠지.”

이 데모는 젠슨 황 CEO의 핵심 메시지를 뒷받침했습니다. 휴머노이드 로봇부터 애니메이션 캐릭터까지, 화면에 등장한 모든 것은 사전 렌더링이 아닌 시뮬레이션으로 구현된 것이었습니다.

젠슨 황 CEO는 추론, AI 팩토리, OpenClaw, 물리적 AI와 로보틱스 등 주요 주제를 정리한 뒤, 무대를 음악 앙상블에게 넘겼습니다. 노래하는 로봇들, 디지털 Jensen 아바타, 그리고 애니메이션 바닷가재가 캠프파이어 노래를 선보였습니다.

“자, 즐거운 GTC 되세요.” 젠슨 황 CEO는 무대 왼쪽으로 퇴장했고, Olaf는 무대 위에 남아 관객들에게 한껏 재롱을 부리다 무대 아래 트랩 도어로 사라졌습니다.

온라인 프레스킷에서 GTC의 모든 NVIDIA 뉴스를 확인하세요.

3월 16~19일 GTC 파크 내 NVIDIA build-a-claw 이벤트에서 나만의 에이전트를 만들어보세요. 월요일 오후 1~5시, 화~목요일 오전 8시~오후 5시에 운영되며, 능동적으로 항상 작동하는 AI 어시스턴트를 맞춤 설정하고 배포할 수 있습니다.

태평양 표준시 3월 11일 수요일 오전 9시 🔗

GTC 파크의 Build-a-Claw

GTC 참가자들은 역사상 가장 빠르게 성장하는 오픈소스 프로젝트인 OpenClaw를 사용해 “claw”, 즉 장기 실행 에이전트를 가장 먼저 직접 체험해볼 수 있습니다.

3월 16~19일 GTC 파크의 NVIDIA build-a-claw 이벤트에 들러보세요. 월요일 오후 1~5시, 화~목요일 오전 8시~오후 5시 중 언제든지 방문하시면 능동적으로 항상 작동하는 AI 어시스턴트를 맞춤 설정하고 배포할 수 있습니다.

NVIDIA 전문가들의 지원을 받아, GTC 참석자들은 손쉽게 AI 에이전트를 활용할 수 있습니다. 기술 전문가든 단순한 호기심을 가진 참가자든, 에이전트의 이름을 정하고, 성격을 설정하며, 필요한 도구에 대한 접근 권한을 부여할 수 있습니다. 원하는 메시지 앱을 통해 접근할 수 있는, 늘 원해왔던 개인 비서라고 생각하면 됩니다.

맞춤형 에이전트를 실행하려면, 현장에서 제공되는 클라우드 컴퓨팅을 사용하거나, 개인 데이터 없이 NVIDIA DGX Spark 또는 GeForce RTX 노트북을 지참하여 로컬 가속 컴퓨팅을 활용할 수 있습니다. DGX Spark 시스템은 현장의 NVIDIA Gear Store와 Micro Center에서도 구매할 수 있습니다.

이 상시 작동하는 AI 어시스턴트는 일정 관리, 휴가지 추천, 새로운 운동 루틴 제안, 유용한 앱 코딩 등 거의 모든 작업에 활용할 수 있습니다. 전문가형이나 제너럴리스트형으로 설정할 수 있으며, 지시에 따라 지속적으로 새로운 기술을 습득하고 새로운 발견 사항을 사용자에게 알려줍니다.

이번 행사에 참여한 NVIDIA 머신러닝 엔지니어 Sidney Knowles는 “다양한 관점을 가진 분들이 참여했다”고 말했습니다. 백팩에 DGX Spark를 담아 직접 제작할 준비를 마친 기술 전문가부터, OpenClaw 데모를 처음 보고 싶어 하는 비기술 분야 열정가까지 다양했습니다.

행사에 참여한 개발자들은 시장 조사 및 광고부터 통신, 금융 서비스, 물리적 AI에 이르기까지 다양한 산업 분야에 걸쳐 AI 에이전트를 구축했다고 그녀는 말했습니다.

하지만 모든 참가자들이 비슷한 수준의 기대와 호기심을 가지고 왔으며, Knowles는 결국 하나의 질문으로 귀결됐다고 말했습니다: “AI가 나를 위해 무엇을 할 수 있을까?”

Nationwide의 소프트웨어 엔지니어링 컨설턴트 Clayton Littlejohn은 DGX Spark를 build-a-claw 행사에 가져와 보험 업계의 물리적 AI 준비도를 평가하는 AI 에이전트를 만들었습니다.

“DGX Spark의 가장 큰 장점은 신기술, 특히 풀스택 기술을 활용해 문제를 빠르게 프로토타이핑할 수 있다는 것입니다”라고 Littlejohn은 말했습니다.

DGX Spark의 매력은 모든 것을 로컬에 유지하면서도 가능성의 예술을 선보일 수 있다는 점이라고 그는 덧붙였습니다.

“NVIDIA NemoClaw는 이를 엔터프라이즈 방식으로 구현하여, 가드레일을 신뢰하고 활용하면서 워크플로우에 적용할 수 있게 해줍니다”라고 그는 덧붙였습니다. “이것은 우리가 이전에 결코 보지 못했던 것들을 열어주고 있습니다 — 가능성은 무한합니다.”

Knowles(왼쪽)와 Littlejohn(오른쪽).

자세한 내용은 NVIDIA의 새로운 OpenClaw 플레이북을 살펴보세요. DGX Spark에서 OpenClaw를 실행하기 위한 단계별 가이드입니다. 이 플레이북은 개발자들이 클라우드에 의존하지 않고 파일, 앱, 워크플로와 직접 연동되는 상시 가동형 로컬 우선 AI 에이전트를 구축할 수 있도록 도와줍니다.

업데이트를 계속 확인하고 GTC의 전체 이벤트 및 활동 일정을 확인하세요.

목요일, 3월 19일, 오후 5:30 PT 🔗

Toy Jensen의 홀로그래픽 AI 에이전트, 일명 TJ, GTC 전시장에 등장

NVIDIA 창업자 겸 CEO 젠슨 황이 GTC 곳곳에 있는 것처럼 보였다면, 실제로 그랬습니다. 적어도 Toy Jensen의 홀로그래픽 AI 에이전트 — 친구들에게는 TJ로 불리는 — 가 그랬습니다.

NVIDIA 하드웨어 및 소프트웨어 — NVIDIA Nemotron 오픈 모델, NVIDIA NIM 마이크로서비스 등 — 를 활용한 LiveX.ai의 완전 에이전틱 플랫폼 위에 구축된 18개의 TJ 아바타가 투명한 용기 안에서 대기하며 참석자들의 컨퍼런스 관련 질문과 물리적 AI, 가속 컴퓨팅, AI 에이전트의 최신 동향에 대한 질문에 답했습니다.

물론, 에이전트 TJ는 참석자들이 원하는 만큼 사진 촬영에도 기꺼이 응했습니다. 그 중에는 TJ의 원래 모델인 황 자신도 있었는데, 자신의 또 다른 홀로그래픽 자아와 셀카를 찍었습니다.

LiveX.ai가 소매 매장, 스포츠 이벤트 및 기타 소비자 경험을 혁신하는 물리적 AI 에이전트를 어떻게 개발하고 있는지 LiveX 창업자 Jia Li와 함께하는 NVIDIA AI 팟캐스트를 통해 자세히 알아보세요.

수요일, 3월 18일, 오전 10시 PT 🔗

NVIDIA, 차세대 AI를 선도하는 아메리카 파트너들 축하

NVIDIA는 2026년 아메리카 NVIDIA 파트너 네트워크(NPN) 수상자들을 선정하여 시상합니다. 이들은 지역 전반에 걸쳐 AI 혁신, 실행 및 산업적 영향력의 차세대 물결을 이끌고 있습니다. 이 파트너들은 가속 컴퓨팅, 네트워킹 및 NVIDIA AI Enterprise 소프트웨어를 아우르는 NVIDIA의 풀스택 플랫폼을 통해 고객들이 파일럿에서 프로덕션으로 전환할 수 있도록 지원하고 있습니다.

올해 아메리카 수상자들에는 떠오르는 신진 파트너, AI 우수 파트너, 첨단 기술 파트너뿐만 아니라 네트워킹, 컨설팅 및 글로벌 시스템 통합 분야의 리더들이 포함됩니다. 이들은 인프라를 현대화하고, 운영을 효율화하며, 아메리카 전역 고객들을 위한 새로운 제품과 서비스를 창출하고 있습니다.

올해 선정된 파트너들은 고등 교육, 정부, 의료, 금융 서비스, 소매, 통신, 에너지 및 유틸리티 등 주요 산업의 혁신을 이끌고 있습니다. 이들은 NVIDIA와 함께 조직이 AI를 적용하여 효율성을 높이고, 경험을 향상시키며, 기업과 지역 사회에 중요한 복잡한 과제를 해결할 수 있도록 돕고 있습니다.

지역 및 유통 파트너들은 현지 전문 지식과 서비스를 바탕으로 NVIDIA AI 인프라와 파트너 솔루션을 모든 규모의 고객에게 제공함으로써 이 같은 영향력을 더욱 확대하고 가치 실현 시간을 앞당기고 있습니다.

NVIDIA는 2026년 아메리카 NPN 어워드 수상자 전원을 축하하며, 아메리카 전역에서 AI의 새로운 물결을 이끄는 지속적인 협력에 감사드립니다.

Physical AI 🔗

태평양 표준시 기준 3월 16일(월) 오후 1:30 🔗

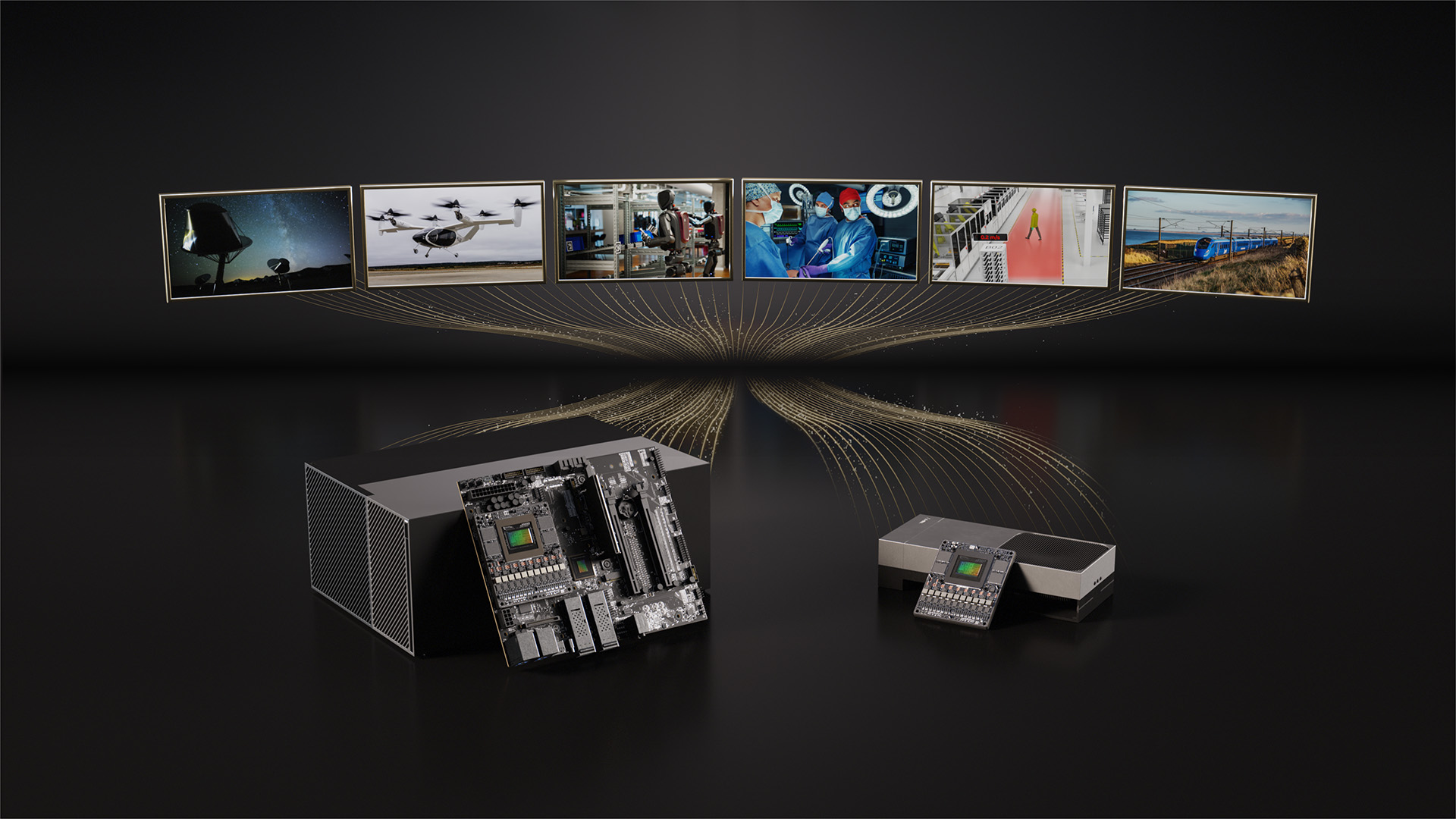

NVIDIA IGX Thor 정식 출시, 산업용 엣지에서 실시간 Physical AI 구현

산업계가 경직된 자동화를 넘어 Physical AI로 나아감에 따라, 복잡한 환경에서 자율적이고 안전 필수적인 기계를 구동하기 위한 실시간 센싱 및 추론이 가능한 새로운 차원의 지능형 엣지 컴퓨팅 장치가 필요해지고 있습니다.

이러한 수요를 충족하기 위해, NVIDIA IGX Thor가 정식 출시되었습니다. 이는 고속 센서 처리, 엔터프라이즈급 신뢰성 및 기능적 안전성을 갖추고 엣지에서 실시간 physical AI를 제공하는 강력한 산업용 플랫폼입니다.

업계 선도 기업들, IGX Thor로 Physical AI 확장

NVIDIA IGX Thor는 건설, 제조, 물류, 의료 및 생명과학, 나아가 우주 탐사 분야의 엣지 애플리케이션을 강화합니다.

Caterpillar는 IGX Thor를 기반으로 작업자 생산성과 안전성을 향상시키는 차내 대화형 AI 어시스턴트를 개발 중이며, Hitachi Rail은 IGX Thor를 활용하여 철도 네트워크에 고급 예측 유지보수 및 자율 검사 시스템을 배포하고 있습니다.

공급망 솔루션 기업 KION Group은 IGX Thor와 NVIDIA Halos Outside-In Safety 워크플로우를 활용하여 “아웃사이드-인(outside-in)” 인식을 구현하고 있습니다. 이는 AI 에이전트가 인프라에 설치된 카메라와 동적 가상 안전 펜스를 사용하여 자율 로봇 기능 안전 메커니즘을 강화하는 방식입니다. SICK와 같은 생태계 파트너들은 센서 역량 안전 핵심 애플리케이션을 통해 자율 산업용 로봇의 인증을 가속화하고 있습니다.

Agility와 Hexagon Robotics는 안전한 휴머노이드 로봇을 위한 실시간 AI 추론 및 멀티모달 센서 융합에 IGX Thor를 도입하고 있습니다.

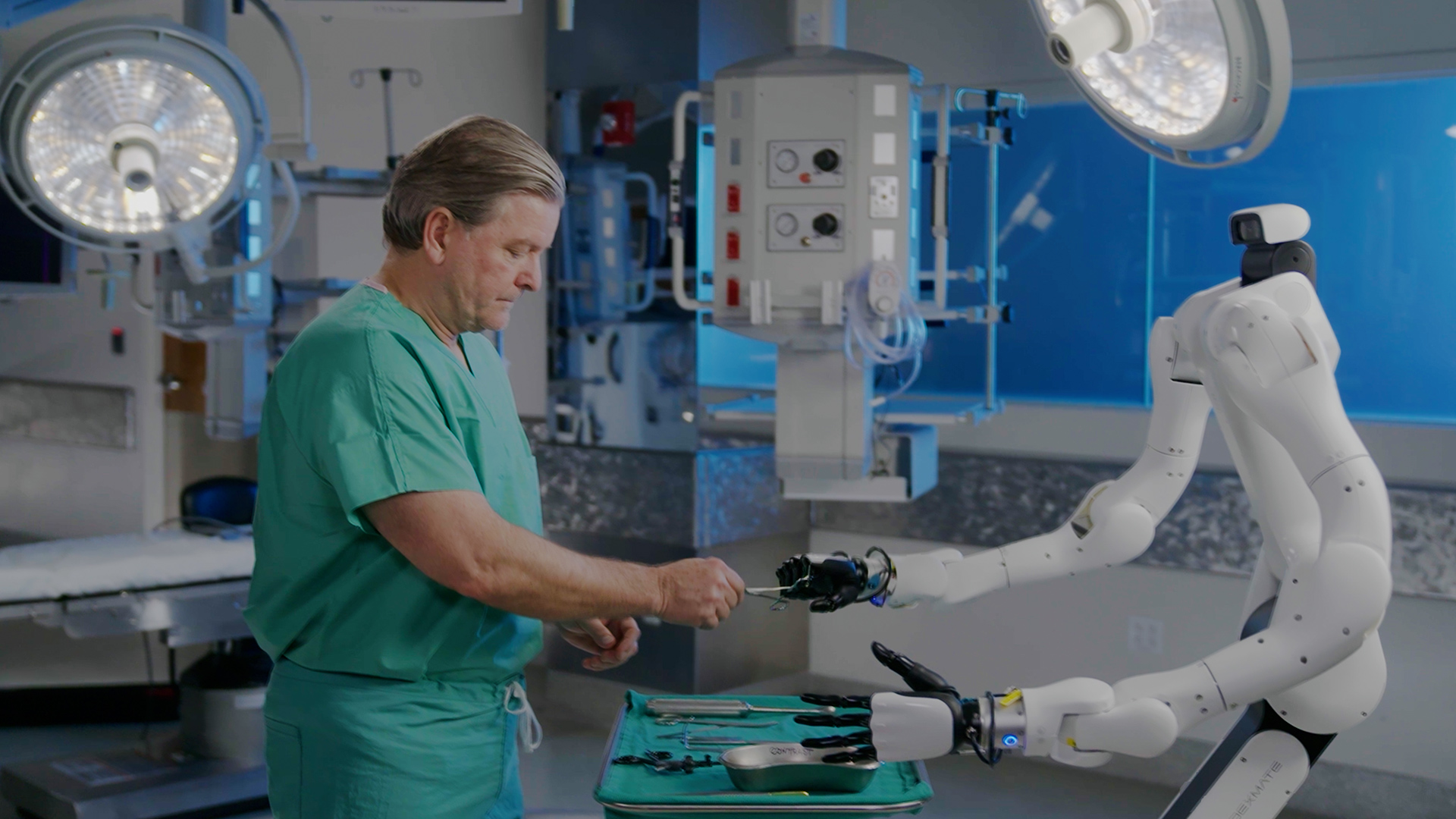

Johnson & Johnson은 Polyphonic 디지털 수술 플랫폼을 구동하기 위해 IGX Thor를 채택하여 수술실에 실시간 AI 추론을 도입하고 있습니다. KARL STORZ는 IGX Thor를 활용하여 보다 정확한 진단을 위한 차세대 내시경 및 영상 도구를 개발하고 있습니다. Medtronic은 IGX Thor 도입을 검토 중이며, LEM Surgical과 Horizon Surgical Systems는 수술 로봇 시스템에서 정밀도와 기능 안전성을 제공하기 위해 IGX Thor를 채택하고 있습니다.

LEM Surgical 로봇.

이미지 제공: LEM Surgical.

NVIDIA Holoscan 플랫폼을 기반으로 구축된 이 시스템들은 비디오, 영상, 디바이스 텔레메트리 등 멀티모달 센서 데이터를 처리하고 오케스트레이션할 수 있으며, 차세대 소프트웨어 정의 의료 기기와 지능형 수술실에 필요한 저지연 AI 파이프라인을 구현합니다.

Planet Labs는 테라바이트 규모의 다차원 위성 데이터를 궤도상에서 더 낮은 비용으로 실행 가능한 인텔리전스로 변환하기 위해 IGX Thor를 채택하고 있습니다. 그리고 CERN의 연구자들은 IGX Thor를 활용하여 고급 물리학 기반 AI 모델을 실행하고, 대규모 데이터 스트림을 높은 처리량으로 처리하고 있습니다.

Planet Labs의 Owl 위성.

이미지 제공: Planet Labs.

Physical AI에서의 생태계 확장과 빠른 배포

성능과 안전성을 넘어, 산업용 AI는 프로덕션 지원 시스템, 멀티모달 센서, 그리고 신뢰할 수 있는 액추에이터를 필요로 합니다.

Analog Devices, Infineon, NXP Semiconductors, STMicroelectronics 및 Texas Instruments는 레이더 장치, 센서 및 모터 컨트롤러를 NVIDIA Isaac Sim 프레임워크에 통합하고, NVIDIA Holoscan Sensor Bridge를 활용하여 차세대 Physical AI 시스템을 더 빠르고 안전하며 스마트하게 구현하기 위한 차세대 센서와 액추에이터의 통합을 가속화하고 있습니다.

Leopard Imaging, D3 Embedded, Sensing 및 e-con Systems는 Holoscan Sensor Bridge 기반의 이더넷 카메라 모듈을 출시하여, 실시간 AI 처리를 위한 저지연 센서 데이터 스트리밍을 GPU로 직접 지원합니다.

Advantech, ASRockRack, NEXCOM, Connect Tech, Onyx, Inventec 및 Yuan은 다양한 애플리케이션에 맞춘 엔터프라이즈급 성능, 유연한 입출력 및 맞춤형 구성을 갖춘 산업용·의료용 IGX Thor 시스템을 구축하고 있습니다.

Barco, Cosmo 및 XRlabs는 IGX Thor와 NVIDIA Holoscan을 도입해 의료 기술 산업을 위한 의료 등급의 기성 엣지 AI 플랫폼을 구축하고 있습니다. 이를 통해 디바이스 제조업체는 NVIDIA의 풀스택 가속 컴퓨팅 및 AI 소프트웨어를 활용해 개발을 가속화하고 의료 인증을 받은 임상 솔루션을 양산 단계에서 배포할 수 있습니다.

IGX Thor 개발자 키트는 전 세계 유통 파트너를 통해 구매 가능합니다. 기능 안전성을 갖춘 임베디드 시스템용 IGX T5000 모듈과 고성능 워크스테이션용 IGX 7000 보드 키트는 추후 출시될 예정입니다.

NVIDIA 창립자 겸 CEO 젠슨 황의 GTC 기조연설을 시청하고, 피지컬 AI, 로보틱스 및 비전 AI 세션을 살펴보세요.

3월 19일 목요일, 오후 1:00 PT 🔗

로봇들, GTC를 떼 지어 누비다

GTC는 AI 개발자와 혁신가들의 집결지일 뿐만 아니라, 휴머노이드와 로봇 팔부터 사족보행 로봇과 자율 이동 로봇(AMR)에 이르기까지 다양한 로봇들이 즐겨 찾는 무대이기도 합니다.

활약하는 휴머노이드

AGIBOT 휴머노이드가 컨벤션 센터에서 GTC 참가자들을 맞이했습니다. 이 로봇은 NVIDIA Isaac Sim과 Isaac Lab을 사용해 훈련되었습니다.

전시 홀에서 Agile Robots의 Agile ONE 휴머노이드는 물건을 집고 놓는 작업에서 뛰어난 손재주를 선보였습니다. 이 회사는 Isaac Sim과 Isaac Lab을 활용해 시뮬레이션 환경에서 로봇을 훈련시킵니다.

Humanoid는 Isaac Sim, Isaac Lab, NVIDIA Omniverse 라이브러리를 활용해 개발된 NVIDIA Jetson Thor 기반 로봇을 선보였으며, 이 로봇은 참관객들이 요청한 물건을 직접 건네주었습니다.

Hexagon Robotics는 Isaac Sim과 Isaac Lab으로 훈련된 AEON 휴머노이드를 전시장에 선보여 다양한 조작 및 원격 조종 작업을 시연했습니다.

휴머노이드

Hexagon Robotics

팔을 들어 올려라

ABB Robotics는 레코드 회전 기술로 관중을 즐겁게 한 DJ 로봇을 선보였습니다. 이 회사는 NVIDIA Omniverse 라이브러리를 자사의 RobotStudio 프로그래밍 및 시뮬레이션 제품군에 직접 통합하고 있습니다.

WORKR는 자사의 로보틱스 기술이 도자기 제조업체 Fireclay Tile의 힘들고 반복적인 타일 픽킹 작업을 어떻게 자동화하는지 시연했습니다. ABB Robotics 하드웨어에 배포된 이 로보틱스 파이프라인은 Isaac Sim과 Omniverse로 개발되었습니다.

Universal Robots는 Scale AI 소프트웨어를 활용한 UR AI Trainer를 공개했습니다. 이 시스템은 리더-팔로워 방식으로 인간 오퍼레이터가 로봇에게 작업을 직접 가르칠 수 있으며, 동작·힘·시각 데이터를 동기화하여 기록해 비전 언어 액션 모델 학습에 활용합니다. 이 회사는 Isaac Sim과 Omniverse를 사용해 시뮬레이션 환경에서 로봇을 훈련합니다.

사족보행 로봇과 AMR의 전시장 활약

FieldAI는 자사의 Field Foundation Models가 사족보행 로봇의 실제 환경 자율 탐색 및 맵핑을 어떻게 지원하는지 선보였습니다. 이 솔루션은 NVIDIA Omniverse NuRec 라이브러리와 NVIDIA Cosmos 월드 모델 등 NVIDIA 기술을 기반으로 구축되었습니다.

전시장에서는 많은 관람객들이 Sentigent Technology의 소형 Rovar X3 로봇 주위에 모여들었습니다. 실내외 겸용 동반 로봇인 이 제품은 Isaac Lab에서 훈련되었으며 NVIDIA Jetson으로 구동됩니다.

Serve Robotics의 AMR 10여 대가 GTC 행사장 곳곳에서 활약했습니다. 기조연설 사전 행사가 열린 SAP Center에서 음식을 배달하고, 행사 기간 내내 참가자들이 직접 고를 수 있는 기념품을 운반했습니다. Serve 로봇은 Isaac Sim에서 시뮬레이션되며 NVIDIA Jetson Orin으로 구동됩니다.

Sentigent Technology의 Rovar X3

Serve Robotics

3월 16일 월요일, 오후 1:30 (태평양 시간) 🔗

DGX Spark 및 DGX Station, NVIDIA NemoClaw와 결합해 자율 에이전트를 위한 풀스택 플랫폼 제공

인공지능은 단순한 프롬프트 기반 도구에서 추론하고, 계획하고, 행동하는 지능적인 장기 실행 시스템으로 진화하고 있습니다. 이러한 자율 에이전트는 단순히 텍스트를 생성하는 것에 그치지 않습니다. 코드를 작성하고, 도구를 호출하고, 데이터를 분석하고, 결과를 시뮬레이션하며 지속적으로 개선될 수 있습니다.

항상 작동하는 에이전트를 슈퍼컴퓨팅 수준의 지능으로 구축하고 실행하려면 개발자에게 적합한 인프라가 필요합니다.

NVIDIA DGX Spark와 NVIDIA DGX Station 시스템을 새로운 NVIDIA NemoClaw 오픈 소스 스택과 결합하면 자율적이고 장기 실행되는 에이전트(일명 claws)를 로컬에서 개발하고 배포하기 위한 최적의 플랫폼을 제공합니다. 이 시스템은 AI 팩토리급 성능을 지능이 창출되는 현장, 즉 데스크와 기업 내부로 직접 가져옵니다.

NemoClaw로 에이전트 AI 보안 강화

NVIDIA NemoClaw는 항상 작동하는 OpenClaw 어시스턴트를 더 안전하게, 단일 명령으로 간편하게 실행할 수 있도록 지원하는 오픈 소스 스택입니다. NVIDIA OpenShell 런타임을 설치하며, 이는 NVIDIA Agent Toolkit의 일부로, 자율 에이전트 실행을 위한 안전한 환경과 NVIDIA Nemotron과 같은 오픈 소스 모델을 제공합니다.

독점 워크플로 전반에 자율 에이전트를 배포하는 기업은 거버넌스, 격리 및 제어가 필요합니다. OpenShell은 에이전트가 데이터에 접근하고, 도구를 사용하며, 정책 경계 내에서 운영되는 방식을 정의함으로써 안전하고 항상 작동하는 AI 시스템을 위한 아키텍처적 기반을 제공합니다.

자가 진화하는 에이전트는 자율적으로 작업을 수행하면서 도구와 소프트웨어를 구축하기 위한 전용 컴퓨팅이 필요합니다. DGX Spark와 DGX Station은 NemoClaw를 실행하여 데이터센터 AI 팩토리로 확장하기 전에 로컬에서 OpenClaw로 에이전트를 구축하고 검증하기에 이상적인 환경입니다.

DGX Spark: 기업 팀을 위한 확장 가능한 AI

DGX Station이 가장 강력한 데스크사이드 AI 시스템을 대표한다면, DGX Spark는 기업 전반의 도메인 팀에 확장 가능한 AI 인프라를 제공합니다.

대용량 로컬 메모리, 우수한 성능, 그리고 NemoClaw와의 통합을 통해 DGX Spark는 자율 에이전트 개발 및 배포에 이상적입니다.

DGX Spark는 이제 최대 4개의 시스템을 통합 구성으로 클러스터링할 수 있어, 기존 랙 배포의 복잡성 없이 거의 선형적인 성능 확장이 가능한 소형 “데스크탑 데이터센터”를 구현합니다.

DGX Spark의 예정된 소프트웨어 릴리스는 오케스트레이션 및 관리 기능을 더욱 강화하여 더 빠른 반복 작업과 프로토타입에서 프로덕션으로의 원활한 전환을 가능하게 할 것으로 기대됩니다.

DGX Spark는 NVIDIA Nemotron 3 및 주요 오픈 모델을 포함한 최신 AI 모델을 지원하여, 개발자들이 현대적이고 지속적으로 발전하는 AI 소프트웨어 스택 위에서 구축할 수 있도록 보장합니다.

각 산업 전반에 걸쳐 조직들은 DGX Spark를 평가 환경에서 실제 엔터프라이즈 배포 환경으로 전환하고 있습니다. 금융 기관들은 리스크 모델링을 가속화하고 있습니다. 의료 연구자들은 발견 일정을 단축하고 있습니다. 에너지 기업들은 운영을 최적화하고 있습니다. 미디어 및 통신 팀들은 실시간 콘텐츠 및 커뮤니케이션 워크플로를 구축하고 있습니다.

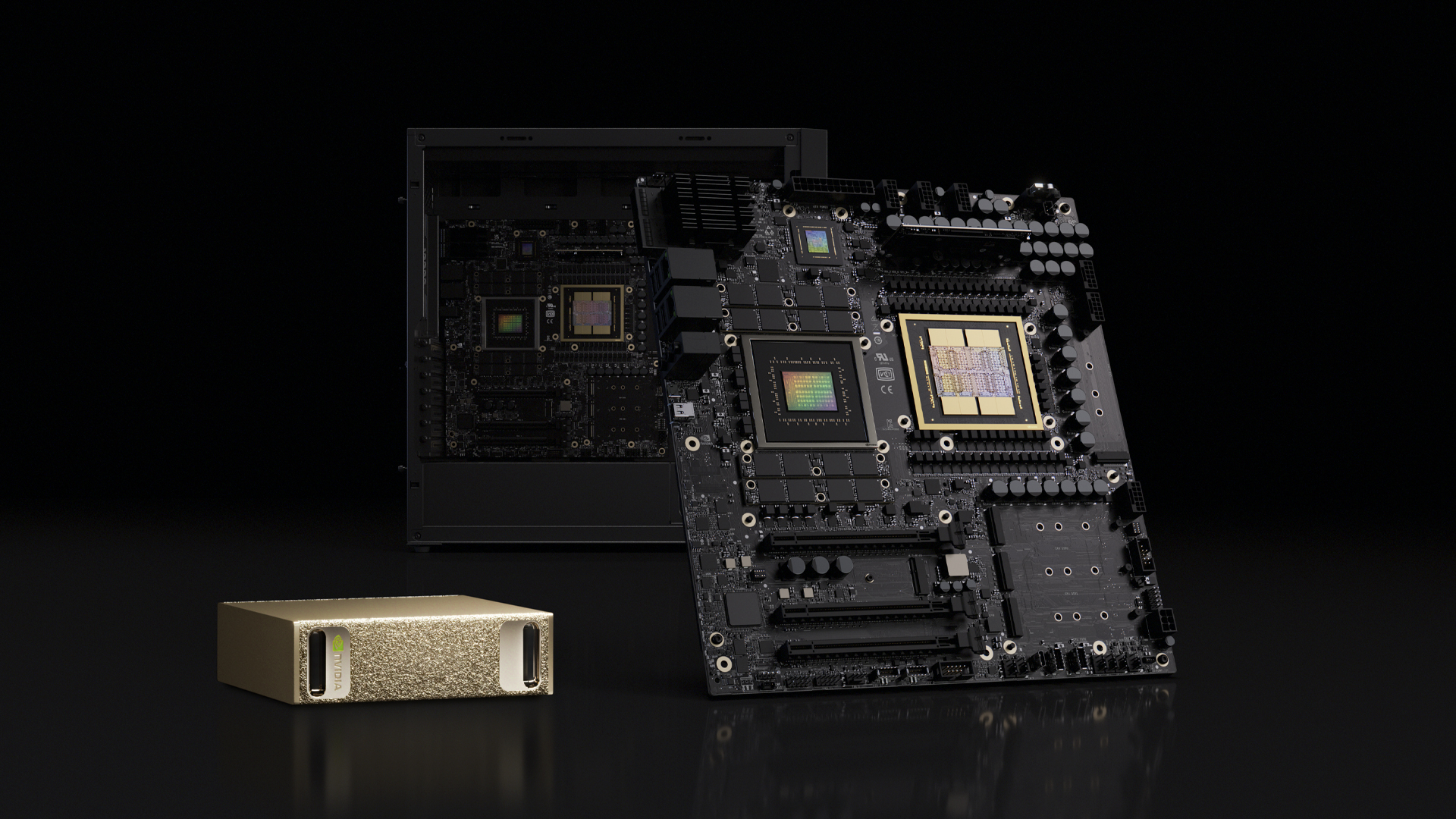

DGX Station: 책상 위의 데이터센터급 AI

NVIDIA DGX Station — 세계에서 가장 강력한 데스크사이드 슈퍼컴퓨터 — 이 장시간 사고(long-thinking) 및 자율적 사고의 새로운 단계를 위해 출시되었습니다.

NVIDIA GB300 Grace Blackwell Ultra Desktop Superchip을 탑재한 DGX Station은 748기가바이트의 코히어런트 메모리와 최대 20 페타플롭스의 AI 컴퓨팅 성능을 제공합니다. NVIDIA NVLink-C2C를 통해 72코어 NVIDIA Grace CPU와 NVIDIA Blackwell Ultra GPU를 연결하여, 프론티어 AI 워크로드를 위한 통합된 고대역폭 아키텍처를 구현합니다.

이를 통해 개발자들은 최대 1조 개의 파라미터를 가진 오픈 모델을 실행하고, 책상에서 바로 장시간 사고 자율 에이전트를 개발할 수 있습니다.

DGX Station은 개인 AI 슈퍼컴퓨터로 또는 팀을 위한 공유 온디맨드 컴퓨팅 노드로 운용할 수 있습니다. 에어갭(air-gapped) 구성을 지원하여 규제 산업 및 주권 환경에 적합합니다. 로컬에서 개발된 애플리케이션은 재설계 없이 데이터센터나 클라우드의 NVIDIA GB300 NVL72 시스템으로 원활하게 이전할 수 있습니다.

업계 선두 기업들은 이미 DGX Station을 활용하여 실세계 혁신을 가속화하고 있습니다. Snowflake는 DGX Station을 사용하여 오픈 소스 Arctic 학습 프레임워크를 로컬에서 테스트하고 있습니다. EPRI는 전력망 안정성 강화를 위한 AI 기반 기상 예측 고도화에 이를 활용 및 테스트하고 있습니다. Medivis는 비전 언어 모델을 DGX Station과 통합하여 수술 워크플로에 적용하고 있습니다. Sungkyunkwan University는 단백질 구조 분석 가속화에 이 시스템을 활용하고 있습니다. Microsoft Research와 Cornell University는 DGX Station을 통해 대규모 실습형 AI 교육을 실현하고 있습니다. Respo.Vision, WSP 및 1X는 고급 스포츠 분석, 합성 데이터 학습, 자율 에이전트 및 휴머노이드 로보틱스를 위한 AI를 배포하고 있습니다.

시스템은 현재 주문 가능하며, 앞으로 몇 달 내에 ASUS, Dell Technologies, GIGABYTE, MSI 및 Supermicro에서 출하가 시작되며, HP에서는 연내 출하될 예정입니다.

하나의 아키텍처 — 데스크톱에서 AI 팩토리까지

DGX Station과 DGX Spark는 NVIDIA AI 소프트웨어 스택이 사전 구성된 상태로 출하되어, 개발자들이 익숙한 도구를 사용하면서 로컬 개발 환경과 대규모 인프라 사이를 원활하게 이동할 수 있습니다.

개발자들은 DGX Station에서 OpenAI gpt-oss-120b, Google Gemma 3, Qwen3, Kimi K2.5, Mistral Large 3, DeepSeek V3.2 및 NVIDIA Nemotron을 포함한 최신 모델을 실행하고 파인튜닝할 수 있으며, 1x, Aible AI, Anaconda, Docker, Red Hat, JetBrains, Docker, Inc., Ollama, llama.cpp, ComfyUI, LM Studio, Llm.c, Weights & Biases (CoreWeave에 인수됨), Odyssey, Roboflow, VLLM, SGLang, Unsloth, Learning Machine, Quali, Lightning AI 등 다양한 친숙한 도구와 플랫폼을 활용할 수 있습니다.

칩, 시스템, 네트워킹, 소프트웨어를 하나의 일관된 아키텍처로 통합함으로써, NVIDIA는 기업들이 한 번 구축하여 어디서나 확장할 수 있도록 지원합니다 — 데스크사이드 DGX Station부터 멀티 노드 DGX Spark 클러스터, 그리고 완전한 AI 팩토리까지.

NVIDIA GTC에서 DGX Spark에 대해 자세히 알아보세요. 확장 가능한 자율 에이전트 및 AI 인프라에 관한 세션에 참석하거나, 전시홀에서 라이브 NemoClaw 기반 AI 에이전트와 멀티 노드 Spark 데모를 확인하거나, 이 웹페이지를 방문하여 배포 가이드와 베타 리소스에 액세스하세요.

개발자는 DGX Station에서 빠르게 시작하고 다양한 AI 워크플로를 테스트할 수 있습니다. NVIDIA 파트너를 통해 자세한 내용을 확인하고 DGX Station을 주문하세요.

소프트웨어 제품 정보에 관한 공지를 확인하세요.

태평양 표준시 기준 3월 16일 월요일 오후 1시 30분 🔗

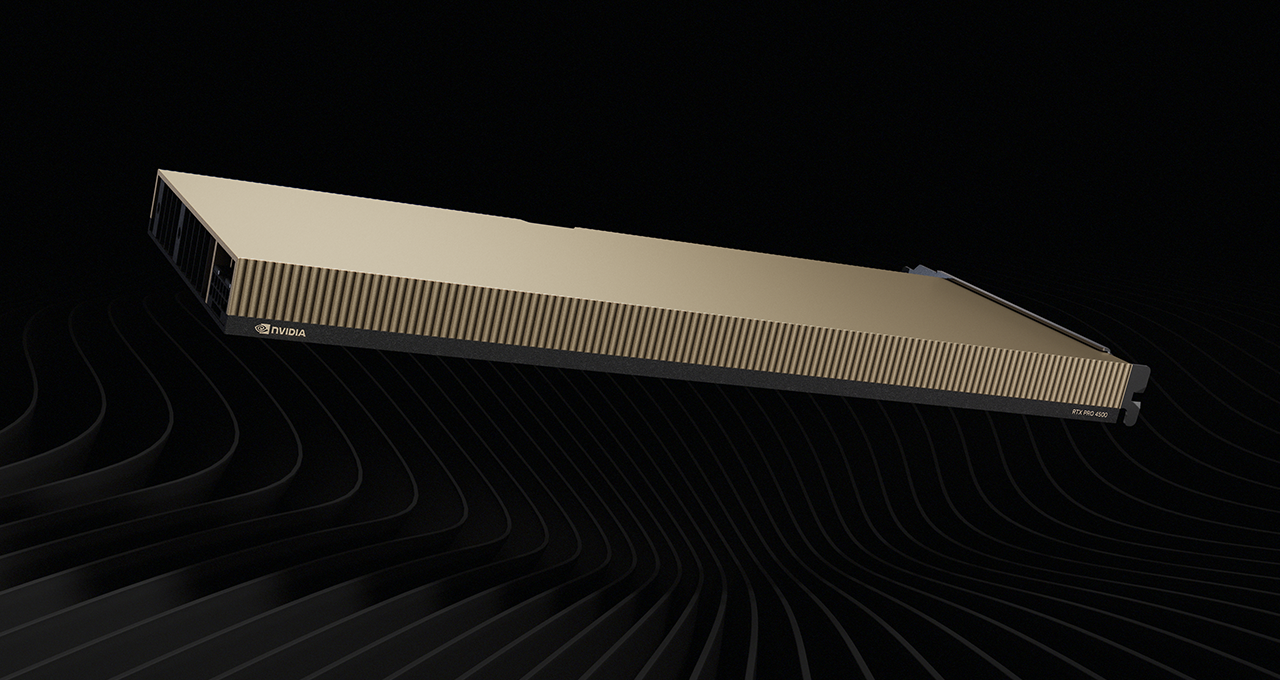

NVIDIA RTX PRO 4500 Blackwell Server Edition, 데이터 센터부터 엣지까지 범용 가속 제공

NVIDIA RTX PRO 4500 Blackwell Server Edition은 세계에서 가장 널리 채택된 엔터프라이즈 데이터 센터 및 엣지 컴퓨팅 플랫폼에 GPU 가속 기능을 제공하며, 기존 CPU 전용 서버 대비 놀라운 성능 향상을 실현합니다: 비전 AI 애플리케이션에서 100배 성능 향상, 벡터 데이터베이스에서 최대 50배 성능 향상.

엔터프라이즈 데이터 센터를 위한 전력 효율적인 성능

성능, 효율성 및 비용 최적화를 원하는 기업을 위해 RTX PRO 4500 Blackwell은 소형 165와트 단일 슬롯 폼 팩터로 획기적인 성능을 제공합니다. 5세대 Tensor Core, 4세대 RTX 기술, 완전 통합형 미디어 파이프라인을 통해 데이터 처리, 비전 AI, 소형 언어 모델(SLM) 추론, 비디오 처리 및 시각적 컴퓨팅을 위한 최적의 플랫폼입니다.

또한 곧 출시될 vGPU 20.0과 함께 가상 워크스테이션을 지원할 예정이며, 하드웨어 기반 파티셔닝을 위한 NVIDIA Multi-Instance GPU 기술도 지원합니다.

추가 주요 사항은 다음과 같습니다:

- SLM AI 추론은 NVIDIA L4 GPU 대비 NVIDIA Nemotron Nano 9B 모델에서 최대 10배 성능 향상을 제공합니다.

- NVIDIA cuDF로 가속화된 Apache Spark는 CPU 대비 10테라바이트 데이터에서 최대 5배 빠른 쿼리 성능과 10배 향상된 총 소유 비용(TCO)을 제공합니다.

- NVIDIA Metropolis 플랫폼을 활용한 Vision AI는 NVIDIA L4 GPU 대비 NVIDIA Cosmos Reason 2 모델로 비디오 요약에서 최대 4배 성능을 제공합니다.

업계 리더들의 도입

IT 서비스, 생명과학, 통신을 포함한 여러 산업의 리더들이 AI 및 시각적 컴퓨팅 워크로드를 지원하기 위해 NVIDIA RTX PRO 4500 Blackwell GPU를 도입하고 있습니다.

NTT DATA는 엣지 위치에서 촬영된 영상으로부터 안전한 AI 기반 데이터 인사이트에 대한 고객 접근을 가속화하고 있습니다. 바이오테크 분야에서 Pacific Biosciences는 유전체 분석의 혁신을 이끌기 위해 RTX PRO 4500 Blackwell을 자사 시퀀싱 플랫폼에 통합할 계획입니다. Nokia는 RTX PRO 4500 Blackwell을 AI‑RAN 기지국에 배치하여 엣지 AI 에이전트를 위해 수십억 개의 장치를 연결하는 분산 컴퓨팅 네트워크를 구축할 예정입니다.

포괄적인 생태계 지원

RTX PRO 4500 Blackwell를 도입하는 기업은 광범위한 소프트웨어 생태계 지원의 혜택을 누릴 수 있습니다. 여기에는 Broadcom, Canonical, Red Hat, Nutanix 및 SUSE의 AI 인프라 소프트웨어, Databricks 및 Snowflake를 포함한 데이터 플랫폼, Dataiku, DataRobot 및 Ray on Anyscale과 같은 AI 플랫폼, Cisco AI Defense를 포함한 보안 소프트웨어, 그리고 Ambient AI, BriefCam 및 Ipsotek(Eviden Business)와 같은 비전 AI 및 분석 솔루션이 포함됩니다.

NVIDIA RTX PRO 서버는 RTX PRO 4500 Blackwell 서버 에디션 GPU를 탑재하여, 업데이트된 NVIDIA 엔터프라이즈 AI 팩토리 검증 설계와 엔터프라이즈 에이전틱 AI를 위한 현대적인 스토리지 시스템 구축을 위한 맞춤형 레퍼런스 설계인 NVIDIA AI 데이터 플랫폼의 일부로도 소개됩니다.

RTX PRO 4500 Blackwell을 AI 데이터 플랫폼의 일부로 통합하는 스토리지 파트너로는 Cloudian, DDN, Dell Technologies, Everpure, Hammerspace, Hitachi Vantara, IBM, NetApp, Nutanix, VAST Data, WEKA가 있습니다.

출시 정보

RTX PRO 4500 Blackwell GPU를 탑재한 RTX PRO Server는 Cisco, Dell, HPE, Lenovo, Supermicro를 포함한 시스템 빌더를 통해 주문 가능하며, Aivres, ASRock Rack, ASUS, Compal, Foxconn, GIGABYTE, Inventec, Lanner, MiTAC Computing, MSI, Pegatron, Quanta Cloud Technology (QCT), Sanmina, Wistron 및 Wiwynn로부터 추가 서버 구성도 제공됩니다.

Akamai Cloud와 Amazon Web Services (AWS)는 RTX PRO 4500 Blackwell Server Edition 인스턴스를 제공하는 최초의 클라우드 서비스 제공업체 중 하나가 될 것입니다.

RTX PRO 4500 Blackwell Server Edition GPU에 대해 자세히 알아보세요.

소프트웨어 제품 정보에 관한 고지사항을 확인하세요.

태평양 표준시 기준 3월 16일(월) 오후 1시 30분 🔗

NVIDIA 파트너사들, NVIDIA RTX PRO Blackwell 기반 신규 워크스테이션 공개

GTC에서 NVIDIA 파트너사들은 NVIDIA RTX PRO Blackwell GPU와 워크스테이션용 Intel Xeon 600 프로세서를 결합한 AI 지원 워크스테이션의 새로운 라인업을 공개했습니다. 새롭게 설계된 이 제품들은 일상적인 AI 탐색부터 고난도 3D 디자인 및 시뮬레이션까지 다양한 워크플로를 지원합니다.

Lenovo 는 ThinkPad P14s i Gen 7, ThinkPad P16s Gen 5 AMD, ThinkPad P16s I Gen 5, ThinkPad P1 Gen 9를 포함한 ThinkPad P 시리즈 모바일 워크스테이션 라인업을 확장하고 있으며, 최대 2개의 RTX PRO 6000 Blackwell Max-Q Workstation Edition GPU를 구성할 수 있는 강력한 신제품 ThinkStation P5 Gen 2를 포함한 ThinkStation 라인업도 확대합니다.

Dell은 Dell Pro Precision 5 및 7 시리즈 모바일 워크스테이션과 Dell Pro Precision 9 T2, T4, T6 데스크톱 워크스테이션으로 구성된 새로운 Dell Pro Precision 포트폴리오를 선보입니다.

HP는 향후 NVIDIA GPU 세대를 지원할 수 있도록 HP Z 데스크탑 워크스테이션을 미래 지향적으로 설계할 계획입니다. 3월 24일 HP Imagine에서 자세한 내용을 확인하세요.

이 새로운 세대의 워크스테이션은 기업들이 이동성, 데스크사이드 성능 또는 최대 확장성 중 무엇을 우선시하든 플리트를 갱신하는 방식에 있어 더 많은 유연성을 제공합니다. 최신 드라이버가 탑재된 RTX PRO Blackwell GPU는 NVIDIA Nemotron 오픈 모델 및 주요 커뮤니티 모델을 포함하여 즉시 사용 가능한 모델 준비 상태(day-zero)를 제공하므로, 팀은 즉시 AI 워크로드를 실험하고 배포할 수 있습니다.

Ollama, SGLang 및 LM Studio와 같은 소프트웨어 제공업체들은 RTX PRO에 최적화된 모델과 도구를 제공하여, 개발자와 크리에이터들이 익숙한 워크플로우를 사용해 이 새로운 워크스테이션에서 직접 고급 AI 워크로드를 실행할 수 있도록 지원합니다.

NVIDIA NemoClaw로 로컬에서 에이전틱 AI 워크플로우 보안 강화

AI가 단순한 프롬프트에서 에이전틱 AI — 추론하고, 계획하고, 행동하는 장기 실행 시스템 — 로 발전함에 따라, 개발자들은 항상 켜져 있는 AI 어시스턴트를 구축하기 위한 안전한 인프라가 필요합니다. 이 새로운 워크스테이션은 자율적인 장기 실행 에이전트를 안전하게 개발하고 배포하기 위해 설계된 NVIDIA NemoClaw 오픈 소스 스택을 위한 이상적인 데스크탑 플랫폼을 제공합니다.

RTX PRO 6000 Blackwell Workstation Edition 및 RTX PRO 6000 Blackwell Max-Q Workstation Edition GPU에서 최대 4,000 TOPS의 로컬 AI 컴퓨팅 성능과 96기가바이트의 GPU 메모리를 활용하여, NemoClaw는 OpenClaw 어시스턴트를 안전하게 실행하는 것을 단순화합니다. NVIDIA Agent Toolkit의 일부로서, NVIDIA OpenShell 런타임 — 자율 에이전트와 NVIDIA Nemotron과 같은 오픈 소스 모델을 실행하기 위한 보안 환경 — 을 설치합니다. 이를 통해 기업들은 복잡한 비즈니스 과제를 완전히 온프레미스에서 처리하는 데 필요한 거버넌스, 통제권 및 프라이버시를 확보할 수 있습니다.

GTC NVIDIA 데모 부스 및 파트너 부스(Dell 721, HP 1931, Lenovo 431)에서 RTX PRO 기반 워크스테이션의 실제 동작을 자세히 확인하세요.

Tuesday, March 17, 2:30 p.m. PT 🔗

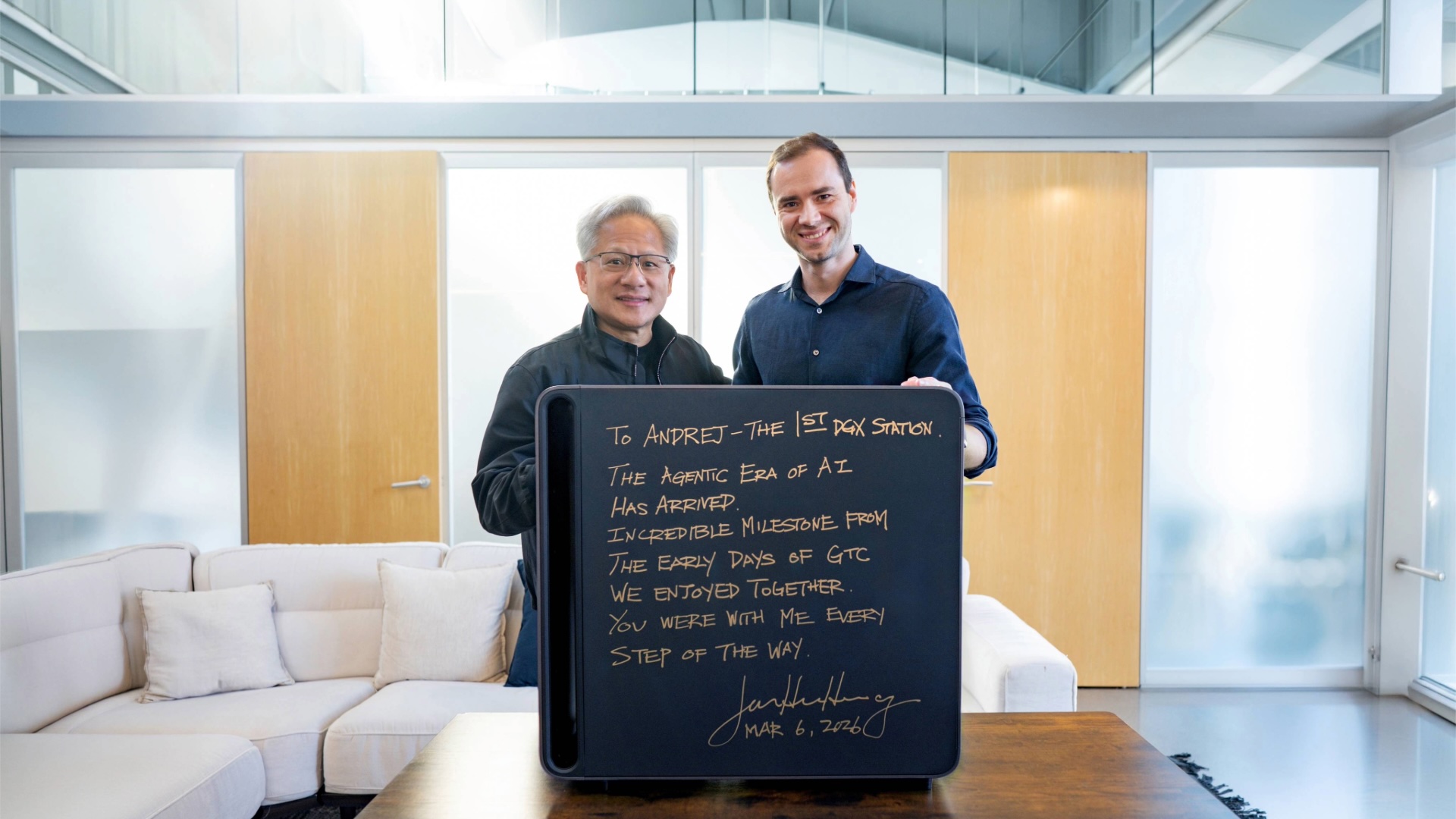

NVIDIA DGX Station GB300: 책상 위의 머신

NVIDIA GB300 슈퍼칩을 탑재한 첫 번째 NVIDIA DGX Station 시스템이 AI 선구적 개발자들의 손에 전달되었으며, 이는 프론티어 규모의 모델 및 에이전트를 활용한 데스크사이드 개발의 새로운 진전을 의미합니다.

첫 번째 시스템인 Dell Technologies의 Dell Pro Max with GB300은 3월 6일 금요일 팔로알토의 Andrej Karpathy에게 배송되었습니다. Karpathy는 2015년부터 2017년까지 OpenAI의 창립 멤버이자 연구 과학자로, 딥러닝 분야의 초기 기반 연구 — 특히 컴퓨터 비전, 생성 모델링, 강화 학습 — 에 기여하며 조직의 초기 연구 방향을 정립하는 데 도움을 주었습니다.

추가 배송도 진행 중입니다. 최근 수령자는 유튜버이자 개발자, AI 열성가인 Matt Berman으로, 그는 AI 연구를 논문에서 바로 실동 시스템으로 옮기는 방식을 실천하며 아이디어에서 실험까지의 경로를 단축하고 있습니다.

DGX Station GB300은 데이터 센터에서 사용되는 것과 동일한 NVIDIA GB300 슈퍼칩 아키텍처를 기반으로 데스크사이드 시스템에 집약한 제품입니다. 이 시스템은 748GB의 코히런트 메모리를 포함하며, FP4 성능 기준 최대 20페타플롭스를 제공하고, 사용자의 데스크탑에서 바로 프론티어 AI 개발을 위한 최대 1조 개 파라미터의 AI 모델을 지원합니다. DGX Station에서 로컬로 개발된 작업은 동일한 GB300 아키텍처를 기반으로 클라우드 또는 데이터 센터로 확장할 수 있습니다.

이번 초기 배치는 장시간 실행되는 자율 에이전트 — 로컬 도구와 데이터에 접근하며 시간을 두고 추론하고, 계획하고, 작업을 수행하는 시스템 — 의 AI 개발을 위한 데스크사이드 컴퓨팅에 대한 수요를 반영합니다.

이러한 변화는 Peter Steinberger가 만든 오픈 소스 자율 에이전트 프레임워크인 OpenClaw를 통해 가시화되었습니다. OpenClaw는 로컬 파일과 애플리케이션에 접근하고, 코드를 작성하고, 하위 에이전트를 생성하며, 상태를 유지하고 복잡한 워크플로우를 실행할 수 있는 에이전트가 독자적으로 작업을 진행할 수 있음을 보여주었습니다. 이 프로젝트는 출시 첫 주에 GitHub 스타 100,000개를 돌파하고 200만 명 이상의 방문자를 유치했습니다.

하드웨어를 보완하기 위해 NVIDIA는 NVIDIA NemoClaw를 통해 OpenClaw에 기여함으로써 장기 실행 자율 에이전트를 발전시키는 데 주력하고 있습니다. NemoClaw는 단일 명령으로 OpenClaw 상시 작동 어시스턴트를 보다 안전하게 실행할 수 있도록 간소화하는 오픈 소스 스택입니다.

NVIDIA Agent Toolkit의 일환으로, 자율 에이전트와 NVIDIA Nemotron과 같은 오픈 소스 모델을 실행하기 위한 보안 환경인 NVIDIA OpenShell 런타임을 설치합니다.

NemoClaw와 DGX Station의 조합은 로컬에서 더욱 안전하고 자율적인 장기 실행 에이전트를 구축하고 실행하기 위한 최고의 개발자 플랫폼을 제공합니다.

더 많은 시스템이 개발자에게 제공됨에 따라, 이러한 노력은 더 넓은 변곡점을 가리킵니다. 에이전트 AI는 실험적인 프롬프트에서 지속적인 시스템으로 이동하고 있으며, 그 작업의 일부에서는 고성능 컴퓨팅이 다시 책상 위로 돌아오고 있습니다.

GTC 파크에서 매일 오전 8시부터 오후 5시까지(3월 19일까지) 진행되는 NVIDIA build-a-claw 이벤트에서 직접 에이전트를 만들고 — 능동적인 상시 작동 AI 어시스턴트를 맞춤 설정하고 배포해 보세요.

클라우드 🔗

태평양 표준시 3월 16일(월) 오후 1시 30분 🔗

NVIDIA와 Amazon Web Services, 에이전트 AI 시대의 컴퓨팅 역량 확장

NVIDIA와 Amazon.com의 자회사인 Amazon Web Services(AWS)는 에이전틱 AI 시대에 모든 산업에서 증가하는 컴퓨팅 수요를 지원하기 위해 NVIDIA AI 인프라를 배포하는 확장된 파트너십을 발표합니다. AWS는 LPU 및 100만 개 이상의 NVIDIA GPU를 포함한 NVIDIA AI 인프라를 배포할 예정입니다.

이번 파트너십을 통해 AWS의 컴퓨팅 포트폴리오 전반에 걸쳐 NVIDIA AI 인프라를 대규모로 배포할 수 있게 됩니다. 확장된 인프라는 NVIDIA Blackwell 및 Rubin GPU 아키텍처, 엔터프라이즈 AI 워크로드를 위한 NVIDIA RTX PRO Blackwell Server Edition GPU, 초저지연 추론을 위한 NVIDIA Groq 3 LPU 등 NVIDIA AI 컴퓨팅 스택 전체에 걸쳐 있습니다. AWS와 NVIDIA는 또한 Spectrum 네트워킹 및 기타 인프라 영역에서도 협력하고 있습니다.

100만 개 이상의 NVIDIA GPU 배포는 올해 AWS의 글로벌 클라우드 리전 전반에 걸쳐 시작될 예정입니다. NVIDIA 가속 컴퓨팅과 AWS의 글로벌 클라우드 플랫폼을 기반으로 구축된 이러한 배포는 AWS AI 팩토리가 통합 컴퓨팅 엔진으로 운영될 수 있도록 하여 차세대 AI 시스템의 학습 및 배포에 탁월한 효율성, 성능 및 보안을 제공합니다.

NVIDIA의 가속 컴퓨팅과 AWS의 고급 클라우드 서비스 및 인프라 기술을 통합함으로써, 두 회사는 기업, 스타트업, 연구 기관이 복잡한 워크플로우에서 자율적으로 추론·계획·행동할 수 있는 에이전틱 AI 시스템을 구축하고 확장하는 데 필요한 인프라를 제공하는 것을 목표로 합니다. 두 회사는 함께 전 세계 AI 인프라의 속도, 규모 및 안정성을 크게 도약시킬 것입니다.

월요일, 3월 16일, 오후 1:30 (태평양 표준시) 🔗

NVIDIA와 AWS, GPU 가속 솔루션 확장을 위해 협력

NVIDIA와 Amazon Web Services(AWS)는 AWS에서 NVIDIA 기반 데이터 처리 역량을 확장하고 NVIDIA Nemotron 오픈 모델 패밀리에 대한 지원을 추가하기 위해 협력을 확대하고 있습니다.

2010년부터 NVIDIA와 AWS는 AI를 프로덕션 환경에서 구축하고 배포할 때 솔루션 도출 시간을 단축하는 풀스택 제품군을 제공하기 위해 인프라, 소프트웨어, 서비스에 걸친 대규모의 비용 효율적이고 유연한 GPU 가속 솔루션을 제공하기 위해 협력해 왔습니다.

NVIDIA RTX PRO 4500으로 AWS에서의 데이터 처리 가속화

새로운 NVIDIA RTX PRO 4500 Blackwell Server Edition GPU가 새로운 유형의 가속 컴퓨팅 Amazon EC2를 통해 AWS에 곧 출시되어, 클라우드에서 NVIDIA Blackwell 성능을 제공합니다. AWS는 NVIDIA RTX PRO 4500 지원을 발표한 최초의 클라우드 공급업체입니다. 이 Amazon EC2 인스턴스는 Amazon EMR과 함께 사용할 때 데이터 처리 워크로드에 적합합니다. 새로운 Amazon EC2 인스턴스는 AWS Nitro 시스템을 기반으로 구축되어, 프로덕션 환경의 데이터 처리 워크로드에 필요한 향상된 보안, 안정성 및 자원 효율성을 제공합니다.

NVIDIA Nemotron, Salesforce Agentforce 지원

NVIDIA Nemotron Nano 3 모델은 Salesforce Agentforce를 위한 Amazon Bedrock 모델로 제공되어, 배치 처리나 대용량 B2C 앱과 같은 높은 처리량의 애플리케이션으로 Agentforce를 확장합니다. Salesforce의 CRM 에이전틱 벤치마크에 따르면, Nemotron 3 Nano는 요약 및 생성 사용 사례에서 가장 비용 효율적인 모델입니다.

Amazon Bedrock에서 NVIDIA Nemotron 모델을 위한 강화 미세 조정 기능 곧 출시

개발자들은 곧 강화 미세 조정(RFT)을 사용하여 Amazon Bedrock에서 직접 NVIDIA Nemotron 모델을 미세 조정할 수 있게 됩니다. 이는 법률, 의료, 금융 또는 기타 전문 분야 등 특정 도메인에 맞게 모델 동작을 조정해야 하는 팀에게 중요한 기능입니다. 강화 미세 조정을 통해 개발자는 모델이 알고 있는 내용뿐만 아니라 모델이 추론하고 응답하는 방식도 조정할 수 있습니다. Nemotron Nano 3는 곧 RFT를 지원하여 이러한 기능을 AWS 고객에게 제공할 예정입니다.

소프트웨어 제품 정보에 관한 공지를 확인하세요.

Monday, March 16, 1:30 p.m. PT 🔗

NVIDIA 오픈 모델과 Microsoft Foundry 및 Azure Local로 에이전틱 AI, 소버린 AI, 피지컬 AI 시스템 강화

GTC에서 Microsoft는 에이전틱 및 피지컬 AI 시스템을 위한 통합 플랫폼의 업데이트를 발표하며, 실험에서 프로덕션으로의 전환을 가속화했습니다. Microsoft Foundry와 NVIDIA의 오픈 모델 및 가속 컴퓨팅을 결합하면 엄격한 데이터 주권 요구 사항을 충족하면서 커스터마이징을 단순화하는 통합 스택이 구축됩니다.

이러한 추론 집약적 워크로드를 지원하기 위해 Microsoft는 최신 NVIDIA 가속 컴퓨팅 플랫폼을 액체 냉각 방식의 Azure 데이터 센터에 빠르게 통합하고 있습니다. 이는 Microsoft가 1년도 채 되지 않아 전 세계 데이터 센터에 수십만 개의 액체 냉각 NVIDIA Grace Blackwell GPU를 배포한 대규모 인프라 확장의 연장선입니다. Azure는 또한 향후 몇 달에 걸쳐 전 세계에 출시될 새로운 NVIDIA Vera Rubin NVL72 시스템을 가동한 최초의 하이퍼스케일 클라우드 공급자이기도 합니다.

Microsoft Foundry에서 NVIDIA Nemotron으로 특화된 엔터프라이즈 에이전트 구축

개발자들은 이제 NVIDIA Nemotron 오픈 모델을 사용해 Microsoft Foundry에서 직접 특화된 에이전트를 구축하고 배포할 수 있습니다.

에이전트 플랫폼 레이어에서 Microsoft Foundry Agent Service가 정식 출시되어 AI 에이전트를 대규모로 구축, 배포 및 운영할 수 있도록 지원합니다. 새로운 기능으로는 에이전트의 향상된 가시성과 음성 기능이 포함되어, 보안과 거버넌스를 우선시하는 에이전트 플랫폼에서 고객이 실험에서 프로덕션으로 빠르게 전환할 수 있습니다.

NVIDIA Blackwell 및 Rubin 플랫폼으로 가속화된 Azure 컴퓨팅을 활용하여 팀은 Foundry의 모델-as-a-플랫폼 환경에서 이러한 모델에 쉽게 접근할 수 있습니다. 라인업은 Nemotron 3 Super를 포함한 최신 Nemotron 3 추론, 음성 및 비전 모델 제품군과 AI 안전 가드레일 모델로 확대될 예정입니다. Nemotron 모델은 올해 말 Azure에서 관리형 애플리케이션 프로그래밍 인터페이스 서비스로도 제공될 예정입니다.

Microsoft Security도 NVIDIA Nemotron 및 NVIDIA NemoClaw를 활용하여 에이전트 안전성, 보안 및 효율성을 향상시키기 위해 노력하고 있습니다.

“Microsoft에서 신뢰와 보안은 책임감 있는 에이전트 AI 도입에 있어 매우 중요합니다. 그렇기 때문에 우리는 NVIDIA와 Nemotron 및 OpenShell을 포함한 적대적 학습에 대해 협력하여 실시간 적응형 런타임 보호로 업계 및 엔터프라이즈 보안 애플리케이션을 더욱 잘 보호하고 있습니다.”라고 Microsoft Security의 NEXT AI 팀 부사장 Alexander Stojanovic이 말했습니다. “초기 결과는 AI 기반 공격을 찾아 완화하는 데 있어 160배의 개선을 보여주고 있습니다.”

Azure Local에서 소버린 AI 가속화

규제 산업 및 정부 고객을 위해 Azure Local은 고객이 관리하는 환경에서 소버린 AI 역량을 확장하고 있습니다. Azure Local은 이제 NVIDIA RTX PRO 6000 Blackwell Server Edition GPU를 지원합니다. NVIDIA RTX PRO 4500 Blackwell Server Edition GPU 지원도 곧 제공될 예정이며, NVIDIA Rubin 플랫폼 지원은 올해 말 출시될 것으로 예상됩니다. Foundry Local 서비스와 결합하여 고객은 데이터, 추론 및 거버넌스를 자체적으로 통제하면서 온프레미스 환경에서 모델을 실행할 수 있습니다.

Azure에서 Physical AI 구현

로보틱스 및 Physical AI 가속화를 위해 NVIDIA Cosmos 월드 모델과 자율주행차 개발용 NVIDIA Alpamayo 모델을 포함한 NVIDIA 블루프린트 및 오픈 파운데이션 모델이 이제 GitHub와 Foundry에서 제공됩니다. GTC에서 발표된 NVIDIA의 Physical AI 관련 소식에서 자세한 내용을 확인하세요.

이번 전략적 협업에 대한 자세한 내용은 Microsoft 공식 블로그에서 확인하세요.

Oracle과 NVIDIA는 고객과 협력하여 실제 워크로드에 GPU 가속 벡터 인덱스 빌드를 적용하고 있습니다. 초기에 CPU 실행 방식으로 발표된 Oracle Private AI Services Container는 벡터 검색 및 인덱스 생성을 위한 NVIDIA GPU와 NVIDIA cuVS 오픈 소스 라이브러리를 지원하도록 설계되었습니다. 이번 발표는 Oracle AI World 2025에서 출시된 Oracle AI Database 26ai 및 Oracle Private AI Services Container를 기반으로 합니다.

Oracle AI Database 26ai를 사용하여 방대한 비정형 및 멀티모달 데이터를 관리하는 기업들은 이제 벡터 인덱스 생성을 NVIDIA 가속 컴퓨팅으로 오프로드하여 인덱스 빌드 시간을 대폭 단축할 수 있습니다.

헬스케어 워크플로우 강화

헬스케어 분야의 얼리 이노베이터인 Biofy와 Sofya는 Oracle Database에서 GPU 가속 인덱스 빌드를 최초로 탐색하는 기업 중 하나로, 더 빠르고 정확한 AI 기반 임상 및 분석 활용 사례를 목표로 하고 있습니다.

Sofya는 실시간 의료 전사 및 구조화된 임상 문서화를 제공하는 AI 헬스케어 기업으로, 이미 100만 건 이상의 임상 상담을 처리했으며, 환자 상호작용 중 임상 노트를 생성하고 근거 기반 프로토콜을 제안하는 실시간 플랫폼을 제공합니다. 이를 위해서는 방대한 의료 데이터셋에 대한 신선하고 검색 가능한 접근이 필요합니다.

매년 약 150만 편의 새로운 의학 논문이 발표되며, Sofya는 AI 권장 사항이 최신 임상 근거와 긴밀하게 일치하도록 유지해야 합니다. Sofya는 3테라바이트 이상의 미국 의료 라이브러리 데이터에 걸쳐 약 5억 개의 벡터로 구성된 데이터셋을 활용하며, 원래 벡터 인덱스를 구축하는 데 수일이 소요되었습니다. Oracle Private AI Services Container와 NVIDIA cuVS를 통한 GPU 가속 인덱스 빌드는 Sofya가 이 프로세스를 대폭 가속화하는 데 도움이 될 수 있습니다.

Biofy는 헬스테크 기업으로, AI를 사용하여 세균 감염을 신속하게 식별하고 항생제 내성을 예측하며 며칠이 아닌 몇 시간 내에 표적 치료법을 권장합니다. NVIDIA GPU가 탑재된 Oracle Cloud Infrastructure를 사용하여 훈련 및 추론을 확장하고, AI 벡터 검색이 포함된 Oracle Autonomous Database에 유전체 벡터를 저장하여 저지연, 비용 효율적인 쿼리를 제공합니다. 세밀하게 조정된 Llama 기반 모델을 통해 Biofy는 진화하는 세균보다 앞서 나가기 위해 합성 DNA 서열을 지속적으로 생성하므로, 과학자들이 비용이 많이 드는 습식 실험실 실험을 지속적으로 수행할 필요가 없습니다. cuVS는 Biofy가 벡터 검색 인덱스 생성을 가속화할 수 있도록 지원합니다.

GTC에서 발표된 최신 Oracle 및 NVIDIA 발표 사항, 새로운 Vera Rubin이 탑재된 OCI Supercluster를 포함한 모든 정보는 Oracle 블로그에서 확인하세요.

AI 팩토리 성장이 급등하고 있습니다.

GTC에서 발표된 NVIDIA 클라우드 파트너(NCP)들은 AI 팩토리 규모를 전년 대비 두 배로 확장하며, 미국, 호주, 독일, 인도네시아, 인도 등 전 세계에서 소버린 AI를 발전시키고 있습니다.

NCP들은 현재까지 전 세계 AI 팩토리에 NVIDIA GPU 100만 개 이상을 누적 배포하였으며, 이는 1.7기가와트 이상의 AI 역량을 나타냅니다.

이는 수십억 개의 단백질 구조와 제약 화합물의 분자 상호작용을 단 몇 주 만에 연구하거나, 자율주행 차량 훈련을 위해 초현실적인 3D 물리 엔진에서 하루에 수백억 마일의 주행을 시뮬레이션하기에 충분한 컴퓨팅 파워입니다.

지난해 GTC 이후 NCP 배포 규모가 2배 성장했으며 — 당시 NCP들은 누적 40만 개의 NVIDIA GPU를 배포하여 550메가와트의 AI 역량을 보유했습니다 — 이는 조직들이 그 어느 때보다 더 큰 규모로 지능을 생성하고 있음을 보여줍니다. NCP 프로그램의 일원으로서 이들은 모두 차세대 NVIDIA AI 인프라를 지원할 준비가 되어 있습니다.

다음은 NVIDIA 가속 컴퓨팅, 네트워킹 및 최적화된 AI 소프트웨어를 결합한 클라우드 기반 AI 팩토리를 배포하는 주요 NCP들입니다:

- 핀테크 스타트업 혁신 허브 TechQuartier는 서비스형 샌드박스 제공업체 NayaOne과 협력하여 독일에 소버린 Supercharged Sandbox 플랫폼을 구축하고 있습니다. NayaOne은 NVIDIA AI Enterprise 소프트웨어를 활용하고 NCP Polarise가 운영하는 Sovereign AI Factory Frankfurt에서 실행됩니다.

- Zadara와 DDN은 NVIDIA 레퍼런스 아키텍처를 기반으로 멀티 테넌트 소버린 클라우드 및 AI 팩토리를 위한 고성능 AI 인프라를 제공하기 위한 전략적 파트너십을 발표합니다. 두 회사는 서비스 제공업체, 통신사 및 기업이 컴플라이언스, 비용, 테넌트 격리, 성능 서비스 수준 계약에 대한 완전한 통제권을 유지하면서 NVIDIA 기반 AI 인프라를 신속하고 안전하며 효율적으로 배포할 수 있도록 지원합니다.

- 말레이시아 기반 NCP 및 AI 연구소인 YTL은 현지 맥락화 데이터로 학습하여 말레이시아에서 배포되는 ILMU 대형 언어 모델 제품군에 Nemotron 3 기술과 데이터를 활용하고 있습니다.

- 독일 연방 경제에너지부의 지원을 받는 독일 연구 컨소시엄 SOOFI는 유럽의 AI 주권을 강화하고 널리 사용되는 새로운 AI 애플리케이션의 기반을 마련하기 위해 Sovereign Open Source Foundation Models 이니셔티브의 일환으로 새로운 소버린 AI 모델을 훈련하고 있습니다. SOOFI는 신뢰할 수 있고 확장 가능한 AI 모델 구축에 필요한 소버린하고 안전한 고성능 환경을 제공하기 위해 NVIDIA Nemotron 3 Nano 및 Super와 Deutsche Telekom의 산업용 AI 클라우드를 활용하여 파운데이션 모델을 구축하고 있습니다.

NCP 프로그램에 대해 자세히 알아보세요 NCP 프로그램.

헬스케어 🔗

태평양 표준시 기준 3월 16일 월요일 오후 1시 30분 🔗

NVIDIA, 헬스케어 로보틱스를 위한 오픈 피지컬 AI 모델 공개

CMR Surgical, Johnson & Johnson MedTech 등 수술 로보틱스 분야 선도 기업과 수술용 피지컬 AI 플랫폼 개발사인 PeritasAI, Proximie가 GTC에서 공개된 헬스케어 특화 피지컬 AI 도구를 가장 먼저 채택하는 기업들 중 하나가 되었습니다.

수년간 헬스케어 분야의 AI는 주로 화면 위에 머물며 의료 이미지를 분석하고 환자 예후를 예측하는 역할을 해왔습니다. 이제 NVIDIA가 헬스케어 로보틱스를 위한 최초의 도메인 특화 피지컬 AI 플랫폼을 출시함으로써, AI는 화면을 넘어 물리적 세계로 나아가고 있습니다.

수술 로보틱스 분야의 선도 기업과 혁신 기업들 — CMR Surgical, Johnson & Johnson MedTech, Moon Surgical, Rob Surgical — 은 NVIDIA의 헬스케어 특화 피지컬 AI 도구를 채택해 합성 데이터 생성, 로봇 정책 평가, 디지털 트윈 구축 등의 워크플로우를 가속하고 있습니다.

PeritasAI는 이러한 기술을 통합해 수술 운영을 위한 피지컬 AI 플랫폼을 구축하고 있으며, 로봇과 멀티 에이전트 인텔리전스를 결합해 실시간으로 감지·조율·행동할 수 있도록 합니다. 또 다른 피지컬 AI 플랫폼 개발사인 Proximie는 수술실에서 수술팀을 지원할 수 있는 비전 언어 모델을 개발하고 있습니다.

GTC에서 발표된 이 도구들은 개발자들이 차세대 헬스케어 로봇으로 의료 서비스를 혁신하는 데 필요한 견고하고 개방적인 인프라를 제공합니다. 주요 구성 요소는 다음과 같습니다:

- Open-H, 세계 최대 규모의 헬스케어 로보틱스 데이터셋입니다. 약 30여 개의 협력 기관과 함께 구축된 Open-H는 수술 절차의 실제 다양성과 복잡성을 반영하며, 700시간 이상의 수술 영상을 제공해 고급 범용 로봇 시스템 개발을 가속합니다.

- Cosmos-H, Cosmos-H-Surgical을 포함하는 오픈 모델 패밀리로, NVIDIA Cosmos를 기반으로 도메인별 물리 기반 합성 데이터를 대규모로 생성합니다. 프롬프트, 참조 이미지 또는 영상, 페어링된 로봇 기구학(kinematics)으로부터 수술 영상을 생성하는 세 가지 모델을 갖춘 Cosmos-H는 개발자가 실제 데이터셋을 실사에 가까운 시뮬레이션으로 보강하고, 수술 환경의 미래 상태를 예측함으로써 로봇 정책을 평가할 수 있게 합니다.

- GR00T-H: NVIDIA Isaac GR00T N을 기반으로 한 이 비전 언어 액션(VLA) 모델은 임상 작업을 설명하는 텍스트 명령을 처리하고 액션 토큰이라 불리는 동작 명령을 생성합니다. Open-H로 학습된 이 모델은 의료 환경에서 복잡한 물리적 동작을 수행하도록 개발된 로봇을 훈련하고 평가하는 데 활용할 수 있습니다.

- Rheo: AI 의료 로봇을 위한 Isaac for Healthcare 개발자 프레임워크 내에서 제공되는 이 개발자 블루프린트는 병원 환경의 물리적으로 정확한 시뮬레이션을 개발자가 구축할 수 있게 합니다. 임상 워크플로우, 의료 기기 상호작용, 사람의 움직임 및 병원 물류를 시뮬레이션하여 대규모 자동화 전략을 안전하게 개발하고 테스트하는 데 활용할 수 있습니다.

35개 협력 기관과 함께 구축된 Open-H 데이터셋은 776시간의 수술 영상, 11가지 로봇 시스템 형태(embodiment), 4가지 수술 적응증을 포함합니다.

수술 로봇, 의료 영상 및 병원 자동화 분야의 선도 기업들이 이미 NVIDIA의 물리적 AI 기술을 의료 로봇에 활용하고 있습니다:

- CMR Surgical 은 GR00T-H 사전 학습을 지원하기 위해 약 500시간 분량의 수술 영상을 Open-H에 제공하고 있습니다. 또한 Cosmos-H를 활용해 물리적으로 정확한 합성 수술 데이터를 생성하고 새로운 로봇 정책을 평가하고 있습니다.

- Johnson & Johnson MedTech 는 Cosmos 기반 파운데이션 모델과 Isaac for Healthcare의 해부학적 시뮬레이션을 활용하여 비뇨기과용 MONARCH 플랫폼의 포스트 트레이닝 워크플로우에 필요한 데이터를 생성하고 강화하고 있습니다.

- PeritasAI, Isaac for Healthcare와 Rheo를 활용하여 휴머노이드 로봇 및 VLA 모델을 훈련하고 있으며, 이를 통해 수술 환경에 체화된 지능을 도입하고 있습니다 — 실시간 상황 인식, 무균 조율, 수술 기구·임플란트·수술실 워크플로우의 지능형 관리를 통해 수술팀을 지원합니다. 이 연구는 Lightwheel 및 Advent Health Hospitals와의 협력으로 진행됩니다.

- Proximie 는 Cosmos-H를 사용하여 수술실 이미지와 수술 중 영상을 결합한 멀티모달 비전 언어 모델을 훈련하고 있습니다. 이 모델은 수술 경로 전반에 걸쳐 수술 인사이트와 조율 기능을 제공하는 실시간 AI 에이전트를 구동합니다.

NVIDIA 헬스케어 로보틱스 기술의 추가 도입 기업으로는 Moon Surgical과 Rob Surgical이 있습니다.

Open-H, Cosmos-H 및 GR00T-H는 현재 GitHub와 Hugging Face에서 개발자들이 특정 수술 시나리오에 맞게 사후 훈련 및 적용할 수 있도록 제공됩니다. 이 도구들은 NVIDIA Isaac for Healthcare 및 Rheo 블루프린트와 연동되어 수술 로봇의 훈련 및 평가를 위한 시뮬레이션 파이프라인을 구동합니다.

Rheo 블루프린트에 대해 자세히 알아보려면 NVIDIA 기술 블로그를 방문하세요.

3월 16일 월요일, 오후 1:30 PT 🔗

NVIDIA, Google DeepMind, EMBL, AI 기반 생물학 및 신약 개발 가속화를 위한 세계 최대 단백질 복합체 데이터셋 공개

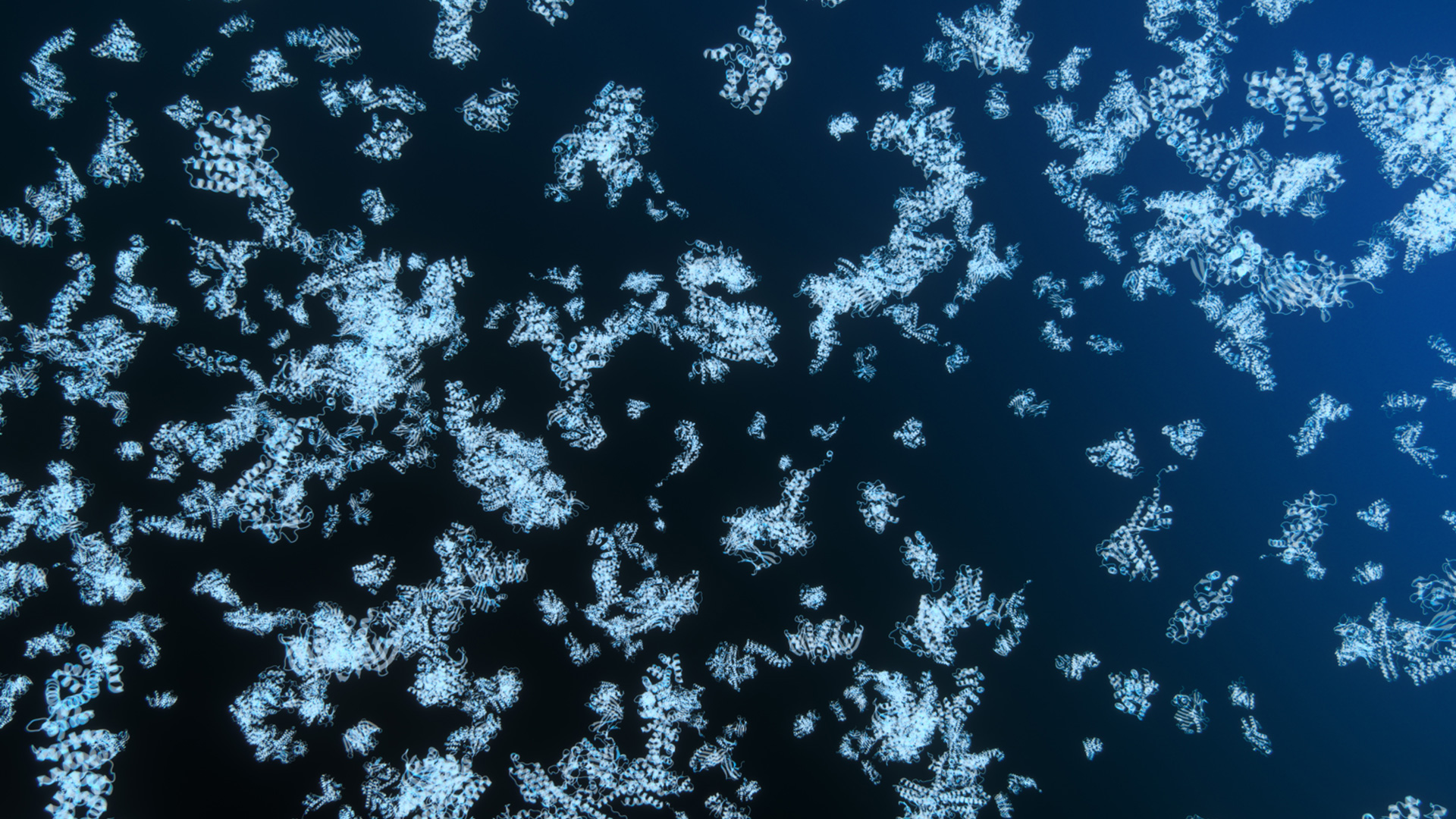

NVIDIA, Google DeepMind, EMBL의 유럽 생물정보학 연구소, 서울대학교 Steinegger 연구실은 AlphaFold 단백질 구조 데이터베이스를 대폭 확장하여 검색 가능한 데이터베이스에 170만 개의 신뢰도 높은 예측 단백질 복합체를 추가하는 한편, 약 3,000만 개의 추가 예측 구조를 대량 다운로드용으로 제공하고 있습니다.

새로 추가된 이 데이터셋은 동종 최대 규모로, 데이터베이스를 전례 없는 규모로 단백질 간 상호작용을 모델링하는 데 활용할 수 있는 종합 리소스로 탈바꿈시킵니다.

Google DeepMind의 AlphaFold-Multimer 모델은 데이터베이스에 AI 예측 단백질 구조를 제공했습니다. 이 모델은 NVIDIA 컴퓨팅 라이브러리인 NVIDIA TensorRT와 cuEquivariance를 OpenFold 추론 파이프라인에 통합하여 가속화되었으며, 기존 대비 100배 이상 빠른 추론 속도를 달성했습니다.

데이터베이스는 이러한 사전 계산된 단백질 구조를 가설로 제공함으로써 신약 표적 및 질병 생물학 발견에서 실험적 검증을 가속화합니다.

이는 특히 고성능 슈퍼컴퓨터에 대한 접근성이 부족한 저자원 환경의 연구자들에게 존재했던 막대한 계산 장벽을 제거합니다.

이 이니셔티브는 분류학적 다양성을 대표하는 단백질 세트인 참조 프로테옴과 세계보건기구 우선순위 목록을 중점적으로 다루어 감염병 연구를 강화합니다.

제약 업계에서 이러한 예측 구조는 강력한 초기 가설로 활용되어 후속 습식 실험을 크게 가속화하고 소중한 시간과 자원을 절약합니다.

태평양 표준시 기준 3월 18일(수) 오전 9시 🔗

NVIDIA Nemotron 오픈 모델, NeMo 라이브러리 및 AI 데이터 플라이휠, 차세대 디지털 헬스 에이전트 구현

NVIDIA Nemotron 오픈 모델 패밀리와 NVIDIA NeMo 라이브러리는 임상의, 연구자, 개발자에게 오픈 가중치와 레시피를 제공하여 자체 인프라에서 직접 맞춤형 디지털 헬스 에이전트를 구축하고 배포할 수 있도록 지원합니다.

고해상도 이미징부터 종단적 환자 기록에 이르기까지 다양한 요인에 의해 멀티모달 의료 데이터 볼륨이 폭발적으로 증가함에 따라, 업계는 기존 모델로는 대응하기 어려운 규모의 도전에 직면해 있습니다. 고효율 저지연 Nemotron 오픈 모델은 이러한 방대한 데이터 유입을 처리하는 데 필요한 전문 도구를 제공하여, 연구자들이 비용이 많이 드는 폐쇄형 시스템 의존도에서 벗어나 지연 시간과 운영 비용을 절감할 수 있도록 합니다.

NeMo를 사용하면 개발자들은 범용 AI가 놓치는 경우가 많은 의료 전문 용어에 맞춰 모델을 파인튜닝할 수 있습니다. 이러한 효율성은 이미 실질적인 성과로 이어지고 있습니다. 최근 연구에서 Heidi Health는 임상 문서화를 위한 Nemotron Speech 모델로 전환함으로써 지연 시간을 75% 줄이고 운영 비용을 64% 절감했다고 보고했습니다.

의료 기업들은 이미 Nemotron을 도입해 에이전트 솔루션을 구동하고 있습니다. Hippocratic AI 는 NeMo를 사용하여 환자와의 임상 대화를 위한 대규모 도메인 특화 모델을 훈련하고 있습니다. Sword Health는 NeMo RL을 활용해 AI 기반 정신 건강 지원 모델을 파인튜닝하고 있습니다. IQVIA는 NVIDIA와 협력하여 생명과학 분야의 AI 에이전트를 개발하고 있으며, IQVIA의 도메인 전문성과 독점 데이터, 그리고 안전하고 책임감 있는 AI에 대한 의지를 바탕으로 합니다. OpenEvidence는 Nemotron을 배포하여 의료 인텔리전스를 종합하는 에이전트를 구축하고 있습니다. Verily 는 Nemotron을 통합하여 개인이 건강 데이터를 해석하고 증상을 파악하는 데 도움을 주는 AI 동반자 Violet을 구동할 계획입니다.

이러한 오픈 모델을 의료 서비스 전반에 통합함으로써 NVIDIA는 환자 치료가 개인화되고, 데이터 보안이 강화되며, 효율성이 기하급수적으로 향상되는 미래를 위한 토대를 마련하고 있습니다.

NVIDIA의 최신 의료 및 생명과학 분야 AI 현황 설문조사에 따르면, 의료 리더의 82%가 오픈 소스를 전략의 핵심 요소로 인식하고 있는 것으로 나타났습니다. 오픈 모델을 도입하고 파인튜닝하여 자체 환경에서 운영함으로써, 의료 기관들은 데이터 주권을 확보할 수 있습니다. 이를 통해 투명성과 재현성을 통제하는 동시에, 복잡한 에이전트 애플리케이션에서 최고 수준의 정확도를 유지할 수 있습니다.

NVIDIA AI 의료 및 생명과학에 대해 자세히 알아보세요.

태평양 표준시 기준 3월 18일(수) 오전 9:00 🔗

NVIDIA BioNeMo 플랫폼, 혁신적인 데이터셋 공개로 유전체 치료제 및 가상 세포 모델 발전 촉진

신경 회로 해독: 게놈 규모 CRISPR 섭동의 전뇌 시각화. 영상 제공: PerturbAI.

유전자 편집, 면역 치료, RNA 의약품 등 혁신적인 치료법은 빠르고 대규모적인 유전체 분석을 필요로 합니다. 방대한 유전체 데이터와 단일세포 데이터를 통합하는 것은 치료 표적을 발굴하고 더 안전한 개입을 설계하는 데 필수적이지만, 기존 파이프라인은 연구를 수개월에서 수년까지 지연시킬 수 있습니다.

NVIDIA BioNeMo 플랫폼은 NVIDIA Parabricks와 NVIDIA CUDA-X Data Science (DS) 라이브러리를 포함한 GPU 가속 도구, 프레임워크, AI 모델의 통합 제품군으로, 유전체 워크플로우를 획기적으로 가속화합니다.

GTC에서 NVIDIA는 치료제 발굴을 위해 BioNeMo로 데이터를 처리하고 모델을 개발하는 헬스케어 및 생명과학 기업들의 새로운 물결을 조명했습니다.

Basecamp Research의 Trillion Gene Atlas

Basecamp Research의 Trillion Gene Atlas(TGA)는 Anthropic, Ultima Genomics, PacBio와의 협력으로 출시되었으며, NVIDIA AI 인프라를 기반으로 유전적 다양성에 대한 인사이트를 100배 확장하도록 설계된 생물학적 데이터 수집 이니셔티브입니다.

GTC에서 Basecamp Research는 전 세계 수천 개의 현장에서 수백만 종에 달하는 새로운 생물의 유전체 데이터를 수집하고 있으며, 이미 모든 공개 데이터베이스를 합친 것보다 10배 큰 데이터셋인 BaseData를 100배 확장한다고 발표했습니다. 이번 확장을 통해 연구자들은 차세대 생물학적 기반 모델을 활용해 새로운 근치적 치료법을 설계하고 개발할 수 있게 됩니다.

TGA를 활용하여 Basecamp는 NVIDIA Parabricks로 수경(quadrillion) 개의 DNA 염기쌍을 처리하는 것을 목표로 하고 있으며, 데이터 처리 속도를 10배 향상시켜 20년 이상 걸렸을 분석을 2년 이내에 완료할 수 있게 됩니다.

Tahoe, 가상 세포 모델을 위한 수십억 세포 규모를 향해 확장

Tahoe Therapeutics는 새로운 가상 세포 모델 아키텍처를 구축하기 위해 세계 최대 규모의 개별 단일 세포 데이터셋인 Tahoe-100M을 개발했습니다. 이 AI 기반 시뮬레이션은 실제 생물학적 세포의 복잡하고 동적인 동작을 모방하여, 대규모의 비용이 많이 드는 실험실 실험 없이도 치료제 발견이 가능합니다.

370개 이상의 화합물과 50개 세포주에 걸친 1억 개의 세포를 보유한 Tahoe-100M은 GPU 가속을 통해서만 가능한 규모로 단일 세포 분석을 확장합니다.

Tahoe-100M 학습 파이프라인은 NVIDIA H200 GPU에서 엔드 투 엔드로 실행되며 NVIDIA cuVS 라이브러리를 활용합니다. Tahoe는 NVIDIA DGX B200 시스템에서 실행하고 scverse가 개발한 RAPIDS-singlecell 프레임워크를 활용하여 10억 개의 세포로 확장할 계획입니다.

PerturbAI의 생체 내 뇌 교란 데이터셋

NVIDIA 생물학 파운데이션 모델 연구팀과의 협력을 통해, PerturbAI는 세계 최대 규모의 생체 내 CRISPR 기능 유전체학 아틀라스를 공개했습니다. 이는 살아있는 조직에서 유전자 기능에 관한 가장 큰 인과 지도 중 하나를 구성하는 거의 800만 개의 뇌 전체 세포 데이터셋입니다.

이 회사는 NVIDIA CUDA-X DS를 사용하여 신경퇴행성 질환, 정신 질환 및 대사 질환의 근본적인 새로운 생물학적 메커니즘을 발견하고 있습니다. NVIDIA RTX PRO 6000 GPU 가속 워크플로우와 교란 분석을 위한 새로운 RAPIDS-singlecell 기능 덕분에 팀의 분석 시간이 며칠에서 거의 실시간으로 단축되었습니다.

NVIDIA Blueprints의 단일 세포 분석 및 유전체학을 사용해 보시고, GTC 세션 “인실리코 생명과학 및 신약 발견으로의 경로 가속화“에서 더 자세히 알아보세요.

연구 및 오픈 소스 🔗

태평양 표준시 3월 18일 수요일 오후 6:00 🔗

NVIDIA CEO Jensen Huang, GTC에서 AI 오픈 모델 선구자들을 소집하다

Mistral, Perplexity, Cursor, Thinking Machines Lab 등의 CEO들이 Huang과 함께 무대에 올라 오픈 프론티어 시대의 다음 단계를 논의했습니다.

올해 NVIDIA 창립자 겸 CEO Jensen Huang은 오픈 AI에 대한 투자 수익 문제가 이론의 영역을 벗어나 실제로 답이 나오기 시작하는 해라고 선언했습니다.

Huang은 수요일 GTC에서 오픈 모델 생태계를 이끄는 11명의 리더들을 한자리에 초청했습니다. 이 자리는 오픈 혁신과 클로즈드 혁신을 논쟁하기 위한 것이 아니라, 앞으로 나아갈 방향을 함께 그려보기 위한 것이었습니다.

산호세 시빅에서 두 개의 패널 세션으로 이어진 90분간의 행사에는 LangChain, Cursor, Reflection AI, Perplexity, Thinking Machines Lab, Mistral, OpenEvidence, Black Forest Labs의 CEO들과 함께 AI2의 자연어 처리 수석 이사 Hanna Hajishirzi, AMP PBC 창립자 Anjney Midha가 참석했습니다.

Huang은 새로운 시각을 제시하며 자리에 임했습니다.

“독점과 오픈의 대립 구도는 더 이상 유효하지 않습니다”라고 그는 청중에게 말했습니다. “독점 그리고 오픈입니다.”

첫 번째 패널은 오픈 모델 생태계가 어떻게 발전해 왔는지에 초점을 맞췄습니다. LangChain의 Harrison Chase, Perplexity의 Aravind Srinivas, Cursor의 Michael Truell, Reflection AI의 Misha Laskin, Thinking Machines Lab의 Mira Murati가 참여했습니다.

Truell은 업계가 세 번째 유형의 기업의 부상을 목격하고 있다고 주장했습니다. 순수한 기반 모델 연구소도, 순수한 애플리케이션 개발사도 아닌, 그 중간 어딘가에 위치한 기업입니다. 이는 “API 수준에서 시장이 제공하는 최선을 취하고, 모델링 최전선에서 탁월한 성과를 거두며, 이 모든 것을 특정 수직 분야에 최적화된 최고의 제품으로 통합하는” 기업입니다.

그 결과 모델, 시스템, 제품을 하나의 단일 스택으로 통합하는 새로운 유형의 AI 기업이 탄생하고 있습니다.

대화는 계속해서 에이전트로 돌아왔습니다.

Srinivas는 Perplexity의 비전을 “AI가 할 수 있는 모든 것을 아우르는 오케스트레이션 시스템”을 구축하는 것으로 묘사했습니다. 여기서 모델은 악기가 되고 시스템이 지휘를 맡습니다.

“이제 드디어 모델보다 한 단계 높은 추상화 수준에서 운영할 수 있게 됐습니다”라고 그는 말했습니다. “그것이 제가 매우 흥미롭게 생각하는 부분입니다.”

Laskin은 독립형 모델을 “몸 없는 두뇌”라고 표현했습니다. 그는 Open Claw의 출시가 AI가 파일 시스템과 상호작용하고 자율적인 작업을 수행하는 데 필요한 “사지”를 제공했다고 주장했습니다.

Chase는 조용히 진행 중인 변화를 지적했습니다. “하네스 엔지니어링이라는 새로운 용어가 있습니다”라고 그는 말했습니다. 이는 모델을 둘러싼 모든 것, 즉 시스템에 연결하는 방법, 어떤 서브 에이전트를 사용하고 어떤 도구를 언제 호출할지에 관한 분야입니다.

“Claude Code를 보면 모델 자체도 훌륭하지만, 그 모델을 감싸는 하네스도 정말 훌륭합니다”라고 그는 덧붙였습니다.

Murati는 더 긴 흐름으로 물러서서 바라봤습니다. “우리는 지수적 성장의 시대에 있고, 모든 것이 매우 압축되어 있습니다”라고 그녀는 말했습니다. “그리고 이것은 대형 연구소만으로는 완전히 이룰 수 없습니다.”

모델, 인프라, 사후 훈련에 대한 접근 개방은 이미 폐쇄형 모델 세계에서는 불가능한 방식으로 연구를 가속화하고 있습니다.

Huang은 단순한 아이디어로 계속 돌아왔습니다. AI는 모델이 아니라 시스템이라는 것입니다.

그리고 코딩은 단지 시작에 불과하다고 그는 암시했습니다.

“코딩은 단순한 소프트웨어 엔지니어링이 아닙니다”라고 그는 말했습니다. “그것은 비즈니스 프로세스를 코드화한 설명입니다… 거의 모든 업무입니다.”

시스템에서 판도로

두 번째 패널에는 Mistral의 Arthur Mensch, OpenEvidence의 Daniel Nadler, AI2의 Hajishirzi, Black Forest Labs의 Robin Rombach, AMP PBC의 Midha가 참여했습니다.

여기서 대화는 시스템에서 판도로 전환되었습니다.

Huang은 이를 명확하게 설명했습니다.

“지난 3년간 모든 질문은 AI의 ROI가 무엇인가였습니다”라고 그는 말했습니다. “이제는… 실제 비즈니스 경제가 도약하는 변곡점을 목격하게 될 것입니다.”

Nadler는 에이전트 시스템의 증명 무대로서 헬스케어의 사례를 제시했습니다.

사전 승인 서신, 보험 이의 신청 등 다단계적이고 반복적이며 예측 가능한 워크플로우는 에이전트가 탁월한 성과를 발휘하는 영역입니다.

“의사가 잠든 사이에 에이전트가 그 보험 거부에 이의를 제기하여, 결국 환자가 중요하거나 심지어 생명을 구할 수도 있는 치료를 받을 수 있도록 하는 모습을 상상해 보세요”라고 그는 말했습니다.

Mensch는 오픈 모델이 제어와 맞춤화라는 두 가지 이점을 제공한다고 주장했습니다.

기업들은 에이전트가 접근하고 실행할 수 있는 것을 정확히 관리하고, 범용 모델이 완전히 파악하지 못할 실제 시스템에 맞게 적응시킬 필요가 있습니다.

Midha는 산업적 관점에서 판도를 설명했습니다.

오픈 모델에는 오픈 인프라가 필요합니다. 모든 규모의 기업이 확장할 수 있는 컴퓨팅 그리드가 필요하죠. 그 의미는 명확합니다. 가시적이고 제어 가능한 시스템은 폐쇄적인 시스템보다 신뢰하기가 훨씬 쉽습니다.

“결국, 이러한 에이전트들을 우리 삶에서 가장 중요한 부분에 받아들이려면 그것들을 신뢰해야 합니다”라고 Midha는 말했습니다. “그리고 오픈 모델은 시스템을 신뢰할 수 있는 가장 빠른 방법 중 하나입니다.”

다시 말해, 프론티어는 더 이상 소수의 연구소에 의해 정의되는 것이 아니라, 그 위에서 무엇이 구축되고, 배포되고, 활용되는가에 의해 정의됩니다.

전체 세션을 시청하고 NVIDIA Nemotron 오픈 모델로 구축을 시작하세요.

2026년 3월 19일 목요일, 오후 12시 30분 (태평양 표준시) 🔗

AI가 빛의 속도를 만날 때: NVIDIA의 Bill Dally와 Google의 Jeff Dean이 말하는 다음 단계

GTC 청중이 가득 모인 가운데, 컴퓨팅 분야에서 가장 영향력 있는 두 인물이 무대에 올랐습니다. 바로 NVIDIA 수석 과학자 Bill Dally와, 대규모 머신러닝의 정의에 기여한 Google DeepMind 및 Google Research 수석 과학자 Jeff Dean입니다.

이어진 대화는 패널 토론이라기보다 딥 러닝 잼 세션에 가까웠습니다. AI 모델이 어떻게 진화하고 있는지, 그리고 왜 하드웨어 아키텍처가 이제 AI 발전과 불가분의 관계가 되었는지를 깊이 있게 탐구하는 자리였습니다.

Dean은 모델 역량이 얼마나 빠르게 발전했는지를 되돌아보며 발언을 시작했습니다. 특히 “수학과 코딩처럼 검증 가능한 보상이 있는” 영역에서의 발전이 두드러진다고 말했습니다. 한때 모델이 처리하지 못했던 작업들이 이제는 안정적으로 실행되고, 에이전트 기반 워크플로는 최소한의 감독 하에 몇 시간, 심지어 며칠 동안 운영되기 시작했습니다. Dean은 이러한 변화가 AI 시스템의 본질을 바꾸고 있다고 지적했습니다. 프롬프트에 반응하는 도구에서 “백그라운드에서 작동하는” 에이전트로 전환되고 있다는 것입니다.

Dally에게 있어 이러한 진화는 지연 시간을 핵심 과제로 부각시킵니다. 에이전트가 규모에 맞게 추론하고 계획하며 반복 작업을 수행하려면, 추론 속도가 최우선 설계 제약 조건이 됩니다. 그는 오늘날의 지연 시간 대부분이 연산 자체가 아니라 통신에서 비롯된다고 설명했습니다. 레이어 전환마다, 칩 외부로의 이동마다, 와이어를 통해 전송되는 모든 비트가 시간과 에너지를 소모합니다. NVIDIA의 대응은 아키텍처를 Dally가 “빛의 속도” 설계라고 부르는 방향으로 밀어붙이는 것입니다. 즉, 라우팅 오버헤드를 최소화하고, 큐잉을 제거하며, 데이터가 이동해야 하는 물리적 거리를 줄이는 것입니다.

데이터를 이동시키지 않는다는 동일한 원칙은 대화가 에너지 효율로 넘어가면서도 반복적으로 등장했습니다. 단일 곱셈-덧셈 연산은 수 펨토줄(극히 작은 에너지 단위)에 불과하지만, 외부 메모리에서 데이터를 가져오는 데는 수천 배 더 많은 비용이 들 수 있습니다. Dally는 연산을 메모리 옆에 배치하는 것, 즉 SRAM 지역성을 활용하고 적층형 DRAM 기술을 탐구함으로써 이 균형을 근본적으로 바꿀 수 있다고 설명했습니다. 목표는 단순히 전력 소비를 줄이는 것이 아니라, 동일한 전력으로 훨씬 더 높은 성능을 달성하는 것입니다.

또한 AI를 활용해 AI를 구동하는 칩 자체를 설계하는 방법에 대한 논의도 이어졌습니다. Dally는 강화 학습 시스템이 이제 하룻밤 사이에 표준 셀 라이브러리, 즉 사전 설계되고 검증된 기본 논리 빌딩 블록의 모음을 생성하는 방법과, NVIDIA의 설계 이력을 학습한 내부 대규모 언어 모델이 신입 엔지니어들이 수십 년에 걸친 아키텍처 지식을 탐색하는 데 어떻게 도움을 주는지 설명했습니다. 이러한 시스템은 인간 설계자를 대체하는 것이 아니라 그들의 역량을 증폭시켜 개발 일정을 단축하고 탐구할 가치 있는 아이디어의 공간을 확장합니다.

앞을 내다보며 두 연사는 공통된 주제에 수렴했습니다. 바로 공동 설계입니다. 돌파구는 머신러닝 연구자와 시스템 아키텍트 간의 긴밀한 피드백 루프에서 나올 것입니다. Dean이 말했듯이, 때로는 실리콘에 작은 실험적 기능을 추가하는 것이 큰 성과로 이어질 수 있으며, “하드웨어에서 10~20배”의 가속을 이끌어낼 수 있습니다.

세션은 인간적인 메모로 마무리되었습니다. 교육, 의료, 과학적 발견은 AI의 영향이 심오하게 긍정적일 수 있는 분야로 두드러졌습니다 — 특히 시스템이 개인화되고, 맥락을 이해하며, 지속적으로 학습하게 될 때 더욱 그렇습니다. “AI를 의료에 활용하는 것은 정말 큰 영향을 미칠 것이라고 생각합니다”라고 Dean이 말했습니다.

무대 위의 두 업계 선구자가 함께 그린 미래가 실현된다면, 그것은 단순히 더 나은 하드웨어에서 더 빠른 모델이 구동되는 것이 아닐 것입니다. 지능, 효율성, 규모가 조화롭게 발전하는 새로운 컴퓨팅 시대가 될 것입니다.

AI 연구자들, 추론·시뮬레이션·로보틱스의 발전에 대해 논하다

또 다른 기대를 모은 강연에도 많은 청중이 자리를 가득 채웠습니다: Two Minute Papers 크리에이터 Károly Zsolnai‑Fehér가 진행을 맡은, 네 명의 선구적인 AI 연구자들이 참여한 라운드테이블이었습니다.

이어진 시간은 AI의 다음 시대를 형성하는 혁신들을 빠르게 훑어보는 여정이었습니다 — 추론 가능한 언어 모델부터 생성형 시뮬레이션, 제로샷 로보틱스까지.

패널리스트로는 Yejin Choi, Marco Pavone, Sanja Fidler, Yashraj Narang이 참여했습니다.

진행자 Károly Zsolnai‑Fehér는 NVIDIA Research의 3DGUT 등 주요 AI 연구 논문을 맞히는 퀴즈 게임으로 청중과 소통했습니다.

NVIDIA AI 리서치 시니어 디렉터 Yejin Choi는 강화 학습을 사전 학습 단계에 직접 주입하는 새로운 훈련 방식을 소개하며 토론의 문을 열었습니다. 단순히 다음 토큰을 예측하는 방식에서 벗어나, 모델이 답을 생성하기 전에 스스로 가능한 추론 경로를 탐색하도록 유도합니다. 그 결과, 모델이 더 일찍, 더 효과적으로 추론하는 법을 배우는 “탐색적 학습의 시대”로의 전환이 이루어지고 있다고 그녀는 말했습니다.

NVIDIA 자율주행 연구 시니어 디렉터 Marco Pavone은 자율주행 개발을 위한 NVIDIA Alpamayo — 오픈 AI 모델, 시뮬레이션 툴 및 데이터셋 패밀리 — 의 최신 업데이트를 발표했습니다. 최신 릴리스인 Alpamayo 1.5 추론 비전 언어 행동 모델은 내비게이션 텍스트 프롬프트 가이던스와 새로운 사후 훈련 정렬 툴을 추가해 모델의 추론과 행동 간의 연결을 강화하며, 개발자들이 “자신의 데이터셋에 맞게 모델을 커스터마이징”할 수 있게 해줍니다.

이어서 대화는 시뮬레이션으로 이어졌습니다. NVIDIA AI 리서치 부사장 겸 NVIDIA 토론토 AI 연구소 소장인 Sanja Fidler는 수작업으로 제작된 환경을 신경 재구성 및 생성형 시뮬레이션이 대체하고 있는 방식을 선보였습니다. Fidler는 “우리는 생성형 시뮬레이션의 시대에 접어들었습니다”라고 말했습니다.

그녀의 팀이 새롭게 개발한 AlpaDreams 시스템은 실시간으로 멀티 카메라, 물리 인식 장면을 생성할 수 있어 개발자들이 정책을 대화형으로 테스트할 수 있습니다. “AlpaDreams는 기본적으로 여러 카메라를 시뮬레이션하며, 모두 실시간으로 정책에 반응합니다.”라고 그녀는 말했습니다.

패널을 마무리한 NVIDIA의 선임 로보틱스 연구 매니저 Yashraj Narang은 Neural Robot Dynamics와 같은 신경 시뮬레이터가 기어 조립부터 케이블 배선까지 복잡한 물리적 기술을 완전히 시뮬레이션 내에서 로봇에게 가르친 후 실제 세계로 직접 전이하는 방법을 시연했습니다. “수십만 개의 이러한 환경을 실시간으로 병렬 처리할 수 있습니다.”라고 그는 말했습니다.

이 대화는 AI의 다음 프런티어를 엿볼 수 있는 기회를 제공했습니다. 추론하는 모델, 세계를 생성하는 시뮬레이터, 그리고 현실에서 행동하기 전에 상상 속에서 학습하는 로봇이 바로 그것입니다.

전체 세션을 시청하고 NVIDIA Research에 대해 자세히 알아보세요.

2025년 3월 20일 금요일 오후 5:00 PT 🔗

Nemotron Days: 에이전틱 AI의 미래 구축

GTC에서 열린 Nemotron Days는 개발자, 파트너 및 AI 커뮤니티가 한자리에 모여 차세대 에이전트의 구축, 배포 및 확장 방법을 탐색하는 자리였습니다. 목표는 개발자들이 단기간 운영되는 챗봇에서 오픈 기반 위에 구축된 장기 실행 자율 에이전트로 전환할 수 있도록 돕는 것이었습니다.

인터랙티브 세션, 데모 및 파트너 쇼케이스를 통해 참석자들은 NVIDIA OpenShell 런타임, LangChain 기반의 NVIDIA AI‑Q Blueprint 및 NVIDIA Nemotron 오픈 모델 등 에이전틱 AI의 미래를 만들어가는 핵심 기술을 직접 체험했습니다. 세션에서는 지속적으로 실행되고 시간이 지남에 따라 학습하도록 설계된 적응형 오픈 소스 에이전트를 설계하고 배포하는 방법에 대한 실제 사례를 개발자들에게 안내했습니다.

협업이 핵심 주제였으며, Cursor, CodeRabbit, ServiceNow 팀이 참여한 세션에서는 Nemotron 기술이 에이전틱 AI 생태계 전반에 걸쳐 이미 실용적인 솔루션을 가능하게 하는 방법을 조명했습니다.

Nemotron Days 개발자 라이브스트림은 현재 온디맨드로 제공됩니다.

수요일, 3월 18일, 오후 5:30 PT 🔗

CUDA 20주년: 가속 시대의 설계자들을 기리며

2006년 대담한 병렬 컴퓨팅 도전으로 시작된 것이 이제 현대 과학과 AI의 근본적인 토대로 발전했습니다.

GTC에서 NVIDIA는 CUDA 20주년을 기념합니다 — 이는 컴퓨팅 스택의 모든 계층에서 혁신을 이루어온 600만 명 이상의 개발자들의 노력을 상징합니다. 오늘날 CUDA는 최초의 커널을 작성한 선구자들과 조 단위 매개변수 AI 모델을 배포하는 차세대 개발자들을 잇는 세대적 교량 역할을 합니다.

NVIDIA CUDA 아키텍트 Stephen Jones의 주도로 진행된 GTC 수요일 패널 세션에는 Jump Trading, Meta Superintelligence Labs, NVIDIA의 연구원 및 엔지니어들이 참여해 CUDA 혁신의 수십 년을 돌아보고, CUDA가 개발자들이 세계에서 가장 복잡한 문제를 해결하는 방법, 그리고 NVIDIA DGX Spark 데스크톱 AI 슈퍼컴퓨터 같은 시스템이 차세대 CUDA 개발자들을 어떻게 지원할지에 대해 이야기를 나눴습니다.

패널들은 CUDA 초창기 시절의 기억을 공유했습니다 — Meta Superintelligence Labs의 소프트웨어 엔지니어 Paulius Micikevicius는 당시 “아무도 GPU를 원하지 않았다”고 말했습니다. “우리는 직접 찾아가 GPU 사용을 고려해달라고 설득해야 했습니다.”

그 시절, 당시 일리노이 대학교 어바나-샴페인 교수였으며 현재 NVIDIA의 수석 저명 연구 과학자 겸 수석 연구 디렉터인 Wen-Mei Hwu는 대학원생들과 함께 두 달 만에 200개 GPU 시스템을 구축하기로 결정했습니다.

“몇 주 후 GPU 보드 200개와 전원 공급 장치 등이 도착했지만, 섀시가 없었습니다. 그래서 결국 각 보드에 나무 프레임을 직접 만들었고 … Green500 [벤치마크]를 돌려서 3위를 차지했습니다”라고 Hwu는 말했습니다. “그 순간 GPU의 에너지 효율이 엄청난 잠재력을 가지고 있다는 것을 깨달았습니다.”

가속 컴퓨팅의 규모가 랙 단위 시스템과 AI 팩토리로 이동함에 따라, 패널들은 DGX Spark 같은 데스크톱 AI 시스템이 프로토타이핑과 초기 개발을 위한 새로운 방향이 될 것으로 내다봤습니다.

“책상이나 무릎 위에 올려놓고 초기 탐색을 할 수 있는 기능이 있는 한, 그것이 핵심입니다”라고 NVIDIA의 저명한 개발 기술 엔지니어 Kate Clark은 말했습니다. “그 필요성은 앞으로도 사라지지 않을 것입니다. CUDA는 언제나 어디서나 함께할 것입니다.”

월요일, 3월 16일, 오후 1:30 PT 🔗

NVIDIA cuDF 및 cuVS, 세계 주요 데이터 플랫폼에 채택되며 현대 엔터프라이즈 데이터 처리 가속화

기업들은 매년 수백 제타바이트의 데이터를 생성하고 있으며, 조직들은 그 정보를 인사이트로 전환하기 위해 경쟁하고 있습니다. NVIDIA CUDA‑X 기반으로 구축된 가속 데이터 라이브러리인 NVIDIA cuDF와 cuVS는 정형 및 비정형 데이터 처리 비용을 절감하면서 최대 5배 빠른 성능을 제공하기 위해 다양한 산업의 데이터 플랫폼에서 채택되고 있습니다.

개발자들이 매월 2억 회 이상 다운로드하는 전 세계에서 가장 널리 사용되는 오픈 소스 데이터 엔진과 통합된 이 라이브러리들은 엔터프라이즈 데이터 플랫폼, 데이터베이스 및 데이터 레이크 전반에 걸쳐 활용되고 있습니다. 이를 통해 조직들은 혁신을 가속화하고, 더 정확한 모델을 개발하며, 비용을 관리하면서 더 많은 데이터를 처리할 수 있습니다.

정형 데이터의 경우, NVIDIA cuDF는 Apache Spark, Presto, DuckDB, Polars, Velox 등의 오픈 소스 데이터 처리 엔진을 가속화하여 CPU 단독 배포 대비 최대 5배 빠른 처리 성능을 제공합니다.

오늘날 기업 데이터의 80%를 차지하며 빠르게 증가하고 있는 비정형 데이터의 경우, NVIDIA cuVS는 FAISS, Amazon OpenSearch Service, Milvus를 비롯한 주요 엔진을 가속화합니다. 이를 통해 에이전트와 애플리케이션이 방대한 텍스트, 이미지, 동영상 저장소에서 맥락, 사실, 추천 정보를 훨씬 짧은 시간 내에 추출할 수 있습니다.

엔터프라이즈 데이터 처리 플랫폼 지원

Google Cloud는 NVIDIA cuDF를 통합하여 Dataproc 내의 Apache Spark를 가속화하며, cuDF는 Google Kubernetes Engine(GKE) 내에서도 손쉽게 활용하여 대규모 ETL 작업의 처리 시간을 수 시간에서 수 초로 단축하고 컴퓨팅 비용을 절감할 수 있습니다.

9억 4,600만 명 이상의 활성 사용자를 보유한 Snap에서는 GKE 기반의 NVIDIA cuDF를 통해 일일 데이터 처리 비용을 76% 절감했습니다. 이를 통해 3시간 이내에 10페타바이트의 데이터를 분석할 수 있게 되어 수백만 달러를 절약하고 있습니다.

“NVIDIA 및 Google Cloud와의 협력은 전 세계 10억 명 이상의 Snapchat 사용자를 위한 더 빠른 혁신을 가능하게 합니다.” 라고 Snap의 최고정보책임자 Saral Jain이 말했습니다. “데이터 처리 비용을 절감하고 페타바이트 규모의 데이터에 걸쳐 실험을 확장함으로써, AI 기반 경험을 더욱 빠르고 효율적으로 제공하고 있습니다.”

IBM watsonx.data는 정형 데이터를 위한 Apache Spark 및 Presto 엔진과 OpenSearch 기반의 벡터 엔진 등 오픈 소스 분석 엔진을 포함하는 하이브리드 오픈 데이터 플랫폼입니다. Nestlé의 주문-현금화(Order-to-Cash) 마트를 대상으로 한 초기 실험에서, NVIDIA cuDF를 활용한 watsonx.data는 워크로드를 5배 빠르게 실행하면서 83%의 비용 절감 효과를 거뒀습니다.

“수십억 명의 고객을 대상으로 하는 기업으로서, 데이터는 전 세계 운영 전반의 의사결정을 뒷받침합니다”라고 Nestlé의 최고 정보 및 디지털 책임자 Chris Wright가 말했습니다. “IBM 및 NVIDIA와 협력하여 진행한 집중적인 개념 증명을 통해 전 세계 운영 데이터를 몇 분 만에, 그것도 비용을 절감하면서 갱신할 수 있는 능력을 입증했습니다. 이제 우리의 초점은 이 역량을 실질적인 비즈니스 성과로 전환하는 것입니다. 제조 및 물류 창고 등의 분야에서 의사결정 속도를 더욱 높이고, 이러한 역량을 전사적으로 확장해 나갈 것입니다.”

NVIDIA와 함께하는 Dell AI 데이터 플랫폼은 기업이 AI 지원 데이터를 통해 Dell AI Factory를 신속하고 안전하게 활성화할 수 있도록 가속화된 데이터 엔진을 포함합니다. NVIDIA cuDF로 가속화된 Apache Spark 기반 처리 엔진을 탑재하여 최대 3배 빠른 성능을 제공하며, NVIDIA cuVS로 가속화된 엔터프라이즈급 벡터 데이터베이스는 CPU 대비 벡터 인덱싱 처리량을 최대 12배 향상시킵니다.

”에이전틱 AI를 위해 특별히 설계된 NVIDIA와 함께하는 Dell AI 데이터 플랫폼은 가속화된 데이터 처리 엔진을 활용하여 멀티모달 데이터를 며칠이 아닌 몇 시간 만에 AI 지원 상태로 만들어 줍니다”라고 Dell Technologies 회장 겸 CEO Michael Dell이 말했습니다.

Oracle은 Oracle Private AI Services Container가 NVIDIA cuVS를 활용하여 Oracle AI Database에서 벡터 인덱스 생성을 크게 가속화할 수 있다고 발표했습니다. 이를 통해 조직은 최신 정보를 바탕으로 AI 기반 의사결정을 더욱 빠르게 수행할 수 있습니다.

“엔터프라이즈 AI가 실험 단계에서 실제 운영 단계로 전환되고 있습니다”라고 Oracle CEO Clay Magouyrk가 말했습니다. “NVIDIA 기술이 탑재된 Oracle AI Database는 몇 분 안에 AI 지원 데이터를 제공하여, 이전에는 불가능했던 애플리케이션 구현을 가능하게 합니다.”

NVIDIA cuDF와 cuVS는 EDB Postgres AI, NetApp, Snowflake, Starburst, VAST Data 등 주요 엔터프라이즈 데이터 플랫폼에서 지원되며, AI 기반 데이터 처리의 미래를 위한 토대를 마련하고 있습니다.

양자 컴퓨팅 🔗

3월 20일 금요일, 오후 2:00 PT 🔗

NVIDIA NVQLink으로 양자 컴퓨팅이 변곡점에 도달하다

GTC에서 NVIDIA는 cudaq-realtime이라는 새로운 애플리케이션 프로그래밍 인터페이스(API)를 통해 NVQLink를 공개적으로 제공하고, 양자 오류 정정 분야의 최신 기술을 발전시키는 데모를 공개했습니다.

지난 10월 GTC 워싱턴 D.C.에서 처음 발표된 NVQLink는 양자 프로세서와 GPU 슈퍼컴퓨팅 간의 저지연 고처리량 연결을 양자 컴퓨팅 커뮤니티에서 이제 이용할 수 있게 되었으며, Dell의 제품 출시는 빠른 생태계 도입을 예고하고 있습니다.

cudaq-realtime API는 NVIDIA CUDA-Q 소프트웨어 플랫폼에서 제공되며, GPU 가속 슈퍼컴퓨팅과 양자 프로세서의 오픈 소스 턴키 통합을 지원합니다. cudaq-realtime을 통해 양자 커뮤니티의 얼리 어답터들은 양자 하드웨어에 대한 긴밀한 실시간 제어를 시연하고 하이브리드 양자-클래식 애플리케이션을 배포했습니다.

퍼시픽 노스웨스트 국립연구소와 로렌스 버클리 국립연구소를 포함한 미국 주요 국립연구소들과 QPU 제조사인 Quantinuum, Infleqtion, 그리고 양자 소프트웨어 제공업체 Q-CTRL이 NVQLink를 도입했으며, 일부 사례에서는 이전 연구 대비 디코딩 및 캘리브레이션 지연 시간을 수십 배 단축하는 성과를 보였습니다.

NVQLink은 상용 시스템에도 배포되기 시작했으며, QPU 제조사 Anyon Computing과 양자 시스템 공급업체 SDT가 한국 상용 데이터센터에서 NVQLink 양자-GPU 시스템을 공개하며, 프로덕션 환경에서 가속 양자-슈퍼컴퓨팅 시스템 구축으로의 전환을 예고했습니다.

컴퓨터 지원 엔지니어링 🔗

3월 16일(월), 오후 1:30 (태평양 표준시) 🔗

NVIDIA, 반도체 설계의 가속 양자 화학을 위한 cuEST 출시

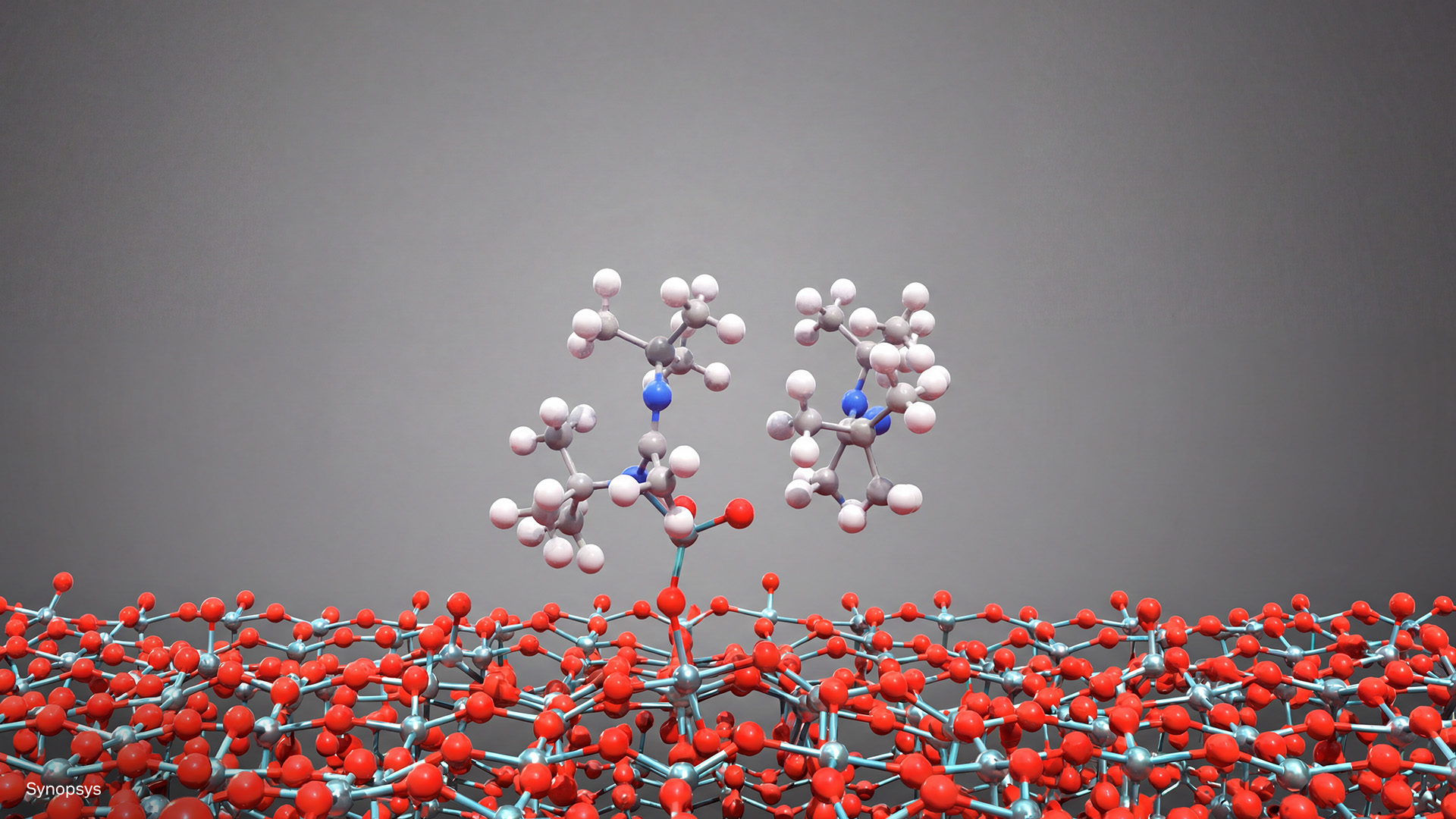

NVIDIA는 이번 주 전자 구조 계산을 GPU에서 처리하는 새로운 NVIDIA CUDA-X 라이브러리인 NVIDIA cuEST를 출시했습니다. Applied Materials, Samsung, Synopsys, TSMC가 초기 도입 기업에 포함됩니다.

현재 최첨단 칩에는 500억 개 이상의 트랜지스터가 집적되어 있습니다. 이를 설계하려면 원자 수준에서 근본적인 물리 문제를 해결해야 합니다. 전자가 어떻게 결합하고, 어떻게 이동하며, 불과 수 원자 두께의 박막에서 어떻게 상호작용하는지가 그 핵심입니다.

“반도체 스케일링이 재료의 물리적 한계에 도달하면서, 차세대 칩 설계의 양자 역학을 시뮬레이션하기 위한 컴퓨팅 성능의 대폭적인 향상이 업계에 요구되고 있습니다”라고 NVIDIA 산업 및 계산 엔지니어링 부문 총괄 매니저 Tim Costa가 말했습니다. “NVIDIA cuEST를 통해 업계 선두 기업들은 양자 병목 현상을 극복하고, 고충실도 화학 모델링을 직접 프로덕션 환경에 도입하여 반도체 혁신을 가속할 수 있습니다.”

업계 영향

- Applied Materials: Applied Materials는 cuEST 가속 밀도 함수 이론(DFT)을 사용하여 복잡한 구조를 모델링하고, 물질 특성을 예측하며, 반응 경로를 연구합니다.

- Samsung: Samsung은 이미 GPU에서 가속화된 내부 파이프라인에 cuEST를 통합하여, 핵심 양자 화학 워크로드에서 추가로 최대 5배의 엔드투엔드 속도 향상을 달성했습니다.

- Synopsys: cuEST와 QuantumATK를 기반으로, Synopsys는 가우시안 기저 DFT를 포함하도록 기능을 확장하여 반도체 워크플로우 시뮬레이션을 최대 30배 가속화했습니다.

- TSMC: TSMC는 cuEST의 가속 양자 화학을 활용하여 차세대 실리콘 설계를 위한 공정을 발전시키고 있습니다.

연구실에서 생산 현장으로

원자 단위 모델링에 가장 널리 사용되는 방법은 밀도 함수 이론입니다. DFT는 정확도와 확장성 사이에서 뛰어난 균형을 제공하지만, 높은 계산 비용으로 인해 산업 현장에서의 광범위한 활용이 제한되어 왔으며, 대부분의 응용이 연구 영역에 국한되어 있었습니다. cuEST를 통해 NVIDIA는 고정밀 양자 화학을 산업 규모의 실제 생산 워크플로우에서 실현 가능하게 만들었습니다.

역사적으로 업계는 CPU 클러스터를 활용해 게이트 유전체 및 인터커넥트 금속을 포함한 후보 물질을 수 시간에서 수 일에 걸쳐 한 번에 한 배치씩 평가하는 방식으로 시뮬레이션을 수행해 왔습니다.

cuEST는 최적화된 루틴을 제공하여 GPU가 가우시안 기저 DFT 계산의 핵심 행렬—겹침, 운동 에너지, 핵 인력, 쿨롱 및 교환-상관 행렬—을 가속화할 수 있도록 합니다. 또한 표준 일반화 기울기 근사부터 하이브리드 함수까지 다양한 함수 근사를 지원하여 엔지니어가 계산 비용과 정확도 사이의 균형을 조절할 수 있습니다.

cuEST에 대한 NVIDIA의 목표: 고충실도 물질 모델링을 연구실에서 생산 현장으로 이전하는 것입니다.

cuEST에 대해 더 알아보기 — GTC의 NVIDIA 데모 부스 및 Synopsys 부스에서 만나보시고, GTC 세션 “차세대 발견: 과학을 위한 에이전틱 AI, AI 기반 시뮬레이션 및 GPU 가속 화학“에서 더 깊이 탐구하세요.

금요일, 3월 20일, 오전 11:00 PT 🔗

McLaren, 자동차 시뮬레이션 및 설계를 위한 AI 물리학·에이전틱 AI 본격 가동

McLaren Automotive는 AI 물리학과 에이전틱 AI를 설계 워크플로우에 직접 도입하여 미래 제품 개발을 가속화하고 있습니다.

Rescale 및 NVIDIA와의 협업을 통해 McLaren은 새로운 자동차 개념의 신속한 탐색을 지원하기 위해 고정밀 인터랙티브 시뮬레이션 역량을 가속화하고 있습니다. NVIDIA AI 인프라 기반의 Rescale 디지털 엔지니어링 플랫폼은 복잡한 시뮬레이션 워크로드를 처음부터 끝까지 오케스트레이션합니다.

엔지니어링 AI 에이전트를 활용해 시뮬레이션의 전처리 및 후처리 작업을 자동화함으로써, McLaren은 이제 더 넓은 설계 공간을 탐색하고, 복잡한 테스트를 훨씬 빠르게 실행하며, 며칠이 걸리던 작업을 단 몇 분 만에 차량 부품을 더욱 정밀하게 튜닝할 수 있게 되었습니다.

McLaren의 워크플로우는 이번 주 GTC 전시장에서 공개되었습니다:

AI 물리학 모델은 이 접근 방식의 핵심적인 역할을 담당합니다. McLaren의 방대한 전산 유체 역학 시뮬레이션과 소재 데이터를 학습한 이 모델은 자동차 제작에 사용되는 탄소 섬유 구조물을 포함한 제조 성능에 대한 실시간 예측을 제공합니다.

McLaren, Rescale, NVIDIA의 협업은 AI 물리학 모델, 지능형 에이전트, 가속 컴퓨팅이 현대 엔지니어링 방식을 어떻게 재편하고 있는지를 잘 보여줍니다.

NVIDIA의 컴퓨터 지원 엔지니어링 및 산업용 AI 솔루션에 대해 자세히 알아보세요.

리테일 🔗

3월 17일 화요일, 오전 11:00 PT 🔗

분자 혁신: L’Oréal, NVIDIA ALCHEMI로 뷰티 신소재 발견 속도 100배 가속화

뷰티의 미래는 오랜 과학적 전문성과 창의성, 그리고 코드의 결합으로 쓰여지고 있습니다. L’Oréal과 NVIDIA는 수십억 달러 규모의 스킨케어 시장에 NVIDIA ALCHEMI — 화학 및 소재 혁신을 위한 AI 연구소 — 를 도입하기 위해 협력을 확대하고 있습니다.

기존에는 새로운 자외선 차단제를 개발하기 위해 수년에 걸친 세밀한 실험실 배합 작업이 필요했으며, 물리적 테스트가 필요한 조합의 방대한 수로 인해 많은 제약이 따랐습니다. 이제 L’Oréal은 이 과정을 간소화하고 있습니다.

NVIDIA 가속 컴퓨팅 기반의 ALCHEMI를 활용함으로써 L’Oréal은 컴퓨터 시뮬레이션을 통한 배합 특성 예측의 속도와 정확도를 높이고 있습니다.

이제 L’Oréal의 연구원들은 기존 시뮬레이션 방식보다 100배 빠르고 효율적으로 자외선 차단을 위한 분자 조합을 스크리닝할 수 있습니다. 결과적으로 AI는 발견 기간을 단축하고 비용을 절감하며, 화학 및 소재 과학 산업 전반에 걸쳐 연구, 배합 스크리닝, 제품 개발을 가속화합니다.

배합은 L’Oréal 연구의 핵심으로, 이 회사는 스킨케어와 헤어케어, 메이크업과 향수 분야에서 매년 3,400개 이상의 신규 배합을 관리하며 R&D에 연간 13억 유로 이상을 투자합니다. NVIDIA ALCHEMI를 도입함으로써 L’Oréal의 과학자들은 기존에는 계산적으로 너무 복잡해 탐색하기 어려웠던 광대한 화학적 공간을 탐구할 수 있게 되었습니다.

그 혜택은 뷰티를 넘어, 배합 최적화를 통해 L’Oréal이 피부 보호 및 노화 방지를 위한 유효 성분의 효능을 극대화하는 데도 기여합니다.

자외선 차단제 한 병이나 새로운 향료의 복잡한 화학을 넘어, NVIDIA ALCHEMI는 반도체 소재부터 페인트 및 코팅에 이르기까지 다양한 제품의 배합 최적화에 활용될 수 있습니다.

자세한 내용은 GTC에서 진행된 L’Oréal 세션에서 확인하세요.

3월 17일 화요일, 오전 11:00 PT 🔗

NVIDIA, OpenAI와 협력하여 리테일 에이전틱 커머스 Blueprint 공개

온라인 쇼핑의 미래는 에이전틱 커머스에 있으며, AI 에이전트가 상품 탐색, 결제, 구매 후 경험에 이르기까지 고객을 지원합니다.

GTC에서 NVIDIA는 리테일 에이전틱 커머스를 위한 NVIDIA Blueprint를 소개했습니다. 이는 오픈 소스 기반의 프로덕션 즉시 사용 가능한 참조 아키텍처로, 리테일 업체가 에이전트 간 통신과 주요 생성형 AI 플랫폼을 지원함으로써 새롭게 부상하는 에이전틱 커머스 생태계에 참여할 수 있도록 합니다.

이를 통해 ChatGPT나 Gemini를 사용하는 쇼핑객은 결제 보안, 실시간 프로모션, 개인화된 추천 기능을 갖춘 전체 구매 과정을 판매자의 통제 하에 완료할 수 있습니다.

하나의 코드베이스, 두 가지 주요 표준

이 Blueprint는 OpenAI의 에이전틱 커머스 프로토콜(ACP)을 완전히 구현하며, Google의 유니버설 커머스 프로토콜(UCP)도 지원합니다. 따라서 단일 배포로 두 가지 주요 에이전틱 커머스 표준을 모두 지원할 수 있습니다. build.nvidia.com에서 Blueprint에 액세스하면, 리테일 업체와 파트너는 단일 명령으로 전체 스택을 배포하고 즉시 개발을 시작할 수 있습니다.

OpenAI의 ACP 및 앱 소프트웨어 개발 키트를 통해 판매자는 ChatGPT 내에 쇼핑 경험을 직접 내장할 수 있습니다. OpenAI는 새로운 NVIDIA Blueprint 개발의 적극적인 파트너로서, ACP가 실제 배포 환경에서 올바르게 작동하도록 기술적 지침을 제공했습니다.

Blueprint의 구성 요소

NVIDIA NeMo Agent Toolkit을 기반으로 구축되고 NVIDIA Nemotron 오픈 모델로 구동되는 이 Blueprint에는 다음 네 가지 에이전트가 포함되어 있습니다:

- 프로모션 가격 책정 — 동적인 실시간 오퍼 생성 제공.

- 에이전틱 검색 증강 생성(RAG) 기반 추천 — 판매자 보유 재고를 기반으로 한 맥락적 상품 제안 제공.

- 시맨틱 검색 — 의도 인식 기반 상품 탐색 지원.

- 다국어 구매 후 메시지 — 자동화된 현지화 고객 후속 조치 지원.

위임형 결제 시스템이 이 모든 것을 하나로 묶어, 거래가 처음부터 끝까지 안전하고 판매자 중심으로 이루어지도록 보장합니다.

신뢰 위에 구축되다

에이전틱 커머스는 신뢰와 상호운용성을 기반으로 구축됩니다. 판매자, 결제 처리사, 에이전트 개발자 등 거래의 모든 참여자는 기반 프로토콜 레이어를 신뢰해야 합니다.

NVIDIA와 OpenAI가 함께 블루프린트를 구축함으로써, 리테일 업체들이 자신 있게 기반으로 삼을 수 있는 에이전틱 커머스 토대를 마련하고 있습니다. 또한 Google의 UCP를 구현함으로써, 이 블루프린트는 동일한 플랫폼에서 여러 에이전트 생태계를 지원하는 방향으로 토대를 확장합니다.

자세한 내용은 NVIDIA Blueprints를 방문하시고, GitHub에서 블루프린트를 살펴보세요. GTC에서 NVIDIA 파트너 부스(Cisco 1421(AIBLE 발표), Arrow 3101, Infosys 239)를 방문하여 블루프린트를 직접 확인하세요.

GTC에서 NVIDIA는 라이브 미디어 및 포스트 프로덕션 워크플로를 혁신할 강력한 신기술을 발표했습니다.

여기에는 NVIDIA Holoscan for Media의 새로운 콘텐츠 현지화 기능, NVIDIA Content-Localization Blueprint 및 NVIDIA AI for Media가 포함됩니다. NVIDIA AI for Media는 오디오, 비디오 및 증강 현실 기능을 위한 소프트웨어 개발 키트와 NVIDIA NIM 마이크로서비스 모음으로, 미디어 전문가들이 더 빠르고 유연하게 콘텐츠를 제작, 편집 및 배포하는 데 필요한 도구를 제공합니다.

글로벌 규모의 콘텐츠 현지화

실시간 AI 미디어 파이프라인 플랫폼인 Holoscan for Media는 이제 확장 가능한 콘텐츠 현지화 기능을 지원합니다.

NVIDIA AI for Media 기술과 파트너 AI 기술의 모음으로 제공되는 이 기능들은 NVIDIA 가속 컴퓨팅 인프라에서 비디오, 오디오 및 그래픽을 다른 언어로 번역하여, 라이브 미디어, 뉴스 및 스포츠 기업들이 비용이 많이 드는 수동 멀티프로덕션 비즈니스 모델에서 소프트웨어 기반의 대규모 현지화로 전환할 수 있도록 합니다.

NVIDIA 파트너사인 AI Media, Camb.AI, Chyron, Onemeta-Verbum 및 Panjaya가 AI 자막, 그래픽 번역, 더빙 및 현지화 음성을 지원하는 성장하는 Holoscan for Media 생태계에 합류했습니다. 이는 오디오 콘텐츠를 특정 시장, 지역, 집단 또는 문화에 맞게 조정하여 현지 사용자에게 자연스럽고 진정성 있으며 매력적으로 들리도록 합니다.

비디오 초고해상도 및 립싱크 기술과 결합된 이 업데이트는 업계가 전 세계 시청자에게 고품질의 현지화된 콘텐츠를 대규모로 제공할 수 있도록 지원합니다.

또한 새로운 NVIDIA Content-Localization Blueprint는 오디오, 비디오 및 그래픽을 더 많은 언어와 지역에 맞게 조정하는 방법을 소개합니다.

AI로 스튜디오 품질의 제작 구현

NVIDIA AI for Media는 SDK, NVIDIA NIM 마이크로서비스 및 프로덕션 준비 완료 레퍼런스 블루프린트를 통해 제공되는 오디오 및 비디오 처리를 위한 최첨단 AI 기술의 포괄적인 제품군을 제공합니다. 이 기능들은 라이브 비디오 파이프라인부터 고성능 포스트 프로덕션 워크플로우까지 모든 미디어 애플리케이션에 원활하게 통합될 수 있도록 설계되었습니다. NVIDIA AI for Media는 차세대 AI 강화 미디어 경험을 대규모로 가속화하는 데 필요한 기본 구성 요소를 제공합니다.

GTC에서 AI for Media는 NVIDIA Studio Voice, 액티브 스피커 감지 및 비디오 초고해상도 등 새로운 성능 최적화 기능을 선보였으며, 이제 AI for Media SDK에서 다운로드할 수 있습니다.

AI로 스포츠 산업 가속화

GTC에서 Lenovo와 NVIDIA는 글로벌 스포츠 산업 전반에 걸쳐 엔터프라이즈급 AI 도입을 가속화하기 위한 다년간 협력을 발표했습니다.

이번 협력은 팬 참여를 강화하고 성과, 수익 및 운영 성과를 높이기 위해 스포츠 인텔리전스, 스포츠 운영, 스포츠 미디어 및 콘텐츠 전반에 걸쳐 AI 기반 솔루션을 제공합니다.

Lenovo의 엔드투엔드 AI 전문성, Hybrid AI Advantage 솔루션 및 xIQ 오케스트레이션 레이어를 가속화된 인프라, 엔터프라이즈급 소프트웨어 및 AI 모델을 아우르는 풀스택 NVIDIA AI 플랫폼과 결합함으로써, 양사는 폭넓은 산업 파트너 생태계를 참여시키면서 스포츠 환경을 위한 첨단 기술을 제공하고 있습니다.

실시간 미디어 워크플로를 위한 NVIDIA 기술에 대해 GTC에서 자세히 알아보세요.

소프트웨어 제품 정보에 관한 고지사항을 확인하세요.

Jump Trading은 금융 서비스 분야에서 NVIDIA Rubin 플랫폼을 도입하는 최초의 트레이딩 회사 중 하나로, AI 기반 자본 시장 연구와 금융 모델링을 가속화할 예정입니다.

Jump의 핵심 성공 요인은 “리서치 속도(research velocity)”입니다. 이는 다양한 딥러닝 접근 방식을 탐색하고, 변화하는 시장 상황에 모델을 신속하게 적응시키며, 글로벌 시장 전반에 걸쳐 트레이딩을 확장하는 능력을 의미합니다. 금융 시장은 세계에서 가장 역동적이고 복잡한 데이터셋을 생성하며, 미국 주요 종목의 경우 하루 평균 1,000만 건 이상의 거래소 메시지가 발생하고 최대 초당 20만 건을 초과하기도 합니다.

이러한 특별한 수요를 충족하기 위해, NVIDIA Vera Rubin NVL72는 슈퍼컴퓨터급 컴퓨팅 밀도, 확장된 메모리 대역폭, 그리고 대폭 향상된 전력 효율성을 제공하여 성능을 높이는 동시에 토큰 비용을 절감합니다.

유동성 공급과 가격 발견을 이끌어 내려면 끊임없는 연구와 새로운 아이디어를 즉각 확장할 수 있는 역량이 필요합니다. NVIDIA 가속 컴퓨팅을 갖춘 Jump는 방대한 리서치 속도를 달성하고, AI를 활용해 변화하는 시장 상황에 적응하기 위해 복잡한 모델 아키텍처를 빠르게 반복 개선할 수 있습니다.

GTC FSI 파빌리온 189번 부스를 방문하여 Jump가 NVIDIA 가속 컴퓨팅을 활용해 차세대 자본 시장 연구 및 알고리즘 트레이딩을 구현하는 방법에 대해 자세히 알아보세요.

화요일, 3월 17일, 오후 12:00 PT 🔗

Hudson River Trading, NVIDIA AI Factory로 알고리즘 트레이딩 가속화

글로벌 퀀트 트레이딩 분야의 선도 기업인 Hudson River Trading(HRT)은 NVIDIA Blackwell 아키텍처와 NVIDIA Spectrum-X 이더넷 네트워킹을 기반으로 한 AI 팩토리를 활용하여 투자 리서치 및 알고리즘 트레이딩에서 상당한 성능 향상을 달성하고 있습니다.

AI 팩토리는 HRT 연구원들을 방대한 컴퓨팅 파워에 직접 연결하여 데이터 수집, 모델 학습, 시뮬레이션 및 배포 전반에 걸친 워크플로를 간소화합니다. 이 맞춤형 솔루션을 통해 HRT AI Labs 엔지니어들은 복잡한 시장 미시구조를 이해하고 더 빠르고 스마트한 인사이트를 제공하여 의사결정 신뢰도를 크게 높이는 모델을 개발하고 있습니다. 그 결과 NVIDIA Hopper 아키텍처 대비 Blackwell에서 HRT의 연구 반복 시간이 1.6배 향상되었으며, 이를 통해 HRT는 다음을 실현할 수 있습니다:

- 고정밀 가격 예측 및 발견을 통한 수익 극대화

- 합성 시장 데이터를 활용한 전략 안전 백테스트로 연구 비용 및 준비 시간 절감

- 마이크로초 정밀도로 글로벌 시장을 시뮬레이션하는 전자 시장 디지털 트윈을 활용한 새로운 전략 평가

이를 효율적으로 지원하기 위해, 해당 기업은 Lefdal Mine 데이터 센터의 AI 팩토리 내에서 컴퓨팅 집약적인 모델 학습을 배포하여 해당 시설을 연구 및 학습 허브 중 하나로 활용하고 있습니다.

피오르드 인근에 위치한 Lefdal Mine 시설은 전적으로 재생 수력 및 풍력 에너지로 운영되며, 차가운 해수를 끌어들여 사이펀 효과를 통해 냉각에 활용함으로써 전력 냉각 PUE를 1.15 이하로 유지합니다. 산 깊숙이 구축된 이 시설은 높은 수준의 물리적 보안을 제공하며, 냉각 시스템은 어떤 랙 밀도도 지원할 수 있도록 미래 지향적으로 설계되었습니다.

AI 팩토리가 금융 서비스를 어떻게 혁신하고 있는지 이 영상을 통해 확인하고, Lefdal AI 팩토리의 내부를 살펴보세요:

HRT가 주도하는 GTC 세션 “The Blueprint for a Modern Resource-Responsible AI Factory“에서 더 자세히 알아보세요.

화요일, 3월 17일, 오후 2:00 PT 🔗

사일로화된 데이터에서 연결된 인텔리전스로: 금융 리더들이 NVIDIA 기반 트랜잭션 파운데이션 모델을 도입하다

Mastercard, Revolut, Adyen을 비롯한 글로벌 금융 서비스 리더들이 NVIDIA 기반 트랜잭션 파운데이션 모델을 도입하여 사용자 행동의 복잡한 “언어”를 해독하고, 글로벌 상거래를 최적화하며 금융 범죄를 더 효과적으로 대응하고 있습니다.

Mastercard는 NVIDIA NeMo AutoModel과 NVIDIA 가속 컴퓨팅을 Databricks 플랫폼과 함께 활용하여 자체 트랜잭션 파운데이션 모델을 개발하고 있습니다. 이 모델은 글로벌 상거래의 미묘한 차이를 이해하는 최초의 결제 특화 모델 중 하나로, 수억 건의 트랜잭션으로 학습되었으며 이미 고급 머신 러닝 기법을 능가하는 유망한 성과를 보이고 있습니다.

Revolut은 자기 학습을 강화하고 다음 항목 예측을 가능하게 하는 마스크 예측 방식을 사용하여 트랜잭션 파운데이션 모델을 구축했습니다. 이 회사는 NVIDIA Hopper GPU와 NVIDIA cuDF 라이브러리부터 NVIDIA Nemotron 오픈 모델 패밀리에 이르는 NVIDIA의 전체 AI 스택을 활용하여 성능을 개선했으며, 사기 탐지 정밀도 20% 향상, 신용 위험 예측 개선, 교차 판매 정확도 9.6% 상승이라는 성과를 거뒀습니다.

Adyen은 1조 달러 규모의 결제를 처리하며 트랜잭션 파운데이션 모델을 대규모로 배포하여 개별 모델에서 통합 시스템으로 전환했습니다. 강화 학습을 활용하여 Adyen은 전체 결제 수취 라이프사이클을 동시에 최적화합니다. NVIDIA 가속 컴퓨팅 플랫폼을 활용함으로써 파운데이션 모델 추론 속도가 195배 향상되었고, Adyen은 엄격한 지연 시간 요구 사항을 충족하면서 가맹점의 전환율을 극대화하고 위험과 비용을 최소화할 수 있게 되었습니다.

Mastercard와 Databricks에 대해 더 알아보고, Revolut과 Adyen이 이끄는 GTC 세션에 참가하세요.

3월 19일 목요일, 오후 2시 30분 (태평양 표준시) 🔗

AI 노래로 돌아보는 GTC 기조연설

올해 GTC 기조연설은 로봇들과 TJ — NVIDIA 창립자 겸 CEO 젠슨 황의 AI 아바타인 토이 젠슨 — 이 캠프파이어 주변에 모여 마시멜로를 구우며 노래로 행사의 주요 발표들을 되짚어보는 장면으로 막을 내렸습니다.

획기적인 AI부터 가속 컴퓨팅까지, 손가락으로 튕기는 기타 연주와 하모니카 소리, 로봇들이 가득한 이 무대는 미래를 만들어가는 혁신들을 음악으로 담아낸 회고입니다.

기조연설 시청자들에게 깜짝 피날레로 선보인 이 애니메이션 영상은 NVIDIA 크리에이티브 팀이 생성형 AI 도구를 활용해 제작했습니다. AI 음악 생성기로 노래를 작곡하는 실험을 거친 후, 팀 내 한 영상 편집자가 로봇들이 소박한 캠프파이어 옆에서 음악을 연주하는 아이디어를 제안했습니다.

이미지 및 영상 생성·편집을 위한 다양한 AI 모델을 결합해, 팀은 피드백과 수정 사항을 유연하게 반영할 수 있는 애니메이션 제작 파이프라인을 구축했습니다. 또 다른 모델은 일관된 캐릭터 및 모델 데이터베이스를 생성하고 유지하는 데 활용되었습니다.

로봇들에게는 드럼, 기타, 마라카스가 주어졌으며, NVIDIA NemoClaw를 기리는 의미로 랍스터도 등장했습니다. 다른 팀들은 로봇 강아지와, 물론 TJ를 위한 참고 이미지를 제공했으며, TJ의 가죽 재킷은 체크무늬 셔츠로 교체되었습니다.

영상 위에는 노래가 깔립니다. 기조연설 전날, 팀은 GTC의 주요 발표 내용을 되짚는 데 집중하기로 했습니다. 이를 생생하게 표현하기 위해 작가와 영화 제작자가 NVIDIA 마케팅 리더들과 협력해 가사를 쓰고 음악을 다듬었으며, 소박한 캠프파이어 테마에 맞게 조율했습니다.

태평양 표준시 기준 3월 16일 월요일 오전 11시 🔗

GTC 기조연설 실시간 업데이트

GTC 2026에 오신 것을 환영합니다

SAP 센터를 가득 메운 관중, 모두가 같은 것을 기다리고 있습니다.

The 기조연설은 토큰을 현대 AI의 기본 단위—과학적 발견, 가상 세계, 물리적 환경에서 작동하는 기계에 활용되는 시스템의 구성 요소—로 정의하는 영상으로 시작되었습니다.

이어서 NVIDIA 창립자 겸 CEO 젠슨 황이 무대에 오르자 관중의 열렬한 박수갈채가 쏟아졌습니다.

그는 사전 행사 진행자들에게 감사를 전하고, 행사에 참여한 파트너사들과 함께 450개 이상의 스폰서사, 1,000개의 세션, 2,000명의 연사를 소개했습니다.

“이번 컨퍼런스는 인공지능의 5계층 케이크 모든 단계를 다룰 것입니다”라고 황이 말했습니다.

그는 CUDA 20주년을 기념하며, CUDA를 가속 컴퓨팅을 이끄는 “플라이휠”이자 “AI 라이프사이클의 모든 단계”를 지원하는 플랫폼으로 묘사했습니다.

황은 GeForce에 대한 이야기로 넘어가며, NVIDIA를 “GeForce가 만든 집”이라고 표현했습니다. CUDA를 세상에 선보인 플랫폼이라는 것입니다. 그는 GeForce의 역사를 짚어가며 AI와의 연결고리를 설명하고, DLSS 5를 소개했습니다. 3D 기반 뉴럴 렌더링을 통해 로컬 하드웨어에서 실시간 포토리얼 4K 성능을 구현하는 방식을 담은 영상을 공개했습니다. 자세한 내용은 보도자료에서 확인하세요.

다음으로, 황은 데이터 처리 분야와 AI 시대에 맞춰 이를 가속화하는 방식을 설명했습니다. IBM, Dell, Google Cloud, AWS, Microsoft Azure, Oracle, CoreWeave와의 협업을 통해 고객들을 지원하는 내용을 상세히 소개했습니다.

황은 이어서 가속 컴퓨팅 생태계를 조망했습니다—자동차, 금융 서비스, 헬스케어, 산업, 미디어, 양자 컴퓨팅, 리테일, 로보틱스, 통신 분야를 아우릅니다.

“이 다양한 AI 벡터 모두에 NVIDIA가 제공하는 플랫폼이 있습니다”라고 황이 말하며, 회사의 “핵심 자산”이라고 표현한 NVIDIA의 광범위한 CUDA-X 라이브러리를 강조했습니다.

황은 “AI 네이티브”의 부상을 강조했습니다—OpenAI, Anthropic 같이 잘 알려진 기업부터 아직 성장 중인 기업까지, 완전히 새로운 회사들입니다. “지난 한 해, 급격히 치솟았습니다”라고 황이 말하며, 벤처 스타트업에 대한 1,500억 달러의 투자를 언급하고 최근의 기술 붐을 이끈 기술들의 역사를 되짚었습니다.

이러한 붐의 결과로, NVIDIA GPU에 대한 컴퓨팅 수요는 “차트를 벗어날 정도”라고 그는 말했습니다. “저는 지난 몇 년간 컴퓨팅 수요가 100만 배 증가했다고 생각합니다.”

그 결과, 황 CEO는 이제 2025년부터 2027년까지 최소 1조 달러의 매출을 전망한다고 말했습니다.

Vera Rubin과 그 너머 — 컴퓨팅의 세대적 도약

황 CEO는 극단적인 코디자인 덕분에 NVIDIA의 토큰 비용이 세계 최고 수준이라고 언급하며, 한 애널리스트가 NVIDIA를 “추론의 왕”으로 묘사한 것에 기뻐했습니다. “이것이 바로 극단적인 코디자인의 놀라운 힘입니다”라고 황 CEO는 말했으며, 이는 소프트웨어와 실리콘을 함께 설계하는 프로세스를 가리킵니다.

다음 단계: NVIDIA Vera Rubin, 에이전트 AI를 위한 7개의 칩, 5개의 랙 규모 시스템 및 1개의 슈퍼컴퓨터로 구성된 새로운 풀스택 컴퓨팅 플랫폼입니다. 이 플랫폼에는 새로운 NVIDIA Vera CPU와 BlueField-4 STX 스토리지 아키텍처가 포함됩니다.

“우리가 Vera Rubin을 생각할 때, 우리는 소프트웨어를 포함하여 수직 통합되고 엔드투엔드로 확장되며 하나의 거대한 시스템으로 최적화된 전체 시스템을 생각합니다”라고 황 CEO는 이러한 기술로 구축된 새로운 시스템의 내부를 청중에게 안내하며 말했습니다.

Vera Rubin을 넘어, NVIDIA의 다음 주요 아키텍처는 Feynman입니다.

여기에는 새로운 CPU인 NVIDIA Rosa가 포함될 예정이며, 황 CEO는 이 이름이 DNA의 구조를 밝혀내고 현대 생물학을 재편한 X선 결정학으로 유명한 로절린드 프랭클린의 이름을 딴 것이라고 설명했습니다. 프랭클린이 생명의 숨겨진 아키텍처를 드러냈듯이, Rosa는 에이전트 AI 인프라의 전체 스택에 걸쳐 데이터, 도구, 토큰을 효율적으로 이동하도록 설계되었습니다.

Rosa는 NVIDIA의 차세대 LPU인 LP40과 NVIDIA BlueField‑5 및 CX10을 결합한 새로운 플랫폼의 기반이 되며, 구리 및 공패키지 광학 스케일업을 위한 NVIDIA Kyber와 NVIDIA Spectrum급 광학 스케일아웃을 통해 연결된다고 황 CEO는 말했습니다. Feynman 세대는 컴퓨팅, 메모리, 스토리지, 네트워킹 및 보안 등 AI 팩토리의 모든 핵심 요소를 발전시킵니다.

그리고 새로운 AI 용량의 확장을 가속화하기 위해, 황 CEO는 NVIDIA Vera Rubin DSX AI 팩토리 레퍼런스 디자인과 NVIDIA Omniverse DSX 블루프린트를 발표했습니다. DSX Air는 더 넓은 DSX 플랫폼의 일부로, 기업들이 물리적 세계에 구축하기 전에 소프트웨어에서 AI 팩토리를 시뮬레이션할 수 있게 해줍니다.

마지막으로, 황 CEO는 NVIDIA가 우주로 진출한다고 발표했습니다. 새로운 Vera Rubin 아키텍처는 암흑 물질을 밝혀낸 천문학자의 이름을 따서 명명되었으며, NVIDIA Space-1 Vera Rubin과 같은 미래 시스템은 AI 데이터 센터를 궤도에 올려 지구에서 우주로 가속 컴퓨팅을 확장하도록 설계되고 있습니다.

NVIDIA NemoClaw for OpenClaw, Nemotron Coalition

황 CEO는 개발자 Peter Steinberger의 오픈 소스 프로젝트인 OpenClaw를 집중 조명하며, 이를 “인류 역사상 가장 인기 있는 오픈 소스 프로젝트”라고 칭했습니다.

“OpenClaw는 에이전틱 컴퓨터의 운영 체제를 오픈 소스화했습니다… 이제 OpenClaw는 우리가 개인 에이전트를 만들 수 있도록 했습니다”라고 황 CEO는 말했습니다.

단 하나의 명령어로 개발자들은 OpenClaw를 가져와 AI 에이전트를 구동하고 도구와 컨텍스트로 확장을 시작할 수 있습니다. NVIDIA는 자사 플랫폼 전반에 걸쳐 OpenClaw 지원을 발표하며, 개발자들이 NVIDIA 기반 인프라에서 AI 에이전트를 안전하게 구축, 배포 및 가속할 수 있도록 지원합니다.

황 CEO는 오늘날 전 세계 모든 기업이 OpenClaw 전략을 보유해야 한다고 말했습니다.

이 기술이 기업 내부에서 안전하게 배포될 수 있도록 황 CEO는 NVIDIA OpenShell 런타임과 NVIDIA NemoClaw 스택을 소개했습니다 — 정책 적용, 네트워크 가드레일 및 프라이버시 라우팅을 결합한 것입니다. 황 CEO는 이 기술들이 “전 세계 모든 SaaS 기업의 정책 엔진” 역할을 할 수 있다고 말했습니다.

또한 NVIDIA는 오픈 모델 생태계를 새로운 Nemotron Coalition으로 확장하며, 여섯 가지 프론티어 모델 패밀리를 중심으로 파트너들을 결집시킵니다: NVIDIA Nemotron(언어 및 추론), NVIDIA Cosmos(세계 및 비전), NVIDIA Isaac GR00T(범용 로보틱스), NVIDIA Alpaymayo(자율 주행), NVIDIA BioNeMo(생물학 및 화학), NVIDIA Earth‑2(날씨 및 기후).

Physical AI

NVIDIA는 AI를 디지털 에이전트에서 실제 세계를 탐색할 수 있는 Physical AI로 확장하고 있습니다.

황 CEO는 NVIDIA의 로보택시 지원 플랫폼이 BYD, 현대, 닛산, 지리를 포함한 새로운 자동차 제조사 파트너들을 끌어들이고 있다고 말했습니다.

그는 또한 이 차량들을 Uber의 차량 호출 네트워크에 배치하기 위한 Uber와의 파트너십을 강조했습니다.

자동차 제조업체 외에도, NVIDIA는 산업용 소프트웨어 대기업들과 ABB, Universal Robots, KUKA 등 로보틱스 선두 기업들과 협력하여 물리적 AI 모델 및 시뮬레이션 툴을 통합함으로써 제조 라인에 더 스마트한 로봇을 배치할 수 있도록 하고 있으며, T‑Mobile 같은 통신 사업자들과도 협력하여 기지국이 엣지 AI 플랫폼으로 진화하고 있습니다.

마무리

황 CEO는 디즈니의 겨울왕국에 등장하는 눈사람 Olaf의 깜짝 등장으로 기조연설을 마무리했습니다. Olaf는 디지털 스크린에서 바로 걸어 나와 무대 위에 등장하는 것처럼 보였습니다.

“여러분, Olaf입니다.” 황 CEO가 말했고, 캐릭터는 NVIDIA의 물리적 AI 스택, Newton 물리 엔진, NVIDIA Omniverse 기반 시뮬레이션으로 구동되어 뒤뚱거리며 등장했습니다.

“Olaf, 잘 지냈어요? 내가 컴퓨터를 줬으니까 알죠 — Jetson이요,” 황 CEO가 농담을 건넸습니다.

Olaf가 그게 무엇이냐고 묻자, 황 CEO는 “음, 네 배 안에 있어요 … 그리고 Omniverse 안에서 걷는 법을 배웠죠.”라고 답했습니다.

이 데모는 황 CEO의 더 큰 요점을 뒷받침했습니다. 즉, 전시된 모든 것 — 휴머노이드 로봇에서 애니메이션 캐릭터까지 — 은 사전 렌더링이 아닌 시뮬레이션으로 구현되었다는 것입니다.

황 CEO는 추론, AI 팩토리, OpenClaw, 물리적 AI와 로보틱스 등 주제들을 정리하며 마무리한 후, 무대를 음악 앙상블에게 넘겼습니다. 노래하는 로봇들, 디지털 Jensen 아바타, 그리고 애니메이션 바닷가재가 캠프파이어 노래를 불렀습니다.

“자, GTC 즐겁게 보내세요,” 황 CEO가 무대 왼쪽으로 퇴장하며 말했고, Olaf는 무대에 남아 관객들에게 익살스러운 모습을 보이다가 무대 바닥의 해치를 통해 사라졌습니다.

온라인 프레스 킷에서 GTC의 모든 NVIDIA 뉴스를 확인하세요.

GTC 파크에서 열리는 NVIDIA의 build-a-claw 이벤트에서 나만의 에이전트를 만들어 보세요. 3월 16~19일 진행되며 — 월요일은 오후 1~5시, 화~목요일은 오전 8시~오후 5시 — 능동적이고 항시 작동하는 AI 어시스턴트를 커스터마이징하고 배포할 수 있습니다.

2025년 3월 11일 수요일, 오전 9시 PT 🔗

GTC 파크의 Build-a-Claw

GTC 참가자들은 역사상 가장 빠르게 성장하는 오픈 소스 프로젝트인 OpenClaw를 사용하여 “클로(claw)” — 즉 장기 실행 에이전트 — 를 가장 먼저 체험해볼 수 있습니다.

3월 16일부터 19일까지 GTC 파크에서 열리는 NVIDIA의 build-a-claw 행사에 들러보세요. 월요일에는 오후 1시~5시, 화요일부터 목요일까지는 오전 8시~오후 5시 언제든지 방문하여 능동적이고 상시 운영되는 AI 어시스턴트를 직접 커스터마이즈하고 배포해보세요.

NVIDIA 전문가들의 지원을 받아 GTC 참가자들은 AI 에이전트를 손쉽게 경험할 수 있습니다. 기술 전문가든 단순히 호기심이 있는 분이든, 참가자들은 에이전트의 이름을 정하고, 성격을 설정하며, 필요한 도구에 대한 접근 권한을 부여할 수 있습니다. 항상 원하던 개인 비서를 만들어보세요 — 원하는 메시지 앱을 통해 언제든지 연락할 수 있습니다.

커스텀 에이전트를 실행하려면 현장에서 제공되는 클라우드 컴퓨팅을 이용하거나, NVIDIA DGX Spark 또는 GeForce RTX 노트북을 가져와 로컬 가속 컴퓨팅을 활용하세요. 기기에 개인 데이터는 필요하지 않습니다. DGX Spark 시스템은 NVIDIA Gear Store 및 Micro Center에서 현장 구매도 가능합니다.

이 상시 운영 AI 어시스턴트는 캘린더 관리, 휴가지 추천, 새로운 운동 루틴 제안, 유용한 앱 코딩 등 사실상 모든 작업에 활용할 수 있습니다. 특정 분야 전문가로 설정하거나 제너럴리스트로 활용하세요. 에이전트는 지시받은 새로운 기술을 지속적으로 학습하고 새로운 발견 사항을 사용자에게 알려줍니다.

행사에 참여한 NVIDIA 머신 러닝 엔지니어 Sidney Knowles는 “다양한 시각을 가진 분들이 오셨습니다”라고 말했습니다 — DGX Spark를 백팩에 넣고 바로 만들 준비가 된 기술 전문가들부터 OpenClaw 데모를 처음 보고 싶어 한 비기술적 열정가들까지 다양했습니다.

행사에 참여한 개발자들은 시장 조사 및 광고부터 통신, 금융 서비스, 물리적 AI에 이르기까지 다양한 산업 분야에서 AI 에이전트를 구축했다고 그녀는 말했습니다.

하지만 모두가 비슷한 수준의 흥분과 호기심을 가지고 왔으며, Knowles가 말하길 결국 모든 것이 하나의 질문으로 귀결됐습니다: “AI가 나를 위해 무엇을 해줄 수 있나요?”

Nationwide의 소프트웨어 엔지니어링 컨설턴트 Clayton Littlejohn은 DGX Spark를 build-a-claw 행사에 가져와 보험 업계의 물리적 AI 준비 상태를 평가하는 AI 에이전트를 만들었습니다.

“DGX Spark의 가장 큰 장점은 신기술, 특히 풀스택 기술로 문제를 빠르게 프로토타입할 수 있다는 점입니다”라고 Littlejohn은 말했습니다.

DGX Spark의 매력은 모든 것을 로컬에 유지하면서도 가능성의 예술을 선보일 수 있다는 점이라고 그는 덧붙였습니다.

“NVIDIA NemoClaw는 이를 엔터프라이즈 방식으로 구현하여 가드레일을 신뢰하고 활용하며 워크플로에 적용할 수 있게 해줍니다”라고 그는 말했습니다. “이는 우리가 한 번도 본 적 없는 것들을 가능하게 하고 있습니다 — 가능성은 무한합니다.”

자세한 내용은 NVIDIA의 새로운 OpenClaw 플레이북을 살펴보세요: DGX Spark에서 OpenClaw를 실행하는 단계별 가이드입니다. 이 플레이북은 개발자들이 클라우드에 의존하지 않고 파일, 앱, 워크플로우와 직접 연동되는 상시 작동 로컬 우선 AI 에이전트를 구축하는 데 도움을 줍니다.

업데이트를 계속 확인하고 GTC의 전체 이벤트 및 활동 일정을 확인하세요.

3월 19일 목요일, 오후 5:30 PT 🔗

Toy Jensen의 홀로그램 AI 에이전트, 일명 TJ, GTC 전시장에 등장

NVIDIA 창업자 겸 CEO 젠슨 황이 GTC 곳곳에 있는 것처럼 보였다면, 실제로 그랬다. 적어도 Toy Jensen의 홀로그램 AI 에이전트 — 친구들 사이에서는 TJ로 불리는 — 가 그러했다.

NVIDIA 하드웨어와 소프트웨어 — NVIDIA Nemotron 오픈 모델, NVIDIA NIM 마이크로서비스 등 — 을 활용한 LiveX.ai의 완전 에이전틱 플랫폼으로 구축된 18개의 TJ 아바타가 투명한 캡슐 안에 대기하며 컨퍼런스 관련 질문은 물론 최신 피지컬 AI, 가속 컴퓨팅, AI 에이전트에 관한 참가자들의 질문에 답했다.

물론 에이전트 TJ는 참가자들이 원하는 만큼 사진 촬영에도 응했다. 그중에는 TJ의 원본 모델인 황 본인도 있었으며, 그는 자신의 또 다른 홀로그램 자아와 셀카를 찍었다.

LiveX.ai가 리테일 공간, 스포츠 이벤트 및 기타 소비자 경험을 혁신하는 피지컬 AI 에이전트를 어떻게 개발하고 있는지 LiveX 창업자 Jia Li와 함께하는 NVIDIA AI 팟캐스트를 통해 자세히 알아보세요.

3월 18일 수요일, 오전 10시 PT 🔗

NVIDIA, 차세대 AI를 선도하는 아메리카 파트너들을 기념

NVIDIA는 2026 아메리카 NVIDIA 파트너 네트워크(NPN) 수상자들을 선정하여 이를 기리고 있습니다. 이들은 해당 지역에서 차세대 AI 혁신, 실행 및 산업적 영향력을 이끌고 있습니다. 이 파트너들은 가속 컴퓨팅, 네트워킹, NVIDIA AI Enterprise 소프트웨어를 아우르는 NVIDIA의 풀 스택 플랫폼을 활용해 고객들이 파일럿에서 프로덕션으로 전환할 수 있도록 지원하고 있습니다.

올해 아메리카 수상자들은 신진 스타, AI 우수 및 첨단 기술 파트너, 그리고 네트워킹, 컨설팅 및 글로벌 시스템 통합 분야의 리더들로 구성되어 있습니다. 이들은 인프라를 현대화하고, 운영을 간소화하며, 아메리카 전역 고객들을 위한 새로운 제품과 서비스를 창출하고 있습니다.

올해 수상 파트너들은 고등 교육, 정부, 의료, 금융 서비스, 소매, 통신, 에너지 및 유틸리티 등 핵심 산업의 혁신을 이끌고 있습니다. 이들은 NVIDIA와 함께 조직들이 AI를 활용하여 효율성을 높이고, 경험을 향상시키며, 기업과 지역 사회에 중요한 복잡한 과제들을 해결할 수 있도록 지원하고 있습니다.

지역 및 유통 파트너들은 현지 전문성과 서비스를 통해 가치 실현 시간을 단축하며, 모든 규모의 고객에게 NVIDIA AI 인프라와 파트너 솔루션을 제공함으로써 이러한 영향력을 더욱 확장하고 있습니다.

NVIDIA는 2026 아메리카 NPN 어워드 수상자 전원을 축하하며, 아메리카 전역에 걸친 AI의 다음 물결을 이끄는 지속적인 협력에 감사드립니다.

Monday, March 16, 1:30 p.m. PT 🔗

NVIDIA IGX Thor 정식 출시, 산업용 엣지에 실시간 물리적 AI 구현

산업계가 경직된 자동화를 넘어 물리적 AI로 나아감에 따라, 복잡한 환경에서 자율적이고 안전이 중요한 기계를 구동하기 위한 실시간 감지 및 추론이 가능한 새로운 등급의 지능형 엣지 컴퓨팅 장치가 필요해졌습니다.

이러한 수요를 충족하기 위해, NVIDIA IGX Thor — 고속 센서 처리, 엔터프라이즈급 안정성 및 기능적 안전성을 갖추고 엣지에서 실시간 물리적 AI를 제공하는 강력한 산업용 플랫폼 — 이 정식 출시되었습니다.

업계 선두 기업들, IGX Thor로 물리적 AI 확장

NVIDIA IGX Thor는 건설, 제조, 물류, 의료 및 생명 과학, 심지어 우주 탐사 분야의 엣지 애플리케이션을 강화합니다.

Caterpillar는 IGX Thor 기반의 차량 내 대화형 AI 어시스턴트를 개발하여 작업자의 생산성과 안전성을 향상시키고 있으며, Hitachi Rail은 IGX Thor를 활용하여 철도 네트워크에 고급 예측 유지보수 및 자율 검사 시스템을 배포하고 있습니다.

공급망 솔루션 기업 KION Group은 IGX Thor와 NVIDIA Halos Outside-In Safety 워크플로우를 활용하여 “아웃사이드-인” 인식을 구현하고 있습니다. 이는 AI 에이전트가 인프라에 장착된 카메라와 동적 가상 안전 울타리를 사용하여 자율 로봇 기능 안전 메커니즘을 강화하는 방식입니다. SICK와 같은 생태계 파트너들은 센서 역량 안전 핵심 애플리케이션을 통해 자율 산업용 로봇의 인증을 가속화하고 있습니다.

Agility와 Hexagon Robotics는 안전한 휴머노이드 로봇을 위한 실시간 AI 추론 및 멀티모달 센서 융합에 IGX Thor를 도입하고 있습니다.

Johnson & Johnson은 IGX Thor를 도입하여 Polyphonic 디지털 수술 플랫폼을 구동하고, 수술실에 실시간 AI 추론을 적용하고 있습니다. KARL STORZ는 IGX Thor를 활용하여 보다 정확한 진단을 위한 차세대 내시경 및 영상 도구를 개발하고 있습니다. Medtronic은 IGX Thor 도입을 검토 중이며, LEM Surgical과 Horizon Surgical Systems는 수술 로봇 시스템에서 정밀도와 기능 안전성을 실현하기 위해 IGX Thor를 도입하고 있습니다.

NVIDIA Holoscan 플랫폼을 기반으로 구축된 이 시스템들은 비디오, 영상 및 장치 원격 측정 데이터를 포함한 멀티모달 센서 데이터를 처리하고 조율할 수 있어, 차세대 소프트웨어 정의 의료 기기와 지능형 수술실에 필요한 저지연 AI 파이프라인을 구현합니다.

Planet Labs는 IGX Thor를 도입하여 수 테라바이트에 달하는 다차원 위성 데이터를 더 낮은 비용으로 궤도 상에서 실행 가능한 인텔리전스로 변환하고 있습니다. CERN의 연구원들은 IGX Thor를 사용하여 고급 물리학 영감 AI 모델을 실행하고, 대용량 데이터 스트림을 높은 처리량으로 처리하고 있습니다.

물리적 AI에서 생태계 확장 및 배포 시간 단축

성능과 안전성을 넘어, 산업용 AI는 생산 준비가 완료된 시스템, 멀티모달 센서, 그리고 신뢰할 수 있는 액추에이터를 필요로 합니다.

Analog Devices, Infineon, NXP Semiconductors, STMicroelectronics 및 Texas Instruments는 레이더 장치, 센서 및 모터 컨트롤러를 NVIDIA Isaac Sim 프레임워크에 통합하고 NVIDIA Holoscan Sensor Bridge를 활용하여 차세대 센서 및 액추에이터 통합을 가속화함으로써 더 빠르고 안전하며 스마트한 물리적 AI 시스템을 구현하고 있습니다.

Leopard Imaging, D3 Embedded, Sensing 및 e-con Systems는 Holoscan Sensor Bridge 기반의 이더넷 카메라 모듈을 출시하여 실시간 AI 처리를 위한 저지연 센서 데이터를 GPU로 직접 스트리밍할 수 있도록 지원합니다.

Advantech, ASRockRack, NEXCOM, Connect Tech, Onyx, Inventec 및 Yuan은 다양한 애플리케이션에 맞는 엔터프라이즈급 성능, 유연한 입출력 및 커스텀 구성을 갖춘 산업용·의료용 IGX Thor 시스템을 구축하고 있습니다.

Barco, Cosmo 및 XRlabs는 IGX Thor와 NVIDIA Holoscan을 도입하여 의료 기기 산업을 위한 의료등급 기성품 엣지 AI 플랫폼을 구축하고 있으며, 기기 제조업체가 NVIDIA의 풀스택 가속 컴퓨팅 및 AI 소프트웨어를 활용해 개발을 가속화하고 의료 인증을 받은 프로덕션 수준의 임상 솔루션을 배포할 수 있도록 지원합니다.

IGX Thor 개발자 키트는 전 세계 유통 파트너를 통해 구매 가능합니다. 기능 안전성을 갖춘 임베디드 시스템용 IGX T5000 모듈과 고성능 워크스테이션용 IGX 7000 보드 키트는 추후 출시될 예정입니다.

NVIDIA 창업자 겸 CEO Jensen Huang의 GTC 기조연설을 시청하고 피지컬 AI, 로보틱스 및 비전 AI 세션을 살펴보세요.

2025년 3월 19일 목요일, 오후 1:00 PT 🔗

로봇들, GTC를 대거 누비다

GTC는 AI 개발자와 혁신가들의 집결지일 뿐만 아니라, 휴머노이드와 로봇 팔부터 사족보행 로봇과 자율 이동 로봇(AMR)에 이르기까지 온갖 종류의 로봇들에게도 인기 있는 행사장입니다.

도움을 주는 휴머노이드

AGIBOT 휴머노이드가 컨벤션 센터에서 GTC 참가자들을 맞이했습니다. 이 로봇은 NVIDIA Isaac Sim과 Isaac Lab을 활용해 학습되었습니다.

Humanoid는 Isaac Sim, Isaac Lab, NVIDIA Omniverse 라이브러리를 활용해 개발된 NVIDIA Jetson Thor 기반 로봇을 선보였으며, 이 로봇은 참가자들이 요청한 물품을 직접 건네주었습니다.

Hexagon Robotics는 Isaac Sim과 Isaac Lab에서 학습된 AEON 휴머노이드를 전시장에 가져와 다양한 조작 및 원격 조종 작업을 시연했습니다.

팔을 들어 올리다

ABB Robotics는 레코드 회전 기술로 관중을 즐겁게 한 DJ 로봇을 선보였습니다. 이 회사는 NVIDIA Omniverse 라이브러리를 자사의 RobotStudio 프로그래밍 및 시뮬레이션 제품군에 직접 통합하고 있습니다.

WORKR는 자사의 로보틱스 기술이 세라믹 제조업체 Fireclay Tile의 힘들고 반복적인 타일 작업을 어떻게 자동화하는지 시연했습니다. ABB Robotics 하드웨어에 탑재된 이 로보틱스 파이프라인은 Isaac Sim과 Omniverse를 활용해 개발되었습니다.

Universal Robots는 Scale AI 소프트웨어를 활용한 UR AI Trainer를 공개했습니다. 이 시스템은 리더-팔로워 방식으로 인간 운영자가 로봇을 작업에 안내할 수 있으며, 동기화된 동작·힘·시각 데이터를 기록해 비전 언어 액션 모델을 훈련합니다. 이 회사는 Isaac Sim과 Omniverse를 활용해 시뮬레이션에서 로봇을 훈련합니다.

4족 보행 로봇과 AMR의 전시장 활약

FieldAI는 자사의 Field Foundation Models가 4족 보행 로봇의 실제 환경 자율 탐색 및 매핑을 어떻게 지원하는지 선보였습니다. 이 시스템은 NVIDIA Omniverse NuRec 라이브러리와 NVIDIA Cosmos 월드 모델을 포함한 NVIDIA 기술을 기반으로 구축되었습니다.

관람객들은 전시장에서 Sentigent Technology의 소형 Rovar X3 로봇 주변에 모여들었습니다. 이 실내외 겸용 동반 로봇은 Isaac Lab에서 훈련되었으며 NVIDIA Jetson으로 구동됩니다.

Serve Robotics의 AMR 12대 이상이 GTC 캠퍼스 곳곳에서 활동하며, SAP Center에서 열린 기조연설 사전 행사 중 음식을 배달하고 행사 기간 내내 참석자들이 직접 고를 수 있는 기념품을 운반했습니다. Serve 로봇은 Isaac Sim에서 시뮬레이션되며 NVIDIA Jetson Orin으로 구동됩니다.

3월 16일 월요일, 오후 1:30 PT 🔗

DGX Spark 및 DGX Station과 NVIDIA NemoClaw의 결합으로 자율 에이전트를 위한 풀스택 플랫폼 구현

인공지능은 단순한 프롬프트 기반 도구에서 추론하고, 계획하고, 행동하는 지능형 장기 실행 시스템으로 진화하고 있습니다. 이러한 자율 에이전트는 단순히 텍스트를 생성하는 것에 그치지 않습니다. 코드 작성, 도구 호출, 데이터 분석, 결과 시뮬레이션, 지속적 자기 개선이 가능합니다.

슈퍼컴퓨팅 수준의 지능을 갖춘 상시 구동 에이전트를 구축하고 운영하려면 적절한 인프라가 필요합니다.

NVIDIA DGX Spark와 NVIDIA DGX Station 시스템을 새로운 NVIDIA NemoClaw 오픈 소스 스택과 결합하면 자율적인 장기 실행 에이전트(일명 클로우)를 로컬에서 개발하고 배포하기 위한 최적의 플랫폼을 제공합니다. 이 시스템은 AI 팩토리급 성능을 지능이 창출되는 바로 그 현장, 즉 데스크톱과 기업 내부에 직접 구현합니다.

NemoClaw로 에이전틱 AI 보안 강화

NVIDIA NemoClaw는 항상 실행되는 OpenClaw 어시스턴트를 더 안전하게, 단 하나의 명령으로 간편하게 실행할 수 있도록 지원하는 오픈 소스 스택입니다. NVIDIA OpenShell 런타임을 설치하며, 이는 NVIDIA Agent Toolkit의 일부로, 자율 에이전트를 실행하기 위한 보안 환경과 NVIDIA Nemotron과 같은 오픈 소스 모델을 제공합니다.

독점 워크플로우 전반에 자율 에이전트를 배포하는 기업에는 거버넌스, 격리 및 제어가 필요합니다. OpenShell은 에이전트가 데이터에 접근하고, 도구를 사용하며, 정책 경계 내에서 운영되는 방식을 정의하여 안전하고 상시 가동되는 AI 시스템을 위한 아키텍처 기반을 제공합니다.

자기 진화하는 에이전트는 자율적으로 작업을 완료하면서 도구와 소프트웨어를 구축하기 위한 전용 컴퓨팅이 필요합니다. DGX Spark와 DGX Station은 NemoClaw를 실행하여 데이터 센터 AI 팩토리로 확장하기 전에 OpenClaw 에이전트를 로컬에서 구축하고 검증하기에 이상적인 환경입니다.

DGX Spark: 엔터프라이즈 팀을 위한 확장 가능한 AI

DGX Station이 가장 강력한 데스크사이드 AI 시스템을 대표하는 반면, DGX Spark는 엔터프라이즈 전반의 도메인 팀에게 확장 가능한 AI 인프라를 제공합니다.

대용량 로컬 메모리, 우수한 성능, 그리고 NemoClaw와의 통합을 통해 DGX Spark는 자율 에이전트 개발 및 배포에 이상적입니다.

DGX Spark는 이제 최대 4개의 시스템을 통합 구성으로 클러스터링하여 — 기존 랙 배포의 복잡성 없이 — 선형에 가까운 성능 확장을 제공하는 소형 “데스크탑 데이터 센터”를 구성할 수 있습니다.

DGX Spark의 향후 소프트웨어 릴리스는 오케스트레이션과 관리 기능을 더욱 강화하여 더 빠른 반복 작업과 프로토타입에서 프로덕션으로의 원활한 전환을 가능하게 할 것으로 기대됩니다.

DGX Spark는 NVIDIA Nemotron 3 및 주요 오픈 모델을 포함한 최신 AI 모델을 지원하여, 개발자들이 지속적으로 발전하는 현대적인 AI 소프트웨어 스택을 기반으로 구축할 수 있도록 보장합니다.

산업 전반에 걸쳐 조직들은 DGX Spark를 평가 환경에서 실제 엔터프라이즈 배포 환경으로 전환하고 있습니다. 금융 기관은 리스크 모델링을 가속화하고 있습니다. 의료 연구자들은 발견 일정을 단축하고 있습니다. 에너지 기업들은 운영을 최적화하고 있습니다. 미디어 및 통신 팀은 실시간 콘텐츠 및 커뮤니케이션 워크플로우를 구축하고 있습니다.

DGX Station: 데스크에서 실현하는 데이터 센터급 AI

NVIDIA DGX Station — 세계에서 가장 강력한 데스크사이드 슈퍼컴퓨터 — 이 장시간 사고하는 자율적 추론의 새로운 시대를 위해 출시되었습니다.

NVIDIA GB300 Grace Blackwell Ultra Desktop Superchip을 탑재한 DGX Station은 748기가바이트의 코히런트 메모리와 최대 20 페타플롭스의 AI 컴퓨팅 성능을 제공합니다. 72코어 NVIDIA Grace CPU와 NVIDIA Blackwell Ultra GPU를 NVIDIA NVLink-C2C로 연결하여, 프론티어 AI 워크로드를 위한 통합된 고대역폭 아키텍처를 구현합니다.

개발자들은 최대 1조 개의 파라미터를 가진 오픈 모델을 실행하고, 자신의 책상에서 직접 장시간 추론이 가능한 자율 에이전트를 개발할 수 있습니다.