어느 여름날 쉬는 시간이 끝날 무렵 식수대 앞에 긴 줄을 서서 기다리다가 시원한 물을 마셨던 기억이 있나요? 여러 개의 꼭지를 통해 한 번에 많은 사람들이 물을 마실 수 있다면 어떨까요?

이것이 바로 엔비디아 암페어(Ampere) 아키텍처에 적용된 멀티 인스턴스 GPU(Multi-Instance GPU, 이하 MIG)의 본질이라고 할 수 있는데요.

MIG는 엔비디아 A100 GPU를 최대 7개의 독립된 GPU 인스턴스로 분할합니다. 인스턴스들은 각각 고유한 메모리, 캐시, 스트리밍 멀티프로세서를 사용해 동시에 실행되죠. 이를 통해 모든 작업에 대해 보장된 서비스 품질로 적합한 크기의 GPU를 제공해 이전 GPU 대비 최대 7배 향상된 활용도를 구현합니다.

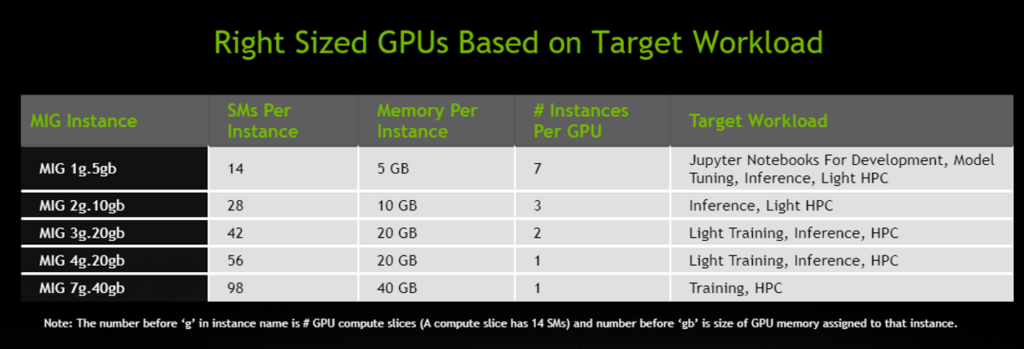

MIG 모드의 A100은 최대 7개의 다양한 크기의 AI 또는 HPC 워크로드를 혼합해 실행할 수 있습니다. 이 기능은 일반적으로 최신 GPU가 제공하는 성능을 모두 필요로 하지 않는 AI 추론 작업에 유용합니다. 예컨대 사용자는 20GB의 메모리를 갖춘 2개의 MIG 인스턴스 혹은 10GB의 3개 인스턴스, 5GB의 7개 인스턴스를 생성할 수 있어 각각의 워크로드에 맞는 최적의 조합을 만들 수 있습니다.

MIG는 GPU 인스턴스를 차단시키므로 결함격리(fault isolation) 기능을 제공하기 때문에 한 인스턴스의 문제가 동일한 GPU에서 실행되는 다른 사용자에게 영향을 미치지 않습니다. 각 인스턴스는 보장된 QoS를 제공해 사용자의 워크로드가 예상되는 레이턴시(지연시간)과 처리량을 확보할 수 있도록 하죠.

클라우드 서비스제공업체와 그 외의 기업들은 MIG를 통해 GPU 서버의 활용률을 높여 사용자에게 최대 7배 많은 GPU 인스턴스를 제공할 수 있습니다. 구글 클라우드의 수석 소프트웨어 엔지니어 팀 호킨은 “엔비디아는 구글 클라우드의 전략적 파트너로 고객을 위해 혁신을 거듭하고 있습니다. MIG는 공유 쿠버네티스(Kubernetes) 클러스터에서 GPU의 효율성과 활용도를 새로운 수준으로 끌어올리죠. 구글 클라우드는 엔비디아, 그리고 쿠버네티스 커뮤니티와 협력해 이러한 공유 GPU 활용사례를 만들어내고, 이를 구글 쿠버네티스 엔진(Google Kubernetes Engine)을 통해 이용할 수 있기를 기대합니다”라고 말했습니다.

MIG로 추론작업 최적화 가능해져

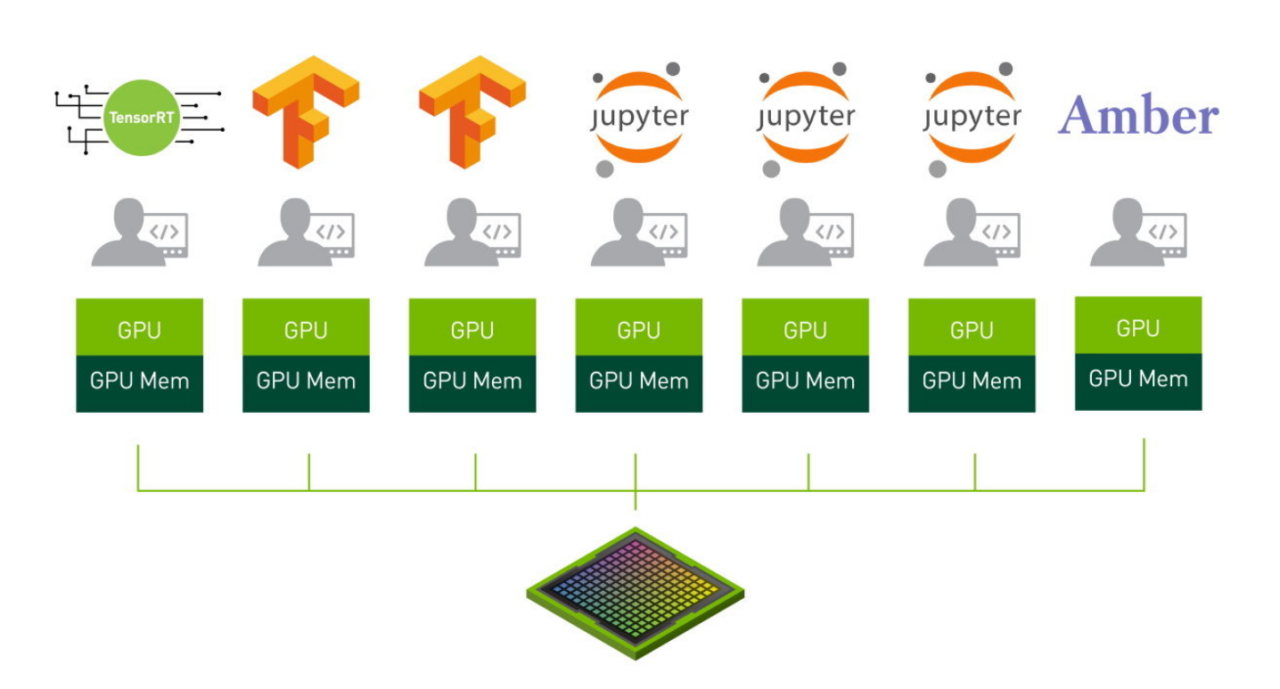

기업은 MIG를 통해 AI 모델의 개발과 배포속도를 향상시킬 수 있습니다. MIG는 최대 7명의 데이터 사이언티스트가 전용 GPU와 같은 기능에 동시에 액세스할 수 있으므로 최적의 정확성과 성능을 위해 딥 러닝 모델을 세부적으로 조정할 수 있습니다. 많은 시간이 소요되긴 해도 많은 컴퓨팅 성능이 요구되진 않습니다.

모델을 실행할 준비가 되면 MIG는 단일 GPU에서 한번에 최대 7개의 추론작업을 할 수 있습니다. 이런 작업에는 GPU 전체를 사용할 필요가 없고 레이턴시가 짧은 작은 모델을 사용하는 배치-1 추론 워크로드가 가장 적합한데요.

미국의 주문형 배송업체 포스트메이츠(Postmates)의 AI 디렉터 젠유 궈는 “포스트메이츠 배달 로봇 플랫폼 서브(Serve)에 엔비디아 기술이 핵심적인 역할을 하고 있습니다. MIG를 사용하면 컴퓨팅 리소스를 역동적으로 재구성해 변화하는 워크로드 조건을 충족하고 클라우드 기반 인프라를 최적화해 효율성은 극대화하면서 비용은 절감할 수 있습니다. 그래서 적용된 GPU를 최대한 활용할 수 있죠”라고 말했습니다.

IT·데브옵스(DevOps) 구축

사용자들은 AI와 HPC용 MIG를 활용하기 위해 쿠다(CUDA) 프로그래밍 모델을 변경할 필요가 없습니다. MIG는 쿠버네티스와 컨테이너뿐만 아니라 기존의 리눅스(Linux) 운영 체제에도 구동됩니다. MIG는 A100용으로 제공된 소프트웨어에도 작동됩니다. 여기에는 GPU 드라이버, 곧 배포될 예정인 엔비디아 쿠다 11 소프트웨어, 업데이트된 엔비디아 컨테이너 런타임, 엔비디아 디바이스 플러그인(NVIDIA Device Plugin)을 통한 쿠버네티스의 새로운 리소스 유형이 포함됩니다.

MIG와 함께 엔비디아 버추얼 컴퓨터 서버(vComputeServer)를 사용하면 RHV(Red Hat Virtualization)와 VM웨어 v스피어(VMware vSphere)와 같은 하이퍼바이저 관리와 모니터링 기능 제공이 가능해집니다. 또한, 실시간 마이그레이션과 멀티 테넌시처럼 널리 사용되는 기능도 지원 가능하죠.

레드 햇(Red Hat)의 마케팅 디렉터 척 더뷰크는 “점점 더 많은 고객들이 가상 시스템에서 실행되는 멀티 테넌트 워크 플로우를 관리하면서 격리와 보안 기능도 제공해야한다고 느끼고 있습니다. 엔비디아 A100 GPU의 새로운 멀티 인스턴스 GPU 기능으로 클라우드에서 엣지까지 레드 햇 플랫폼에서 실행되는 AI 가속 워크로드가 가능해졌습니다”라고 소감을 밝혔습니다.

엔비디아 A100을 사용하면 사용자는 실제 GPU와 마찬가지로 새로운 GPU 인스턴스에서 작업 내용을 확인하고 스케줄링 할 수 있게 될 것입니다.