NVIDIA는 7월 28일부터 8월 1일까지 미국 덴버(Denver)에서 열리는 최고의 컴퓨터 그래픽 컨퍼런스인 SIGGRAPH 2024에서 렌더링, 시뮬레이션, 그리고 생성형 AI의 최신 발전 사항을 공유할 예정입니다.

20개 이상의 논문에서 차세대 모델 훈련에 도움이 되는 합성 데이터 생성기와 인버스 렌더링(Inverse rendering) 툴을 발전시키는 혁신을 소개하는 NVIDIA Research의 논문이 발표됩니다. NVIDIA의 AI 연구는 이미지 품질을 향상시키고 현실 또는 상상의 세계를 3D로 표현하는 새로운 방법을 개발하여 시뮬레이션 기술을 향상시키고 있습니다.

이 논문은 시각적 생성형 AI, 물리 기반의 시뮬레이션과 점점 더 사실적인 AI 기반 렌더링을 위한 확산 모델에 중점을 두고 있습니다. 여기에는 두 개의 기술 최우수 논문 수상작과 미국, 캐나다, 중국, 이스라엘, 일본 전역의 대학과 더불어 Adobe, Roblox 등의 유수의 기업 연구진들과의 협업이 포함되어 있습니다.

이러한 이니셔티브는 개발자와 기업이 복잡한 가상 오브젝트, 캐릭터, 환경을 생성하는 데 사용할 수 있는 도구를 만드는 데 도움이 될 것입니다. 그런 다음 합성 데이터 생성을 활용하여 강력한 시각적 스토리를 전달하고, 자연 현상에 대한 과학자들의 이해를 돕거나 로봇과 자율 주행 자동차의 시뮬레이션 기반 훈련을 지원할 수 있습니다.

확산 모델(Diffusion Models)로 텍스처 페인팅, 텍스트-이미지 생성 향상

텍스트 프롬프트를 이미지로 변환시키는 데 널리 사용되는 도구인 확산 모델(Diffusion Model)은 아티스트, 디자이너, 그리고 다른 크리에이터가 스토리보드나 제작에 필요한 비주얼을 빠르게 생성하여 아이디어를 실현하는 데 걸리는 시간을 단축할 수 있도록 도와줍니다.

NVIDIA가 작성한 두 개의 논문은 이러한 생성형 AI 모델의 기능을 발전시키고 있습니다.

NVIDIA와 텔아비브(Tel Aviv) 대학교의 연구진이 협업한 ConsiStory는 만화 삽화나 스토리보드 개발과 같은 스토리텔링 사용 사례에 필수적인 기능인 일관된 주인공을 가진 여러 이미지를 쉽게 생성할 수 있게 해줍니다. 연구진의 접근 방식은 주제 중심 공유 주의(Subject-driven shared attention)라는 기술을 도입하여 일관된 이미지를 생성하는 데 걸리는 시간을 13분에서 약 30초로 단축합니다.

NVIDIA 연구원들은 작년에 진행된 SIGGRAPH의 실시간 라이브 이벤트에서 텍스트 또는 이미지 프롬프트를 맞춤형 텍스처 머티리얼로 변환하는 AI 모델로 베스트 인 쇼(Best in Show) 상을 수상했습니다. 올해는 2D 기반 생성형 확산 모델을 3D 메시의 인터랙티브 텍스처 페인팅에 적용하여 아티스트가 모든 레퍼런스 이미지를 기반으로 복잡한 텍스처를 실시간으로 페인팅할 수 있도록 하는 논문을 발표할 예정입니다.

물리 기반 시뮬레이션 개발 시작하기

그래픽스 분야의 연구자들은 디지털 오브젝트와 캐릭터를 실제 세계에서와 같은 방식으로 움직이게 하는 다양한 기술인 물리 기반 시뮬레이션을 통해 실제 오브젝트와 가상 표현 사이의 간극을 좁히고 있습니다.

텍스트 프롬프트를 기반으로 복잡한 사람의 동작을 시뮬레이션하는 문제를 해결하는 프로젝트인 SuperPADL을 비롯한 다양한 NVIDIA 연구 논문에서 이 분야의 획기적인 성과들 확인할 수 있습니다(상단 비디오 참조).

연구원들은 강화 학습과 지도 학습의 조합을 사용하여 5,000개 이상의 기술을 재현하도록 SuperPADL 프레임워크를 훈련하고 일반 소비자용 NVIDIA GPU에서 실시간으로 실행할 수 있는 방법을 시연했습니다.

또 다른 NVIDIA 논문에서는 AI를 적용하여 3D 메시로 표현된 물체, NeRF 또는 텍스트-3D 모델로 생성된 솔리드 오브젝트가 환경에서 움직일 때 어떻게 작동하는지 학습하는 뉴럴 물리학 방법을 소개합니다.

카네기멜론 대학교 연구진과 공동으로 작성한 한 논문에서는 물리적 빛을 모델링하는 대신 열 분석, 정전기 및 유체 역학을 수행할 수 있는 새로운 종류의 렌더러를 개발했습니다. SIGGRAPH에서 최우수 논문 5편 중 하나로 선정된 이 방법은 병렬화가 쉽고 번거로운 모델 정리가 필요하지 않아 엔지니어링 설계 주기를 단축할 수 있는 새로운 기회를 제공합니다.

위의 예시에서는 렌더러가 화성 큐리오시티 탐사선의 열 분석을 수행하는데, 여기서 온도를 특정 범위 내로 유지하는 것이 임무 성공에 매우 중요합니다.

추가적인 시뮬레이션 논문에서는 모발 가닥을 모델링하는 더 효율적인 기법과 유체 시뮬레이션을 10배까지 가속화하는 파이프라인을 소개합니다.

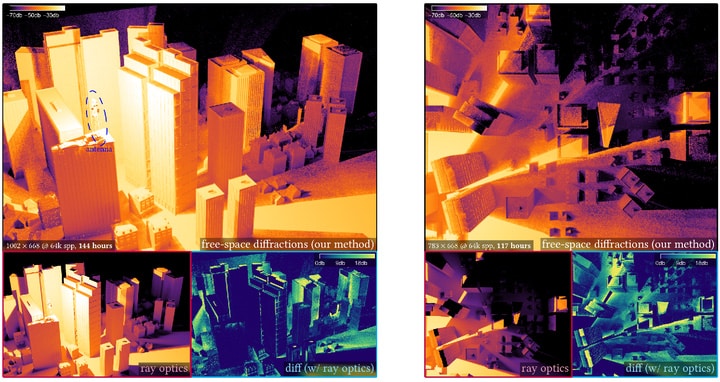

사실적인 렌더링의 기준을 높인 회절(Diffraction) 시뮬레이션

NVIDIA가 작성한 또 다른 논문에서는 가시광선을 최대 25배 빠르게 모델링하고 자율 주행 자동차 훈련용 레이더 시뮬레이션에 사용되는 회절(Diffraction) 효과를 최대 1,000배 빠르게 시뮬레이션하는 새로운 기술을 소개합니다.

NVIDIA와 워털루 대학교 연구진의 논문은 빛이 물체의 가장자리에서 퍼지거나 구부러지는 광학 현상인 자유 공간 회절(free-space diffraction)을 다룹니다. 이 연구팀의 방법은 패스 트레이싱 워크플로우와 통합하여 복잡한 장면에서 회절 시뮬레이션의 효율성을 높이고 최대 1,000배의 가속화를 제공합니다. 가시광선 렌더링 외에도 이 모델은 레이더, 소리 또는 전파의 더 긴 파장을 시뮬레이션하는 데도 사용할 수 있습니다.

패스 트레이싱은 장면을 통과하는 수많은 경로(다중 바운스 광선)를 샘플링하여 사실적인 이미지를 생성합니다. 두 개의 SIGGRAPH 논문은 게임 및 기타 실시간 렌더링 제품에 패스 트레이싱을 도입하는 데 핵심적인 역할을 해온 경로 추적 알고리즘인 ReSTIR의 샘플링 품질을 개선하기 위해 NVIDIA와 다트머스 대학 연구진이 SIGGRAPH 2020에서 처음 소개했습니다.

이 논문 중 하나는 유타 대학교와 협력하여 계산된 경로를 재사용하는 새로운 방법으로 유효 샘플 수를 최대 25배까지 늘려 이미지 품질을 크게 향상시키는 방법을 공유합니다. 다른 하나는 빛의 경로 하위 집합을 무작위로 변형하여 샘플 품질을 개선하는 방법입니다. 이렇게 하면 노이즈 제거 알고리즘의 성능이 향상되어 최종 렌더링에서 시각적 아티팩트가 더 적게 생성됩니다.

AI에게 3D로 사고하도록 가르치기

NVIDIA 연구원들은 SIGGRAPH에서 3D 표현과 디자인을 위한 다목적 AI 도구도 선보일 예정입니다.

한 논문에서는 실제 세계의 규모와 일치하는 3D 딥 러닝을 위한 GPU 최적화 프레임워크인 fVDB를 소개합니다. fVDB 프레임워크는 도시 규모의 3D 모델과 NeRF의 넓은 공간 규모와 고해상도, 대규모 포인트 클라우드의 세분화 및 재구성을 위한 AI 인프라를 제공합니다.

다트머스 대학 연구진과 공동으로 작성한 최우수 기술 논문 수상작은 3D 물체가 빛과 상호 작용하는 방식을 표현하는 이론을 소개합니다. 이 이론은 다양한 외관을 단일 모델로 통합합니다.

또한 도쿄대학교, 토론토대학교, Adobe Research와의 협업으로 3D 메시에서 공간을 채우는 부드러운 곡선을 실시간으로 생성하는 알고리즘을 도입했습니다. 이전 방식은 몇 시간이 걸렸지만 이 프레임워크는 몇 초 만에 실행되며 사용자가 결과물을 고도로 제어할 수 있어 인터랙티브한 디자인이 가능합니다.

NVIDIA at SIGGRAPH

산업 디지털화에서 로봇과 AI가 미치는 영향에 대해 NVIDIA 젠슨 황 CEO와 WIRED의 선임 작가인 Lauren Goode의 간담회를 비롯한 다양한 특별 이벤트와 함께 SIGGRAPH에서의 NVIDIA 세션에 대해 자세히 알아보세요.

또한, NVIDIA 연구원들은 개발자와 업계 리더들이 AI 지원 3D 파이프라인을 구축하기 위해 OpenUSD를 어떻게 활용하고 발전시키고 있는지 소개하는 OpenUSD Day를 통해 최신 기술 발전 사항들을 발표할 예정입니다.

전 세계 수백 명의 과학자와 엔지니어가 AI, 컴퓨터 그래픽, 컴퓨터 비전, 자율 주행 자동차, 로보틱스 등의 다양한 주제에 대해 연구하고 있는 NVIDIA Research에는 수백 명의 과학자와 엔지니어가 있습니다. 최근 연구 성과들을 자세히 알아보세요.